В сообществе пользователей VPN вновь неспокойно. В начале июня многие россияне столкнулись с массовыми сбоями в работе популярных решений на базе Xray, VLESS и REALITY. Автор под ником hyperion_cs провёл на Хабре собственное исследование и заявил, что обнаружил новый алгоритм ограничений, который применяется как мобильными, так и домашними провайдерами.

По его версии, проблема связана не с блокировкой конкретных серверов или IP-адресов.

Гораздо интереснее другое: система анализирует параметры TLS-соединений, включая SNI, сетевую принадлежность сервера и так называемый фингерпринт клиента — набор признаков, по которым можно определить, под какой браузер маскируется соединение.

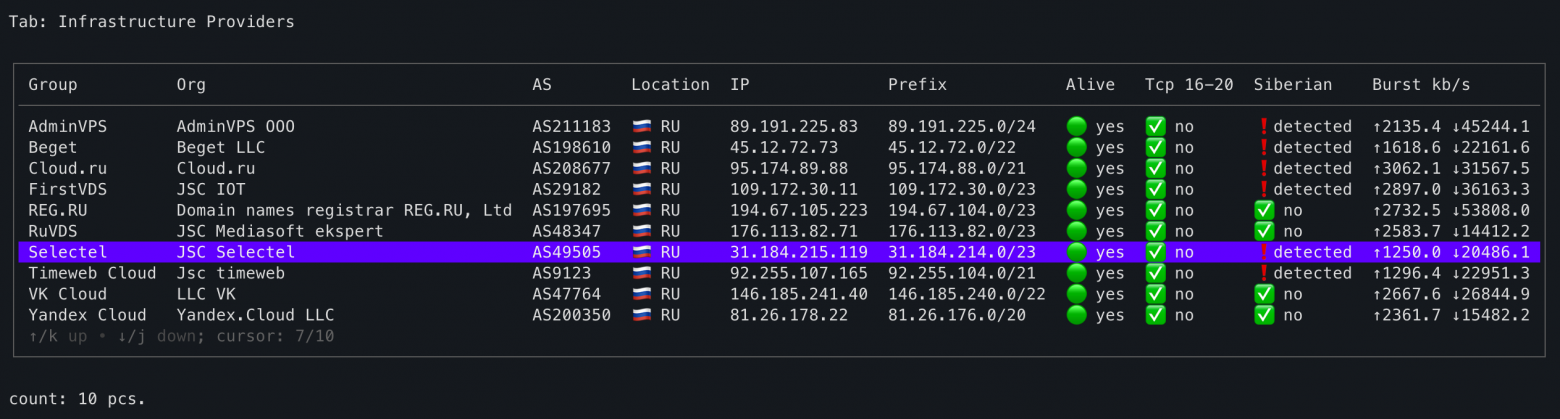

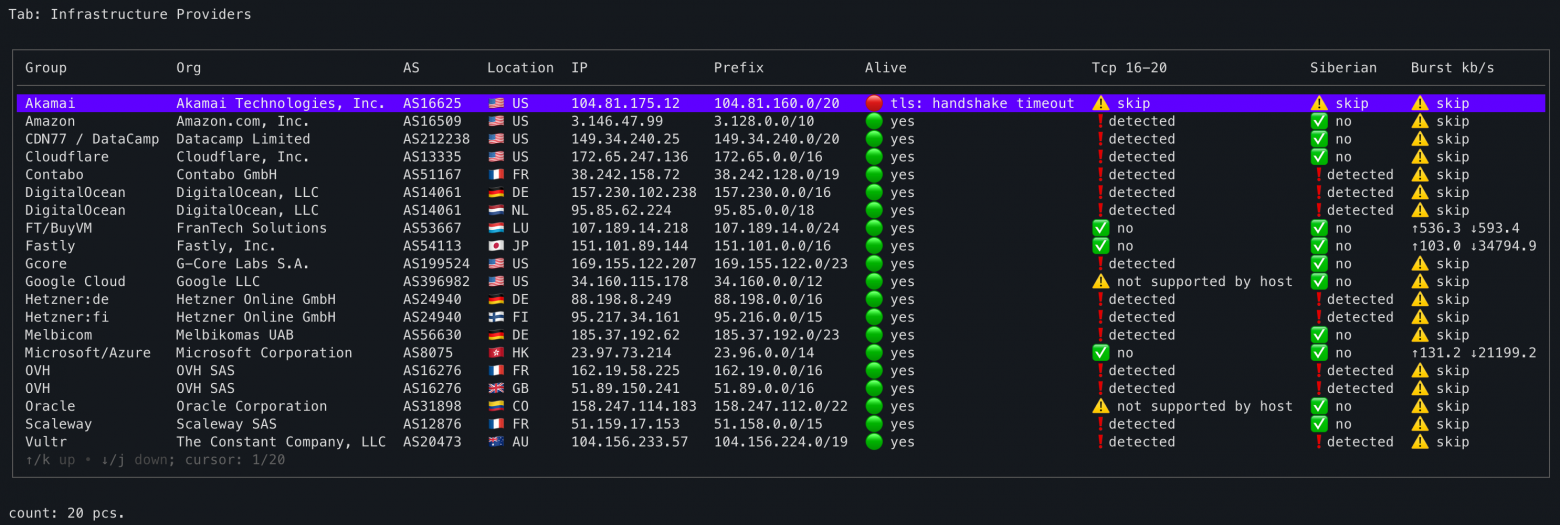

Как утверждает исследователь, под особое внимание попадают подключения к серверам в определённых подсетях и автономных системах. Причём речь идёт не только о зарубежных площадках, но и о крупных российских инфраструктурных провайдерах, включая Selectel, Яндекс Облако и Cloud.ru.

Согласно опубликованному анализу, если система фиксирует несколько параллельных TLS-подключений к одному ресурсу за короткий промежуток времени, соединения могут быть принудительно заморожены на две минуты. Если после этого клиент меняет свой сетевой отпечаток, срок ограничения якобы увеличивается уже до десяти минут.

Автор исследования отмечает, что такой подход напоминает известную среди специалистов сибирскую блокировку, но с более жёсткими параметрами и расширенным охватом.

Особое беспокойство вызывает то, что под ограничения потенциально могут попадать не только инструменты обхода блокировок, но и вполне легитимные веб-сайты, размещённые в российских дата-центрах. По мнению исследователя, это может негативно сказываться на доступности обычных интернет-ресурсов.

Для проверки своей гипотезы автор использовал инструмент dpi-ch из проекта dpi-checkers. По его словам, результаты тестирования показывают, что ограничения затрагивают часть популярных российских инфраструктурных площадок, а для зарубежных операторов по-прежнему применяются дополнительные механизмы фильтрации трафика.

Следует отметить, что опубликованное исследование представляет собой независимый технический анализ. Официальных комментариев со стороны операторов связи или регулирующих органов по поводу описанного механизма на момент публикации не поступало.