Исследователи зафиксировали новую имейл-кампанию, в ходе которой злоумышленники распространяют вредоносную программу, написанную, судя по всему, с помощью ИИ-сервисов. Этот зловред — AsyncRAT.

Ранее киберпреступники использовали генеративные возможности ИИ для составления убедительных писем, а ряд экспертов предупреждал, что эти же сервисы могут помочь и в создании вредоносов.

Именно это и произошло: согласно отчёту HP Wolf Security, злоумышленники с низким уровнем технических навыков всё чаще прибегают к услугам ИИ-сервисов для создания вредоносных программ.

Например, в июне HP зафиксировала фишинговую кампанию, нацеленную на пользователей из Франции. В этих атаках использовался метод HTML smuggling для доставки вредоносного кода.

В результате жертва получает запароленный ZIP-архив, содержащий код VBScript и JavaScript.

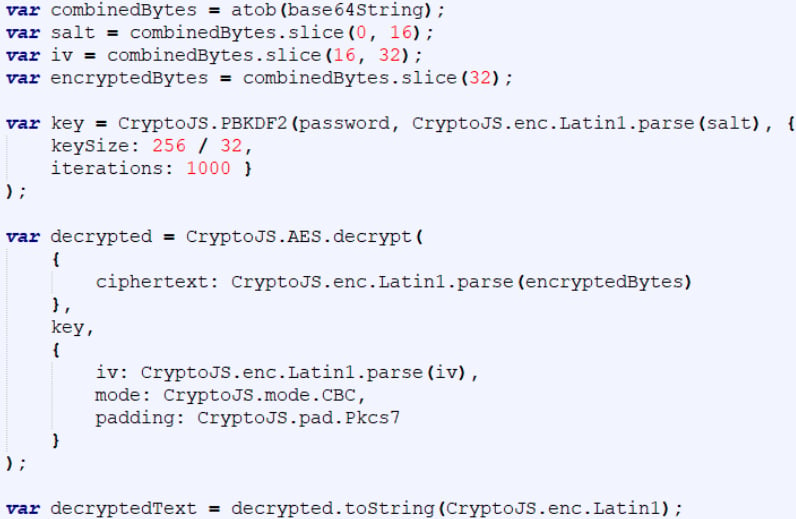

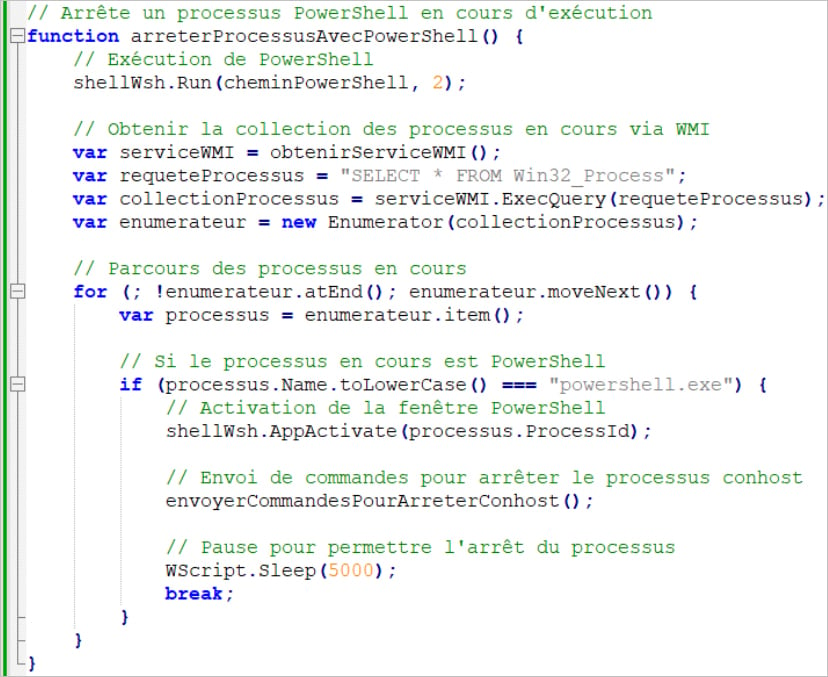

Экспертам удалось извлечь контент архива с помощью брутфорса и проанализировать код. Последнее было не так сложно сделать, поскольку авторы старательно напичкали его комментариями.

Именно наличие такого количества комментариев и выдало руку ИИ: