В конце января F.A.C.C.T. зафиксировала новые атаки кибергруппы Shadow, она же Comet, на территории России. Вооруженные шифровальщиками злодеи теперь называют себя DARKSTAR.

Тактики и техники Shadow, по словам аналитиков, не изменились, инструменты тоже остались прежними: для несанкционированного доступа — AnyDesk и ngrok, для шифрования файлов — LockBit 3 (Black) и Babuk.

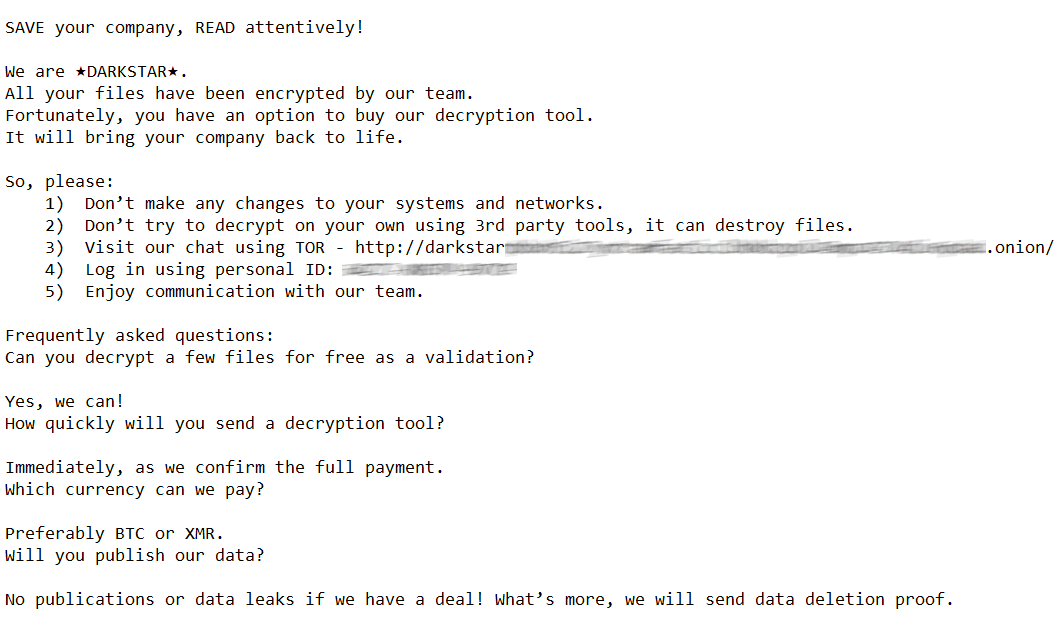

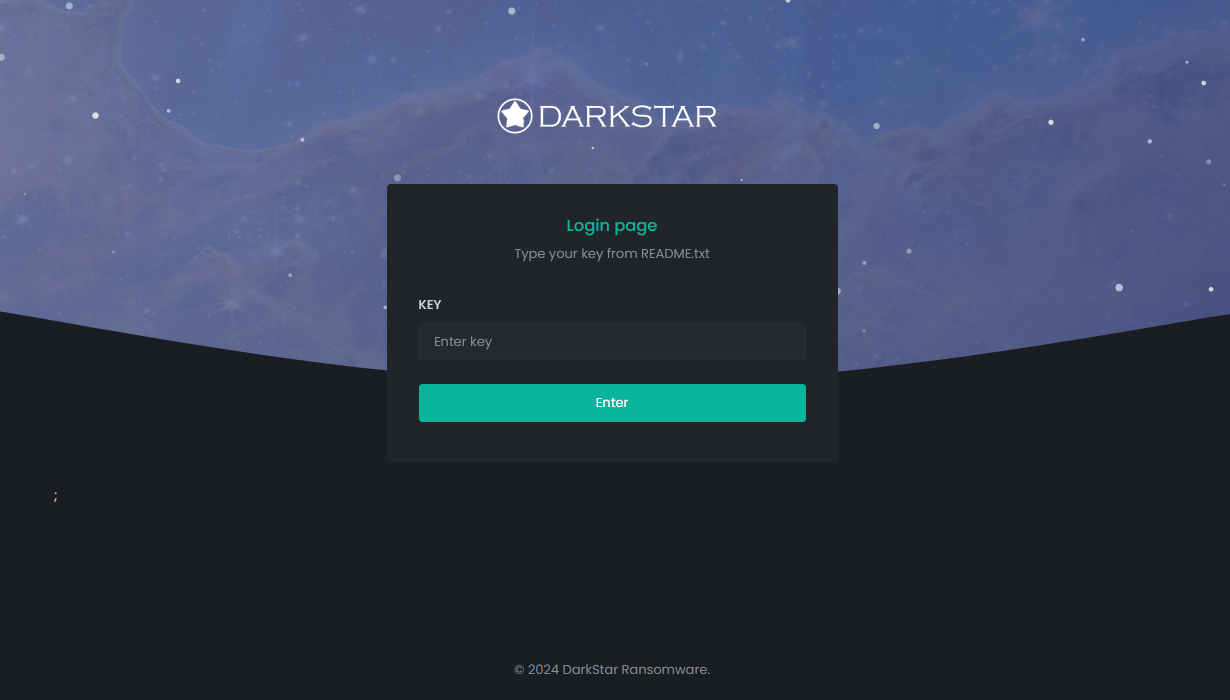

Новое имя было обнаружено и в записке с требованием выкупа, и на сайте, созданном для переговоров с жертвами.

Логотип на странице входа в панель в сети Tor, по данным F.A.C.C.T., появился 29 января.

Это уже второй ребрендинг Shadow за последние полгода. В сентябре она была переименована в Comet, а в январе 2024 объявилась уже как DARKSTAR.

Собственной площадки для публикации списка жертв и украденных у них данных у кибергруппы так и не появилось. Исследование показало, что свои объявления о продаже добычи эти вымогатели публикуют на чужих ресурсах.

Прошлым летом эксперты F.A.C.C.T. установили, что вымогатели Shadow и с хактивисты Twelve являются одной группой. Последние используют похожие техники и тактики в атаках на российские организации, но с другой целью: они стремятся уничтожить ИТ-инфраструктуру жертв, а деньги их не интересуют.

В прошлом году Shadow/Comet также установила рекорд по величине запрошенного выкупа. Вымогатели потребовали у жертвы 321 млн руб. (около $3,5 млн) при средней для РФ сумме в 53 млн рублей.