Google запускает новую функцию Fake Call Detection, которая должна усложнить жизнь мошенникам, подделывающим номера телефонов и голоса знакомых людей. Технология появится на Android уже в этом месяце. Первыми её получат владельцы смартфонов Pixel, после чего функция начнёт распространяться на другие устройства.

Главная цель новинки — борьба с так называемыми дипфейк-звонками. Речь идёт о ситуациях, когда злоумышленники подменяют номер телефона родственника, коллеги или знакомого, а затем используют ИИ для клонирования его голоса.

Сегодня для создания убедительной голосовой копии достаточно нескольких секунд аудиозаписи из видео, соцсетей или публичных выступлений. Именно поэтому мошенники всё чаще представляются детьми, родителями, руководителями компаний или другими людьми, которым жертва привыкла доверять.

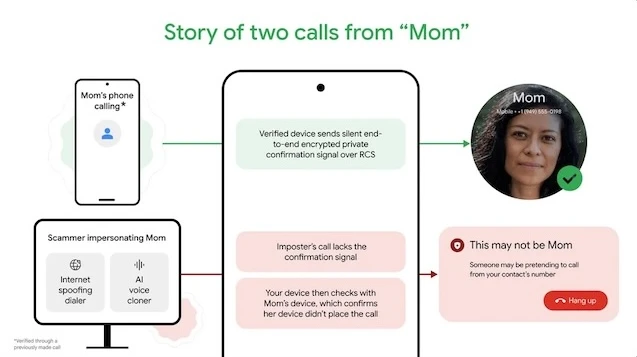

Новая система работает как своеобразная цифровая проверка личности между устройствами. Если оба собеседника используют приложение Phone by Google на Android 12 или более новой версии ОС, смартфоны автоматически обмениваются специальным зашифрованным подтверждением через протокол RCS.

Если звонок действительно поступает с устройства контакта, всё проходит незаметно для пользователя. Но если мошенник подделывает номер, нужного подтверждения не будет.

В этом случае смартфон дополнительно проверит информацию на устройстве контакта. Если окажется, что тот вообще никому не звонит, на экране появится предупреждение о возможном мошенничестве с рекомендацией немедленно завершить разговор.

По словам Google, функция должна стать дополнительным уровнем защиты от атак с использованием голосовых дипфейков, которые в последние годы становятся всё более распространёнными. Причём если раньше такие схемы в основном использовались против частных лиц, особенно пожилых людей, то сейчас они всё чаще применяются для атак на компании, сотрудников и руководителей.

Функция будет включена по умолчанию, однако её можно отключить в настройках Phone by Google.