Разработчики WhatsApp (принадлежит корпорации Meta, признанной экстремистской и запрещённой в России) решили не отставать от тренда на борьбу с телефонными и мессенджерными мошенниками. В бета-версии приложения для Android обнаружили новую функцию под названием Scam Alert, которая будет предупреждать пользователей о подозрительных сообщениях.

Главная особенность новинки в том, что она не ломает сквозное шифрование. В отличие от некоторых систем защиты, которые требуют анализа переписки на стороне сервера, WhatsApp собирается проверять сообщения прямо на устройстве пользователя.

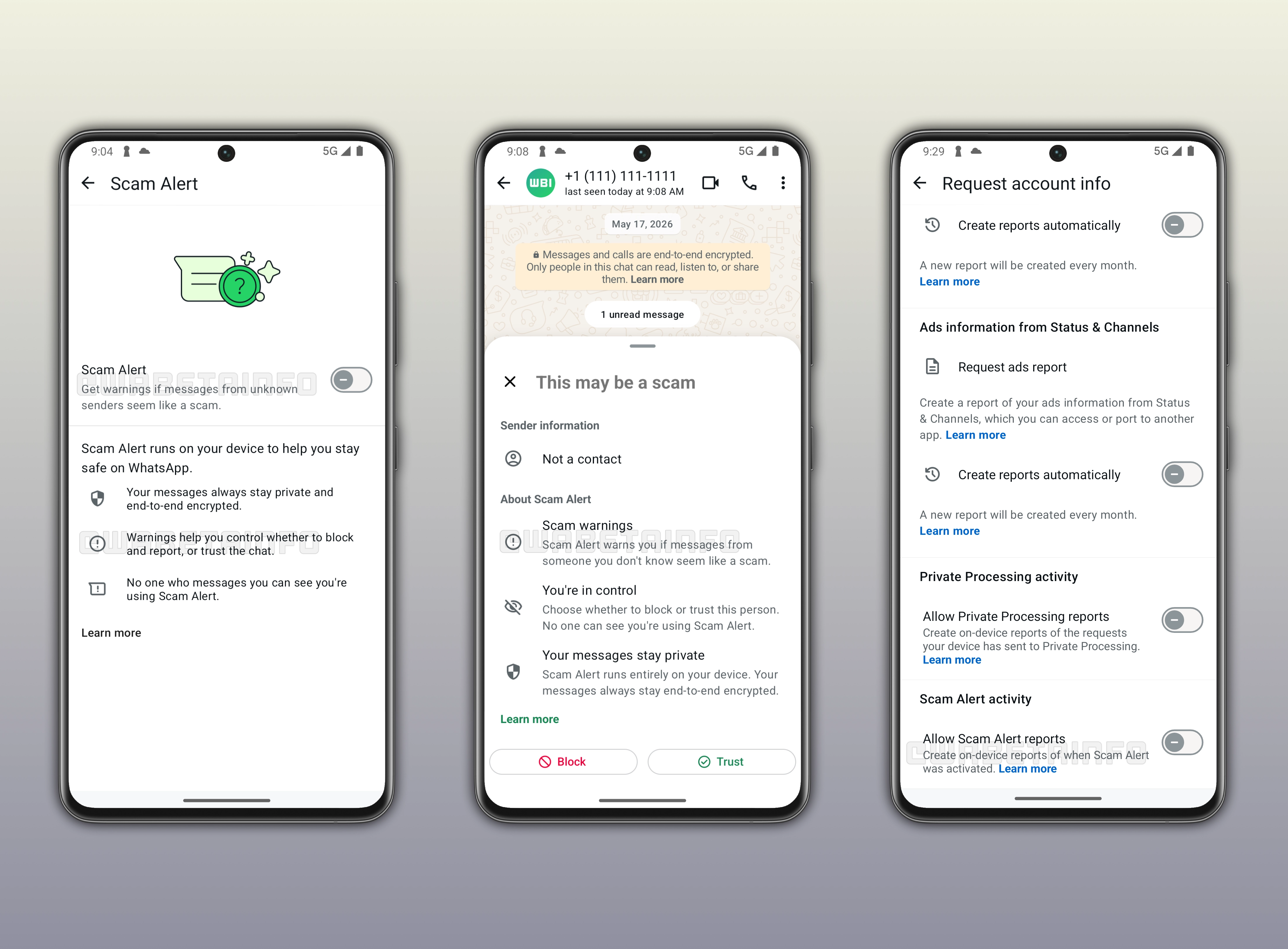

По данным WABetaInfo, функция была замечена в версии WhatsApp Beta 2.26.22.2. Если система сочтёт сообщение от неизвестного контакта подозрительным, она покажет предупреждение и предложит два варианта действий: заблокировать отправителя или продолжить общение, если пользователь уверен, что это не мошенник.

При этом WhatsApp не будет автоматически блокировать сообщения и принимать решения за владельца аккаунта. Сервис ограничится предупреждением и оставит последнее слово за пользователем.

Разработчики отдельно подчёркивают, что анализ выполняется локально. Сообщения не отправляются на внешние серверы, а содержимое переписки остаётся защищённым сквозным шифрованием. Более того, собеседник не сможет узнать, что пользователь включил Scam Alert.

Судя по описанию функции, её главная задача — помочь в борьбе с классическими мошенническими схемами, когда злоумышленники пишут с неизвестных номеров, представляются сотрудниками банков, госорганов или служб доставки и пытаются выманить деньги или персональные данные.

Есть и ещё один нюанс: функция будет отключена по умолчанию. Чтобы получать предупреждения, пользователям придётся самостоятельно активировать её в настройках приложения.

Когда Scam Alert появится в стабильной версии WhatsApp, пока неизвестно. Но сам факт появления такой функции выглядит вполне логично. Мошенников в мессенджерах становится всё больше, а желание сохранить сквозное шифрование никуда не исчезло. WhatsApp тут пытается усидеть сразу на двух стульях: защитить пользователей и при этом не заглядывать в их переписку.