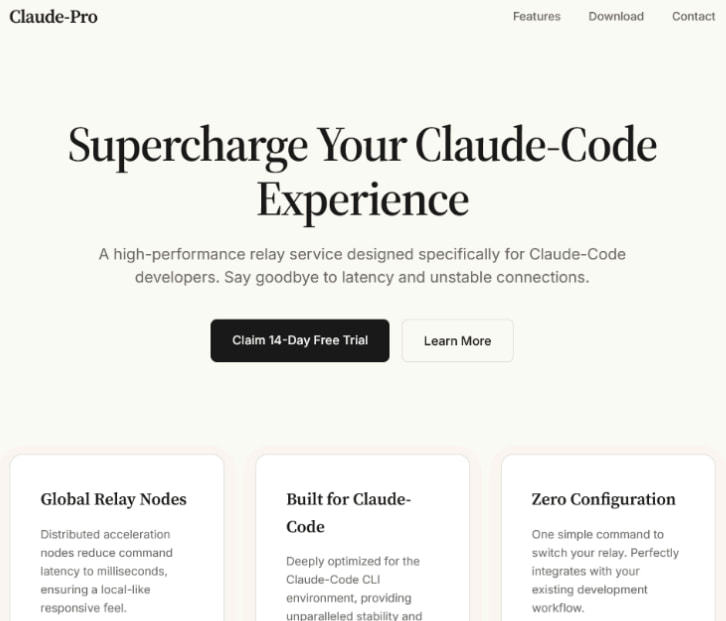

Исследователи Sophos обнаружили фейковый сайт Claude AI, через который распространяют вредоносную программу для Windows. Ресурс имитирует страницу популярного ИИ-сервиса Claude и предлагает скачать якобы Claude-Pro Relay — высокопроизводительный сервис для разработчиков, использующих Claude Code.

На деле загрузка ведёт к архиву Claude-Pro-windows-x64.zip размером около 505 МБ. Внутри находится MSI-установщик, который выглядит как легитимный продукт, но параллельно разворачивает вредоносную цепочку.

По данным Sophos, после запуска на устройство добавляются три файла в папку автозагрузки: NOVupdate.exe, NOVupdate.exe.dat и avk.dll. Исследователи Malwarebytes ранее отмечали, что установщик является троянизированной копией Claude: внешне программа может работать как ожидается, но в фоне запускает вредоносную цепочку PlugX.

Sophos выяснила, что одним из этапов атаки стал загрузчик DonutLoader, который подтягивает ранее неизвестный бэкдор для Windows. Его исследователи назвали Beagle. Это не тот старый червь Beagle / Bagle из 2004 года, а новый инструмент.

Функциональность Beagle пока только базовая: он может выполнять команды, загружать и скачивать файлы, создавать и удалять директории, переименовывать файлы, просматривать содержимое папок и удалять себя из системы. Но даже такого набора достаточно, чтобы закрепиться на компьютере и управлять им удалённо.

В атаке используется сторонняя загрузка DLL. Злоумышленники берут подписанный файл обновления решений G Data — NOVupdate.exe — и заставляют его загрузить вредоносную библиотеку avk.dll. Затем DLL расшифровывает и запускает содержимое файла NOVupdate.exe.dat прямо в памяти, чтобы усложнить обнаружение.

Бэкдор связывается с командным центром license[.]claude-pro[.]com по TCP через порт 443 или UDP через порт 8080. Обмен данными защищён жёстко заданным AES-ключом. По данным исследователей, сервер размещался на IP-адресе из диапазона Alibaba Cloud.

Sophos также нашла похожие образцы Beagle, загруженные на VirusTotal с февраля по апрель. Они распространялись уже через другие цепочки атак: с использованием бинарных файлов Microsoft Defender, shellcode AdaptixC2, PDF-приманок и фейковых сайтов обновлений под видом CrowdStrike, SentinelOne и Trellix.

Точно связать кампанию с конкретной группировкой исследователи пока не смогли. Однако они допускают, что операторы, связанные с PlugX, могут тестировать новый пейлоад.

Пользователям советуют скачивать Claude только с официального сайта и не доверять рекламным или подозрительным результатам поиска. А появление на системе файлов NOVupdate может быть серьёзным признаком компрометации.