В Сети обнаружили очередную слитую базу пользовательских данных, которая насчитывает более миллиарда учётных записей. На этот раз пострадали зарегистрированные на площадках онлайн-магазинов люди, а также любители видеоигр.

Об утечке сообщила команда Cyble Research, которая и раньше писала о компрометации данных пользователей.

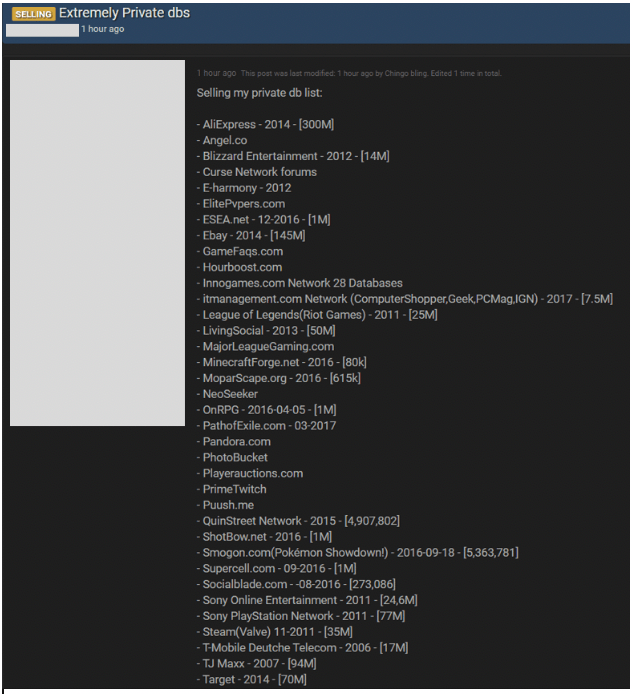

По словам специалистов, в процессе очередного сканирования форумов дарквеба они наткнулись на огромную базу данных. Как утверждал продавец БД, в ней содержались сведения «о миллиардах аккаунтов».

Дальнейший анализ показал, что в базе содержатся данные пользователей онлайн-магазинов и геймеров. Наибольшее количество скомпрометированных аккаунтов насчитывают следующие площадки:

AliExpress (300 млн), eBay (145 млн), Sony PlayStation Network (77 млн), Steam (35 млн).

Исследователи до сих пор пытаются выяснить точную сумму, запрошенную продавцом базы данных.

Ранее Cyble сообщала об утечке баз данных сразу трёх хакерских форумов — Sinful Site, SUXX.TO и Nulled. Также эта компания в мае писала о продаже 550 млн украденных пользовательских данных.