Исследователи обнаружили, что Google прячет три важные настройки конфиденциальности Google Pay за специальным URL. Эти настройки позволяют пользователям ограничить распространение данных о своей кредитоспособности, персональной информации, а также информации об аккаунте Google Pay.

Напомним, что Google Pay представляет собой сервис американской корпорации, позволяющий приобретать товары онлайн, используя сохраненную платежную информацию.

Как у всех похожих онлайн-сервисов, у Google Pay есть своя страница настроек, на которой пользователи могут сконфигурировать различные опции, относящиеся к работе сервиса.

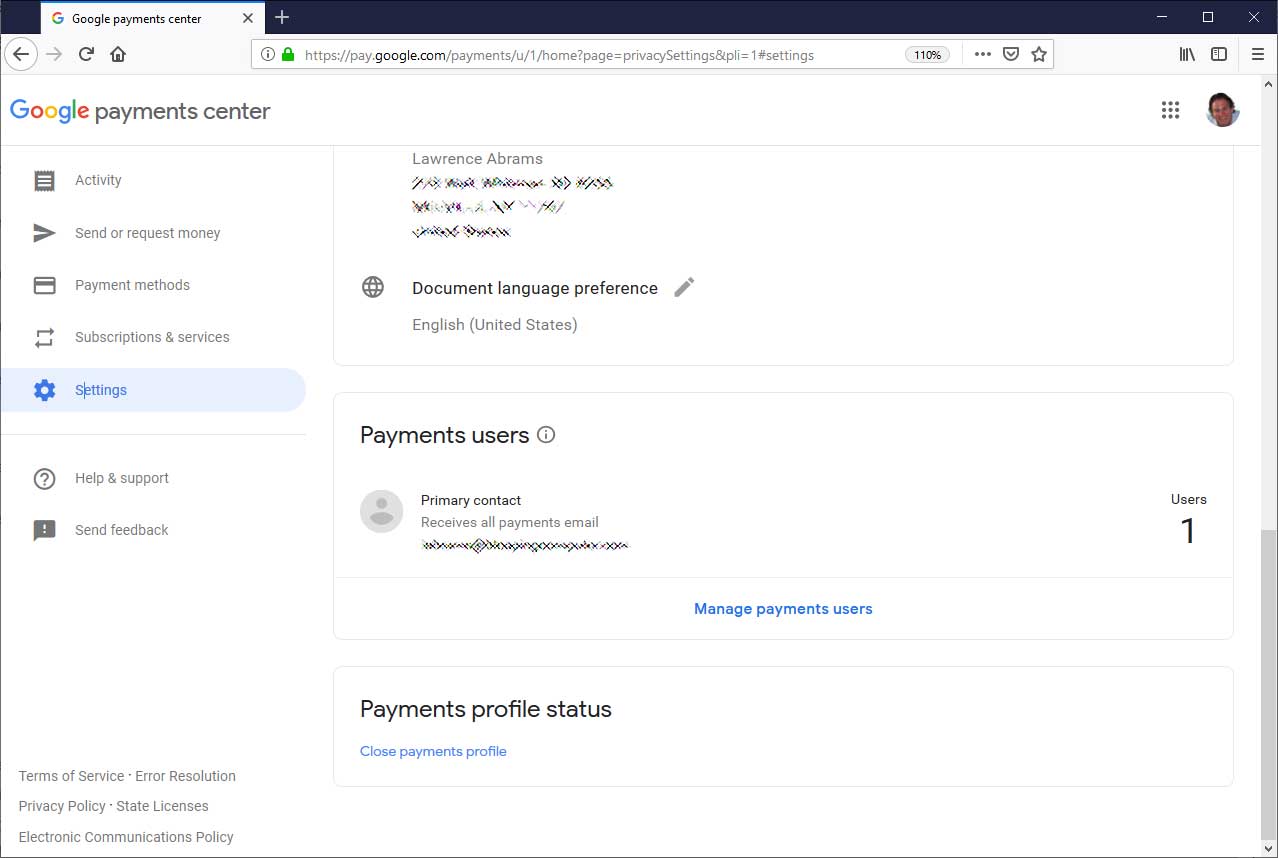

На саму станицу настроек можно попасть через навигационное боковое меню или с помощью специальной ссылки — https://pay.google.com/payments/u/0/home#settings. Там пользователь может указать свой адрес и другую информацию.

Однако исследователи обратили внимание, что на странице настроек нет опций, отвечающих за конфиденциальность.

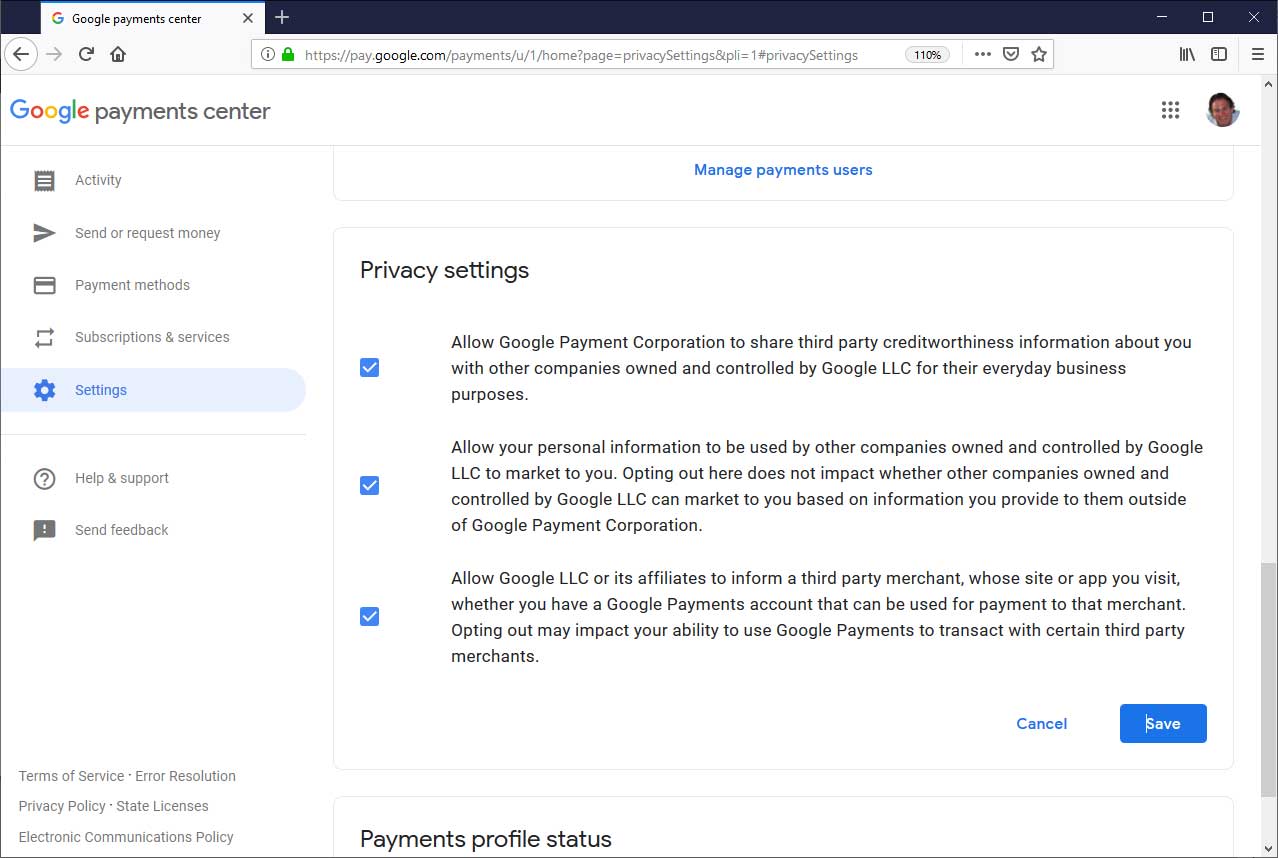

С другой стороны, если зайти на страницу настроек Google Pay, используя другой URL, — https://pay.google.com/payments/u/0/home?page=privacySettings#privacySet..., появляются три дополнительные настройки конфиденциальности.

Стоит отметить, что все три опции активированы по умолчанию, что на деле означает наименьший уровень конфиденциальности для пользователя.

Google уже отреагировала на отчет экспертов, заявив, что это недоразумение исправлено — теперь все пользователи могут получить доступ к настройкам конфиденциальности с соответствующей странице.