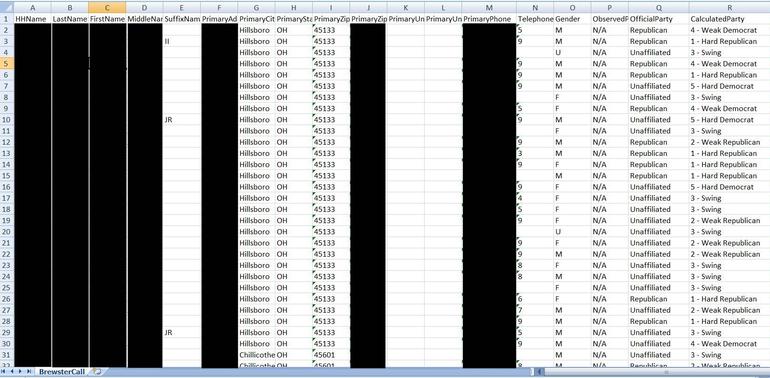

Positive Technologies сообщила о разработке нейросети MOLOT, предназначенной для поиска вредоносного кода в проектах на Python, JavaScript и TypeScript. Технология уже используется в составе анализатора исходного кода PT Application Inspector версии 6.0.

В отличие от традиционных инструментов статического анализа, которые ищут опасные конструкции по заранее заданным правилам, новая модель анализирует последовательность действий, выполняемых программой.

Нейросеть оценивает не отдельные фрагменты кода, а их совокупность и пытается определить, формируют ли они подозрительный сценарий.

Проблема, которую пытаются решить разработчики, связана с так называемым намеренно внедрённым вредоносным кодом. В отличие от обычных уязвимостей, такой код не содержит ошибок, которые можно эксплуатировать извне. Он работает как легитимная часть приложения и использует те же права доступа, что и остальная программа.

По словам специалистов, именно поэтому многие подобные закладки остаются незамеченными при стандартных проверках безопасности.

Отдельные действия вредоносного кода сами по себе обычно не вызывают подозрений. Чтение файла, обращение к сети, шифрование данных или запуск процесса встречаются в тысячах обычных приложений. Однако если программа, например, считывает логины и пароли, кодирует их и затем отправляет на внешний сервер, такая последовательность уже может указывать на вредоносную активность.

Для анализа MOLOT строит цепочку действий программы — обращений к файлам, сетевых запросов, запуска процессов, использования криптографических функций и других операций. Затем эта последовательность передаётся в нейросеть, которая обучена отличать типичные сценарии работы приложений от поведения, характерного для вредоносного кода.

В компании утверждают, что тестирование проводилось на вредоносных пакетах из репозиториев PyPI и npm. По словам разработчиков, в ряде тестов модель показала более высокую точность по сравнению с существующими аналогами с открытым исходным кодом.

Одной из особенностей системы стала возможность объяснять свои выводы. Помимо самого вердикта нейросеть показывает строки кода, которые повлияли на решение. Это позволяет специалисту быстро перейти к подозрительному фрагменту и самостоятельно проверить результаты анализа.

Интерес к подобным инструментам растёт на фоне увеличения числа атак через цепочки поставок ПО, вредоносные пакеты в публичных репозиториях и распространения ИИ-инструментов для генерации программного кода.