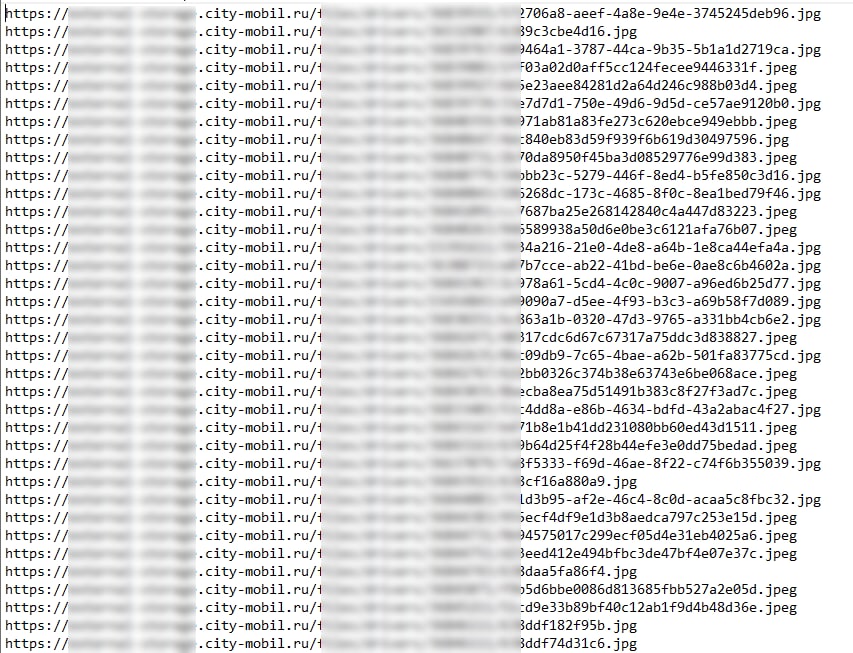

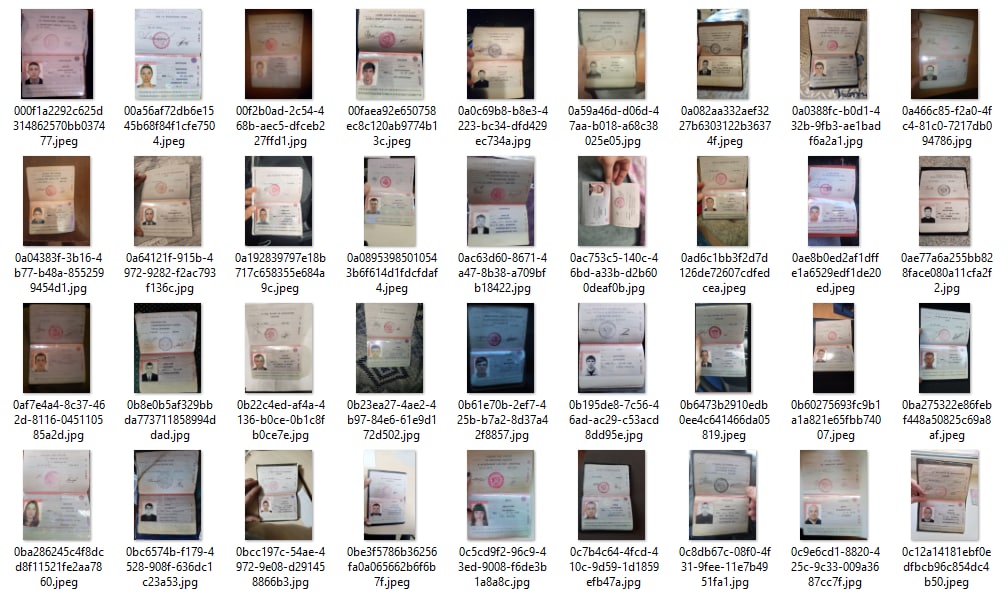

В открытый доступ попали 4 тыс. фото паспортов водителей службы такси “Ситимобил”. Все файлы находились на сайте самого сервиса. Компания извинилась перед партнерами и начала расследование утечки.

"Ситимобил" проводит внутреннее расследование по утечке 4 тыс. фото паспортов водителей, сообщили в пресс-службе компании.

"На данный момент мы проводим внутреннее расследование, хранились ли украденные данные в нашей системе и как могла произойти утечка данных”, — заявили в “Ситимобиле”.

По результатам расследования виновных обещают наказать.

“Мы в любом случае берем на себя ответственность за происходящее, так как мы отвечаем за безопасность данных на наших ресурсах", — добавили в пресс-службе.

О том, что на сайте самого сервиса открылся доступ к файлам с паспортами водителей, сообщил Telegram-канал “Утечки информации”. Речь о 4 тыс. сканов документов в формате JPG.

Канал “Утечки Баз Данных” добавляют, что за сливом могут стоять проукраинские хакеры из группировки NLB.

В компании принесли извинения водителям парков-партнеров, чьи личные данные оказались в открытом доступе.

"Также мы сформировали и готовим к отправке уведомление в Роскомнадзор о произошедшей утечке данных в соответствии с законом РФ. Руководством компании создан штаб по детальному разбору данной ситуации с целью не допустить подобных инцидентов в дальнейшем", — отметили в пресс-службе.

Напомним, по новому закону в области защиты персональных данных, в случае утечки компания обязана сообщить об этом Роскомнадзору в первые 24 часа. Еще два дня дают на подачу уведомления о результатах внутреннего реагирования.