Исследователи в области кибербезопасности рассказали о новых рисках, связанных с предварительным просмотром ссылок в популярных мессенджерах. По словам специалистов, соответствующие функциональные возможности могут раскрыть IP-адреса и даже загрузить в фоне на устройство гигабайты данных.

«Отправленные в чат ссылки могут содержать конфиденциальную информацию, предназначенную исключительно для получателей. Это могут быть счета, контракты, медицинские карты и так далее», — объясняет Томми Миск.

Специалист подчеркнул, что отдельные приложения, полагающиеся на серверы для создания предварительного просмотра ссылок, могут нарушать конфиденциальность пользователя. Отправленная в закрытый чат ссылка в результате попадёт в развёрнутом виде на подконтрольные онлайн-площадки.

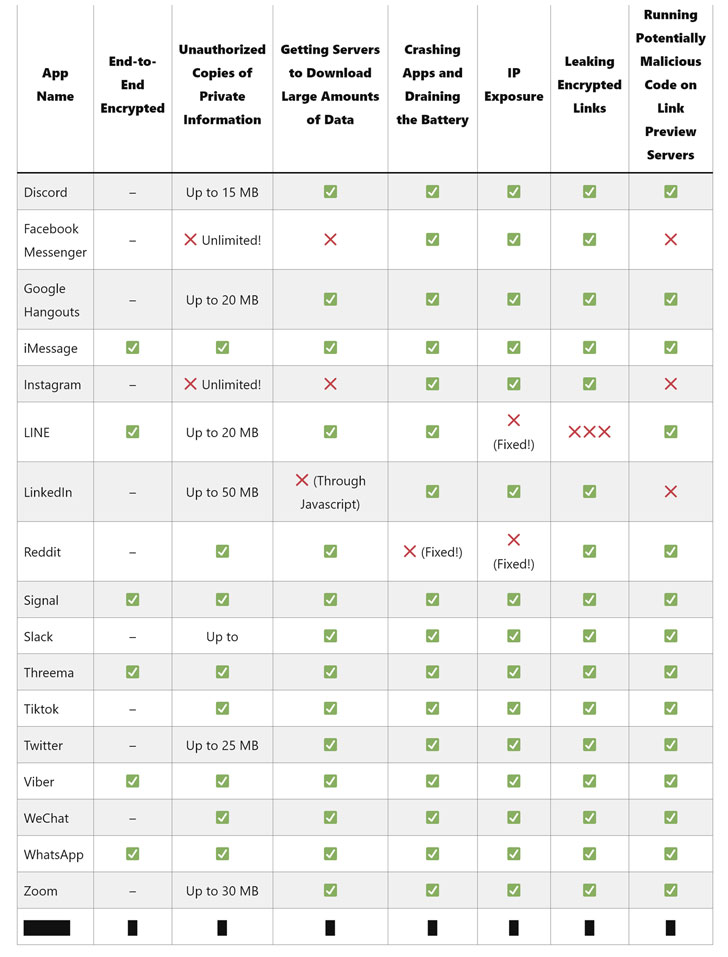

Предварительный просмотр ссылок — крайне распространённая функция в мессенджерах. Однако приложения вроде Signal и Wire позволяют отключить эти функциональные возможности в настройках. Есть и популярные онлайн-сервисы, которые и вовсе не создают предпросмотр: Threema, TikTok и WeChat.

Существует несколько методов генерации предпросмотра ссылок: на стороне получателя, на стороне отправителя, либо же с помощью внешнего сервера. Например, в Apple iMessage, Signal, Viber и WhatsApp используется сторона отправителя.

«Такой подход предполагает, что отправитель должен доверять ссылке, поскольку именно его приложение откроет этот URL», — продолжают исследователи.

А вот генерация превью на стороне получателя создаёт дополнительные риски. Условный злоумышленник может вычислить приблизительное местоположение пользователя, если просто отправит ссылку на управляемый им сервер.

Проблема кроется в том, что мессенджер автоматически открывает URL, чтобы создать превью. При этом параллельно раскрывается IP-адрес пользователя в отправленном на сервер ответе.

Использование внешнего сервера для создания предварительного просмотра тоже порождает вопросы: хранит ли этот сервер копию превью, если да, то как долго.