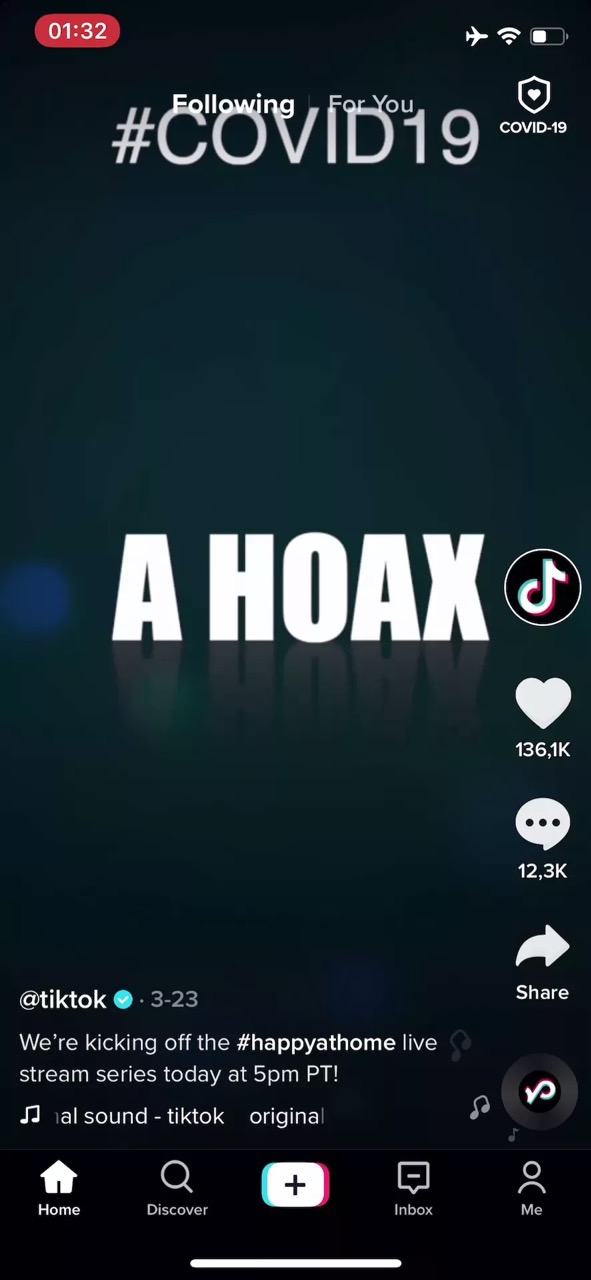

В популярном сервисе для создания коротких видео TikTok нашли опасную уязвимость, которая в умелых руках может стать инструментом для распространения дезинформации. Баг позволяет приписать авторство видео любой учётной записи.

Представьте ситуацию: вы просматриваете ленту в TikTok и в процессе натыкаетесь на незнакомое вам видео, якобы загруженное вашим аккаунтом.

Именно так работает уязвимость, проанализировав которую команда разработчиков пришла к выводу, что потенциальный злоумышленник может переназначить владельца видео на любой аккаунт TikTok.

Как объяснили специалисты, популярный видеосервис использует сети доставки контента (CDN) для эффективной передачи данных по всему миру. Чтобы повысить производительность, эти CDN передают данные по HTTP.

Именно выбор HTTP — а не более защищённого HTTPS — ставит пользователей под угрозу, отмечают разработчики.

«Любой маршрутизатор, расположенный между приложением TikTok и CDN, легко может получить список всех загруженных и просмотренных видео», — пишут эксперты.

«Другими словами, вся история просмотра открыта. Провайдеры общественного Wi-Fi, операторы связи и спецслужбы могут без труда собрать все эти данные».

Разработчики опубликовали на YouTube видеоролик, в котором демонстрируется эксплуатация данной уязвимости.