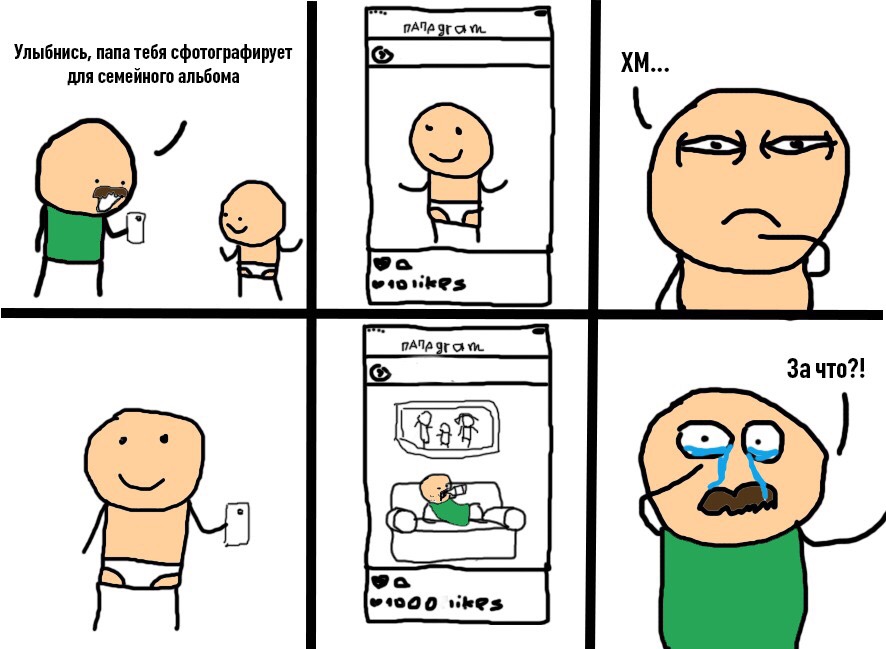

Роскомнадзор рассказал о рисках, которые могут подстерегать детей в Сети. В Международный день защиты детей российское ведомство посоветовало родителям с большой осторожностью подходить к публикации фотографий своих малышей в социальных сетях.

По мнению Роскомнадзора, такие материалы могут быть использованы различного рода преступниками, а также просто недоброжелателями. Свою позицию ведомство обозначило в социальной сети «ВКонтакте». В посте говорится следующее:

«Ежедневно во френдлентах социальных сетей можно встретить тысячи фотографий детей, которые они публикуют. При этом, стремясь поделиться со всем миром своим маленьким большим счастьем, они, к сожалению, не осознают всех связанных с такой контент-стратегией рисков».

В понимании Роскомнадзора риск представляет сам факт наличия множества фотографий ребенка в интернете, среди которых могут быть материалы, сделанные в младенчестве и раннем детстве.

Все это, по мнению ведомства, может привести к травле ребенка, для которой одноклассники будут использовать его фотографии.

«Сеть помнит все, ничего удалить оттуда невозможно».

Также Роскомнадзор рассказал и о более серьезных рисках использования фотографий малышей. Например, педофилы:

«А самое страшное происходит, когда эти фотографии начинают использовать преступники. Например, в последнее время мы фиксируем много сайтов, на которых педофилы публикуют собранные в соцсетях фото детей».

Наконец:

«Дорогие родители, не забывайте, ваш ребенок имеет все те же права на конфиденциальность, как и вы. И то, что он не может их сознательно выразить, не означает его одобрения ваших публикаций».