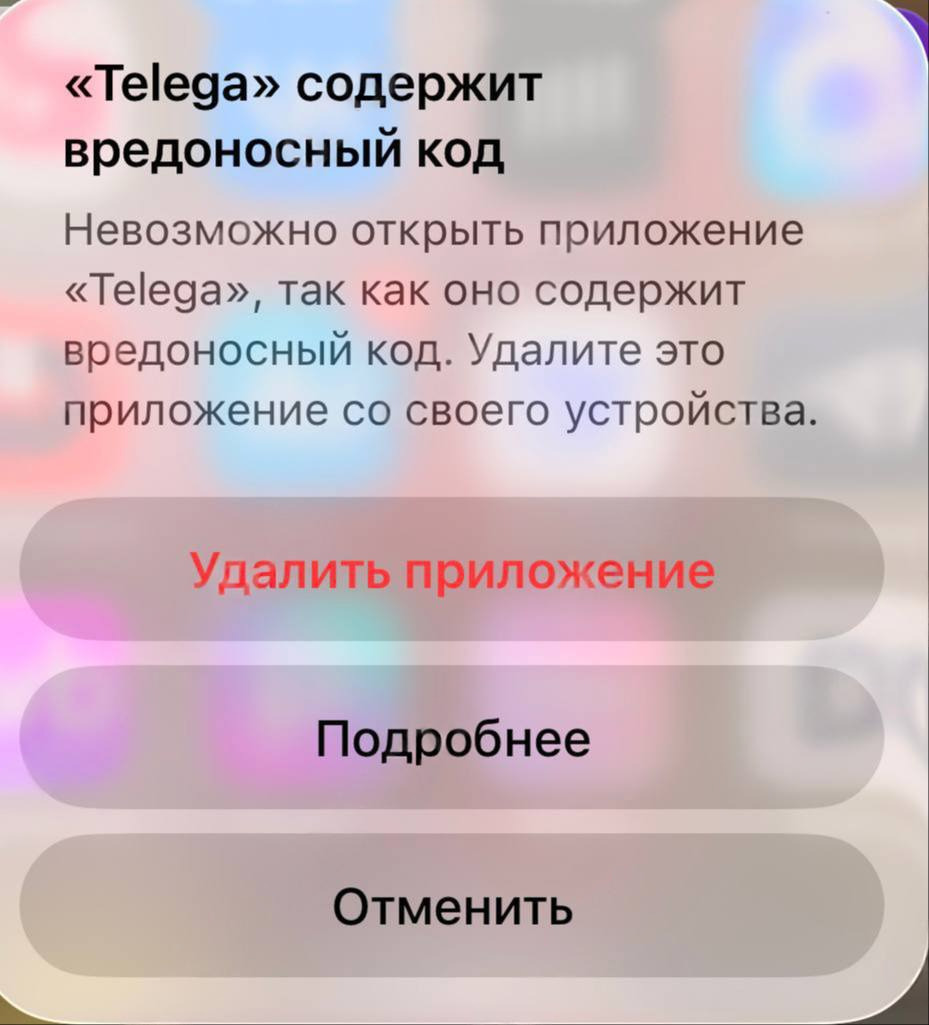

У пользователей iPhone начались проблемы с альтернативным клиентом Telegram «Телега». После удаления приложения из App Store 9 апреля Apple, судя по сообщениям пользователей, начала дополнительно помечать уже установленную версию как потенциально опасную: iOS не даёт открыть приложение, оно вылетает, а система рекомендует удалить его с устройства.

При этом сама Телега действительно пропала из App Store, тогда как в Google Play и RuStore приложение по-прежнему доступно.

Официальные комментарии Apple с прямым объяснением именно по этому клиенту пока не опубликованы. Но сама механика такого предупреждения у iPhone существует.

Apple отдельно описывает сценарий, при котором iOS блокирует запуск приложения, если считает, что оно содержит вредоносный код, и предлагает пользователю удалить его.

Источник: «Хабр»

Разработчики Телеги ранее объясняли исчезновение приложения из App Store по-своему. В проекте заявили, что временное удаление могло быть связано с волной негативных отзывов после введения списка ожидания для новых пользователей.

По их версии, это могли неверно интерпретировать модераторы Apple. Однако на фоне этой истории у Telega уже был и другой, куда более неприятный контекст.

Ещё 20 марта в сети появился анонимный материал с техническим разбором клиента Телега для Android, где авторы утверждали, что в приложении якобы была активирована скрытая функциональность для перехвата данных между клиентом и серверами Telegram.

В публикации речь шла о схеме «Человек посередине», при которой трафик проходит через инфраструктуру самой Телеги. Позже на эту историю обратили внимание и профильные площадки, а Telegram, по данным профильных СМИ, начал отдельно помечать аккаунты пользователей неофициальных клиентов предупреждением о рисках.

Кроме того, на прошлой недели энтузиасты разобрали Android-версию Телеги и выяснили, что клиент мог читать переписку пользователей.

Интересно также, что Cloudflare в этом месяце признал домены Телеги шпионскими.