Онлайн-платформа DEOSGames, ориентированная на ставки и игры, сообщила о кибермошенниках, которым удалось похитить почти $24 000. Благодаря нащупанной уязвимости некому злоумышленнику удалось 24 раза подряд сорвать джекпот.

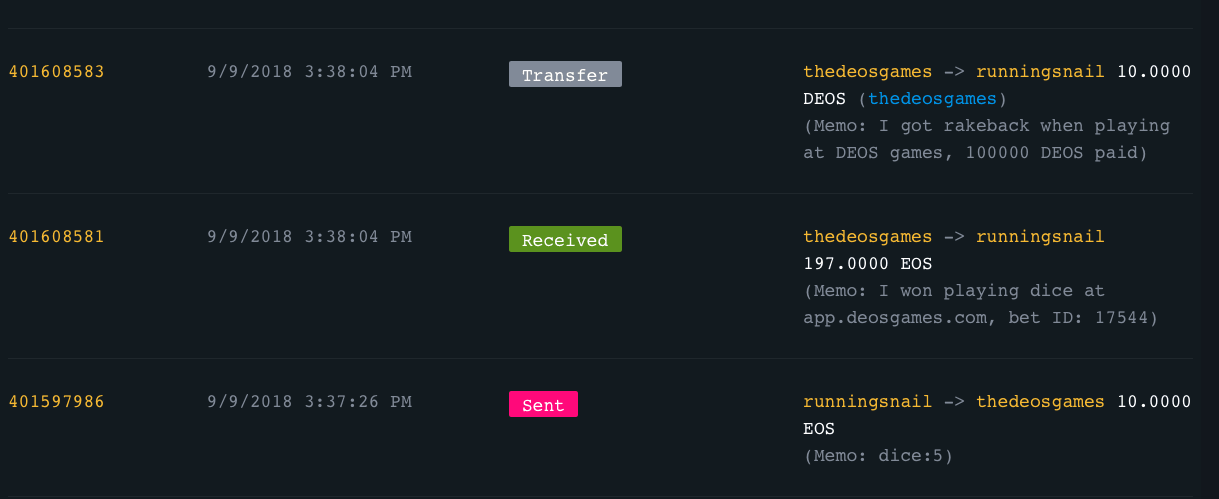

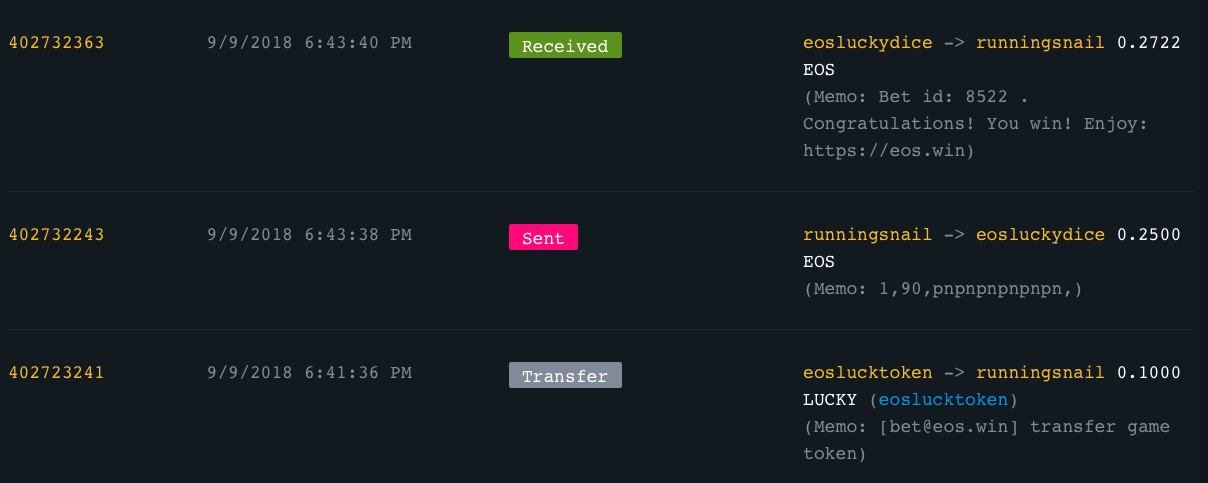

В итоге аккаунт с именем «runningsnail» покинул платформу с общим выигрышем в размере 4 728 EOS (эта сумма эквивалентна $23 640). Эта учетная запись была создана всего лишь за день до начала вредоносной кампании.

Отследив транзакции через проводник блокчейна EOS, можно увидеть, что джекпот в размере почти 1000 долларов США регулярно выпадал аккаунту с именем «runningsnail».

Все говорит о том, что подобные «выигрыши» происходили автоматически — джекпот оплачивался в среднем за 30 секунд. Сообщается, что «runningsnail» оставил большую часть своего выигрыша. Также есть сообщения о том, что злоумышленник уже выбирает себе новую цель.

DEOSGames уже подтвердила факт наличия эксплойта через свои официальные каналы связи.

«Вчера нас атаковали с помощью эксплойта. Это был хороший урок, который позволил нам улучшить безопасность наших активов», — говорится в уведомлении онлайн-платформы.

Напомним, что в этом месяце Bittrex, одна из крупнейших криптовалютных бирж, убрала Bitcoin Gold (BTG) со своей платформы. Причиной такому решению послужил отказ BTG покрыть половину убытков, которые понесла Bittrex в ходе сложной кибератаки, которая произошла в начале этого года.