Британский киберпреступник, взломавший более десятка предприятий, похитивший информацию о платежных картах, а также совершивший фишинговые атаки, отправился в тюрьму. Злоумышленник попался на то, что продавал конфиденциальные данные в даркнете и публиковал инструкции для киберпреступников.

26-летний Грант Уэст, проживающий в Ширнессе, признался в нескольких эпизодах, включая заговор с целью совершения мошенничества и компьютерные преступления.

Лондонским судом Уэст был приговорен к 10 годам и восьми месяцам лишения свободы. Судья отметил, что данный случай — повод для многих клиентов и компаний задуматься над безопасностью своих данных.

Уэст признался в целевых атаках на 100 с лишним предприятий по всему миру, которым он рассылал фишинговые письма в надежде украсть адреса и пароли клиентов этих компаний. Согласно правоохранителям, злоумышленник начал торговать полученными данные в даркнете в марте 2015 года.

В итоге киберпреступнику удалось реализовать более 47 000 удачных продаж конфиденциальной информации.

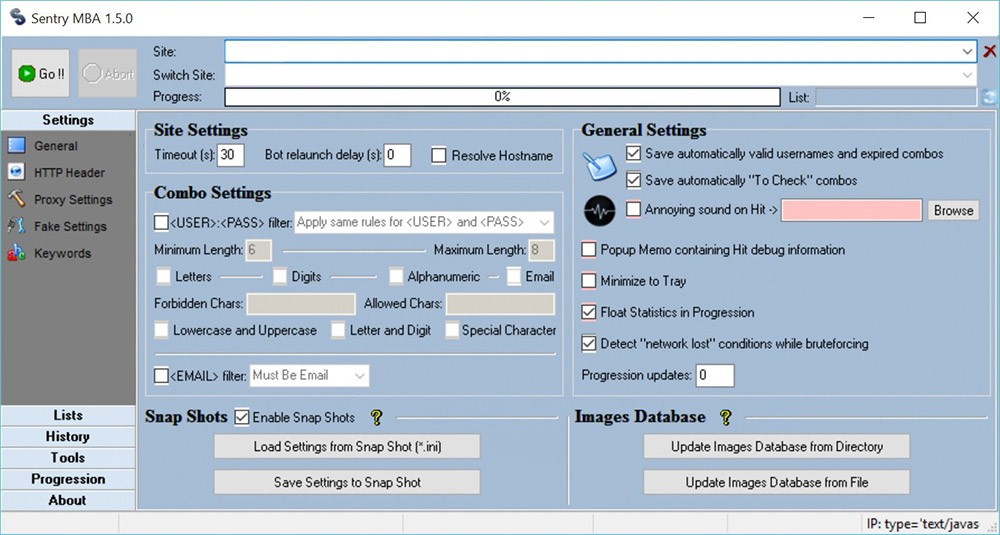

Обвинители также уточнили, что Уэст использовал популярный инструмент для изъятия конфиденциальных данных, известный под названием Sentry MBA. Используя этот инструмент, преступник совершал атаки брутфорс.