Из реестра российского программного обеспечения исключили BIOS компании «Рикор». Запись удалили по поручению Минцифры от 12 мая 2026 года. Формальная причина звучит так: сведения в реестре стали неактуальными, а правообладатель не ответил на запрос ведомства об их обновлении.

В Минцифры пояснили, что направляли компании запрос о необходимости актуализировать данные. Ответа не последовало, поэтому по правилам ведения реестра продукт можно было исключить.

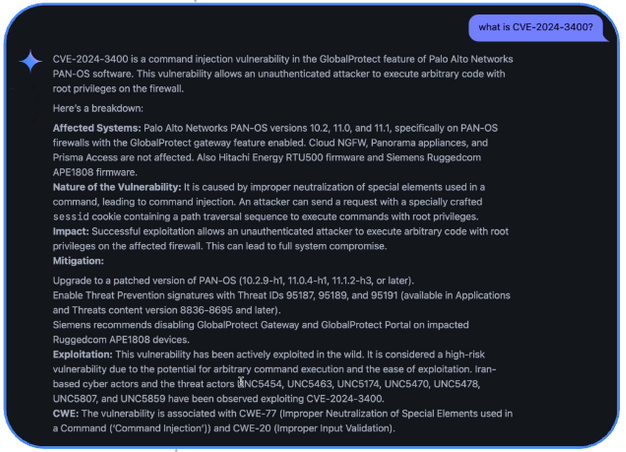

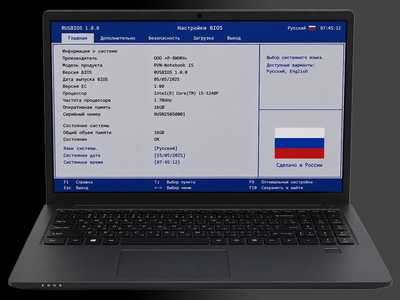

Речь идёт не о рядовой утилите, а о BIOS — низкоуровневом системном ПО, которое первым просыпается при включении устройства, инициализирует оборудование и запускает дальнейшую загрузку.

Для производителей серверов, десктопов и промышленной техники наличие отечественной системы ввода-вывода может быть важным аргументом в закупках, особенно государственных.

«Рикор» объявил о создании российского аналога BIOS ещё в 2018 году, а в реестр российского ПО продукт внесли в 2023-м. Исключённая версия была совместима со спецификацией UEFI и предназначалась для ноутбуков, моноблоков, персональных компьютеров, промышленных ПК, тонких клиентов и других устройств на базе x86-процессоров AMD и Intel.

В самой компании заявили, что старая запись действительно потеряла актуальность. По словам гендиректора «Рикор Групп» Бориса Иванова, из продуктовой линейки убрали серверы на базе AMD, а сейчас вводят серверы на Intel Xeon Gen4/Gen5. Кроме того, разработку ПО выделили в отдельное юрлицо — «Рикор ИИ».

Продлевать реестровую запись от 1 марта 2023 года компания не планирует. Новые заявки в Минцифры, включая ПО базового ввода-вывода, «Рикор» собирается подавать уже от имени «Рикор ИИ».

По данным CNews, в реестре Минцифры сейчас остаётся больше трёх десятков вариантов российских BIOS. При этом участники рынка признают: часть решений может быть создана на базе зарубежного исходного кода с доработками под конкретные устройства.