Пока одни ностальгируют по первой PlayStation, другие берут паяльник и пытаются сделать её лучше, чем она когда-либо была. Именно этим занялся моддер с ником thedrew (он же Secret Hobbyist), который решил собрать «идеальную» PS1, объединив сразу две версии консоли.

Напомним, оригинальная PlayStation вышла в 1994 году и задала тон всей индустрии 3D-игр.

А спустя несколько лет появилась компактная PS One — более энергоэффективная и холодная, но с упрощённой аудиосистемой. В итоге у каждой версии были свои плюсы и минусы. И вот теперь энтузиаст решил взять от них всё лучшее.

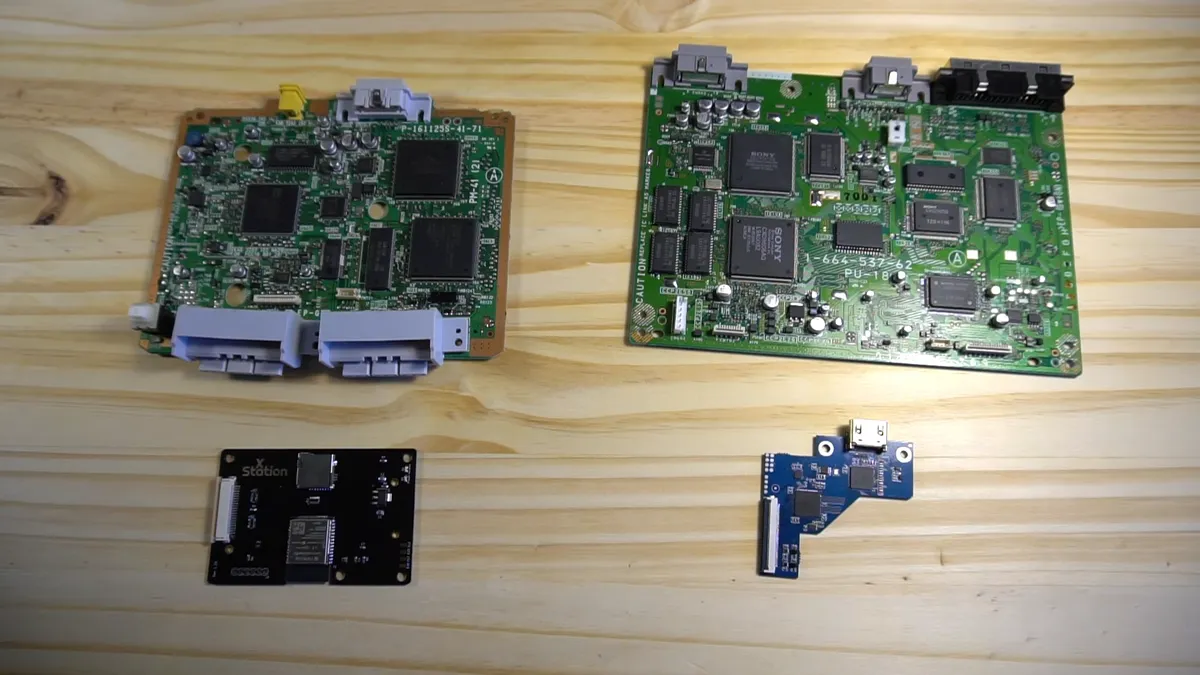

В новой гибридной консоли он использовал процессор, графику и память от PS One за их энергоэффективность. А вот аудиочип, контроллер CD-привода и BIOS позаимствовал у оригинальной PS1, чтобы сохранить качество звука и совместимость.

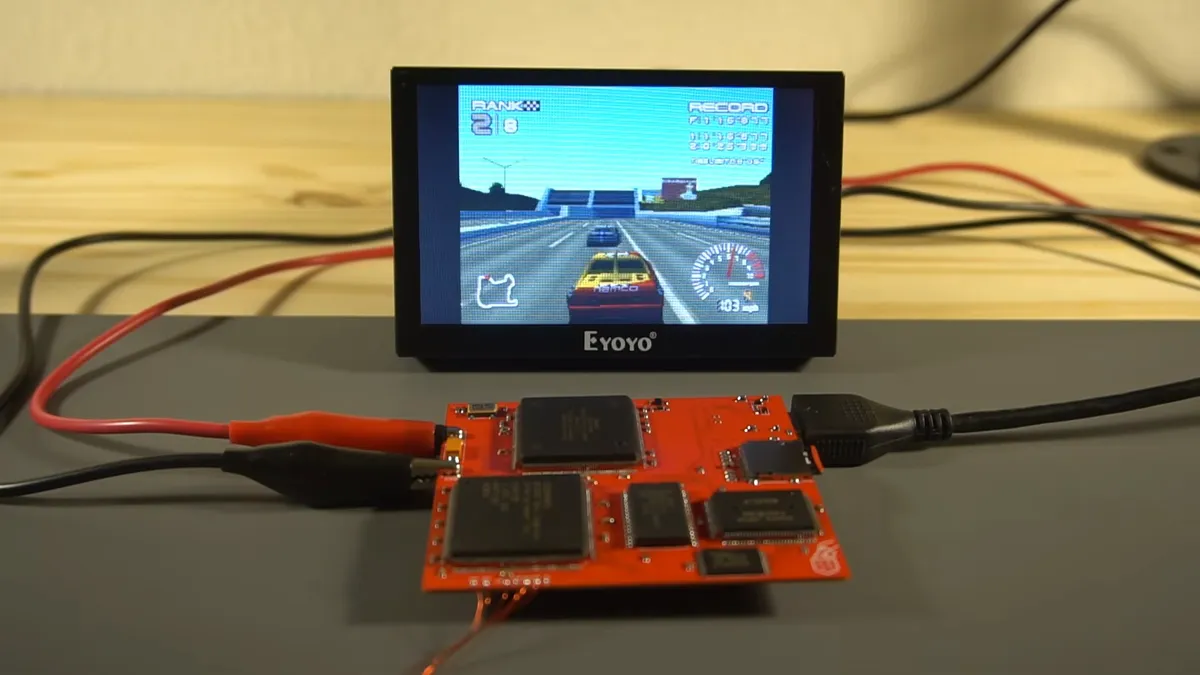

Всё это надо было не просто «скрутить проводами», а аккуратно пересобрать на собственной плате. Моддер выпаял нужные чипы с обеих консолей и перенёс их на кастомный PCB, фактически создав новую материнскую плату с нуля.

Но на этом он не остановился. В проект сразу встроили ещё два популярных мода. Первый — XStation, который позволяет запускать игры с microSD вместо дисков. Второй — HDMI-мод с FPGA, подключающийся напрямую к GPU и выдающий картинку вплоть до 1080p (с апскейлом с 480p). Причём даже с эффектом сканлайнов, как на старых CRT-телевизорах.

В итоге получилась компактная и очень экономичная система: вся плата потребляет меньше 2 ватт и работает от 3 вольт. По сути, это уже задел под портативную версию консоли.

Правда, проект пока ещё не завершён. Корпуса нет, питание подаётся «напрямую» через зажимы, а некоторые элементы вроде разъёма для карты памяти пока висят на проводах. Но главное — консоль уже работает, а игры на ней запускаются без проблем.