Специалисты по ИБ попытались выяснить, сможет ли хайповый ChatGPT облегчить жизнь компьютерным криминалистам и командам реагирования на киберинциденты. Результаты экспериментов показали, что умный чат-бот подает надежды как помощник, но ему еще нужно учиться и учиться.

Построенный на основе нейросети ChatGPT быстро набрал популярность; по данным Similarweb, за два месяца посещаемость сайта разработчика (OpenAI) возросла с 10 до 25 млн уникальных пользователей в сутки. К сожалению, некоторые из них имеют недобрые намерения: зафиксированы попытки использовать бесплатный инструмент для создания зловредов.

В связи с этим в ANY.RUN решили проверить, можно ли также привлечь ChatGPT к анализу вредоносного кода. Исследователи скормили чат-боту несколько скриптов из своей коллекции, дав задание выяснить, как работает код.

Результаты по небольшим фрагментам кода (сценарий сокрытия дисков в Проводнике Windows, скрипт простейшего шифровальщика) оказались обнадеживающими: эксперты получили корректное и детальное описание с выводом о вероятном назначении. Анализировать более сложный код ИИ отказался, а наличие обфускации вызвало ошибку:

Эксперты попробовали переформулировать задание. Это сработало, но ответ их не удовлетворил: вместо того, чтобы попытаться деобфусцировать скрипт, умный помощник заявил, что код нечитаем.

В «Лаборатории Касперского» тоже поэкспериментировали с ChatGPT, чтобы выяснить, насколько он пригоден для ИБ-нужд, в частности, для экспертизы на основе идентификаторов компрометации (IoC). Вначале исследователи проверили, может ли чат-бот принять за угрозу такие широко используемые в атаках инструменты, как Mimikatz и Fast Reverse Proxy.

Результаты оказались многообещающими, как и в случае с классическом методом маскировки — переименованием процессов. Бот также корректно идентифицировал домены, имитирующие легитимные сайты, в том числе используемые FIN7. В качестве обоснования он не стал перечислять хорошо известные IoC, а заявил, что имя домена наводит на мысль о попытке убедить пользователей в его легитимности.

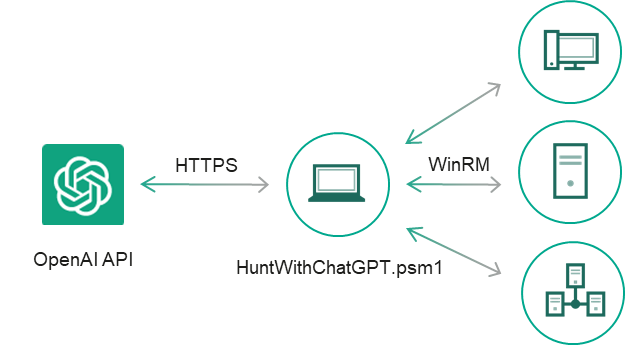

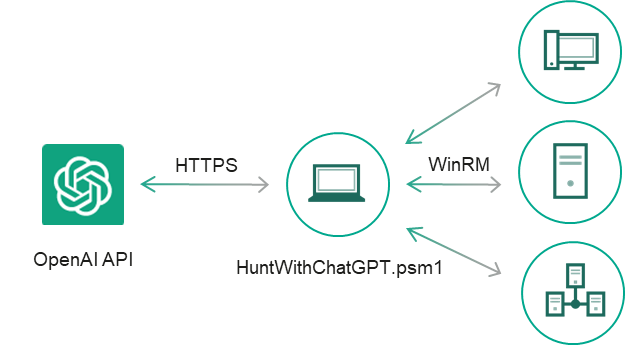

На хешах ChatGPT обломался, он не опознал даже такого хорошо детектируемого зловреда, как WannaCry. Эксперимент с метаданными дал более полезные результаты. Для извлечения метаданных ИИ предложили написать Powershell-скрипт в рамках задачи по выявлению IoC. Созданный ботом сценарий в Kaspersky потом доработали, получив простейший IoC-сканер для удаленной проверки систем с использованием службы WinRM.

Чтобы проверить PoC, в тестовую систему внедрили агенты Meterpreter и PowerShell Empire, а затем сымитировали типовую атаку и запустили IoC-сканер. На выходе эксперты получили отчет, дополненный комментариями ChatGPT; среди 137 запущенных процессов тандем корректно выявил два вредоносных, притом не дал ни одного ложноположительного срабатывания.

Обфусцированные образцы PowerShell не смутили ИИ. Присутствие такой маскировки было не только отмечено, но также уточнено: бот распознал использование XOR, Base64 и подстановки переменных.

Для выявления подозрительных событий, ассоциирующихся с Windows-службами, ChatGPT пришлось слегка притормозить, чтобы избежать когнитивных искажений. В результате ИИ отработал успешно и без ложноположительных срабатываний. Исследователей также порадовал тот факт, что количество событий, которые аналитику пришлось бы верифицировать вручную, значительно сократилось.

|

System metadata

|

Events in dataset

|

Highlighted by ChatGPT

|

# of False Positives

|

|

Running Processes

|

137

|

2

|

0

|

|

Service Installations

|

12

|

7

|

0

|

|

Process Creation Events

|

1033

|

36

|

15

|

|

Sysmon Process Creation events

|

474

|

24

|

1

|

|

PowerShell ScriptBlocks

|

509

|

1

|

0

|

|

Autoruns

|

1412

|

4

|

1

|

Эксперты пришли к выводу, что ChatGPT потенциально сможет оказывать помощь ИБ-исследователям и тестировщикам в решении следующих задач:

- проверка систем на наличие IoC (за неимением EDR);

- корректировка базы сигнатур (сравнение текущего набора правил с выходом ChatGPT);

- обнаружение обфусцированного кода;

- выявление сходства с известными угрозами.

Чтобы эффективно использовать такого помощника, как ИИ, нужно уметь правильно задавать вопросы. К такому выводу пришли в Kaspersky, у ChatGPT может быть другое мнение.