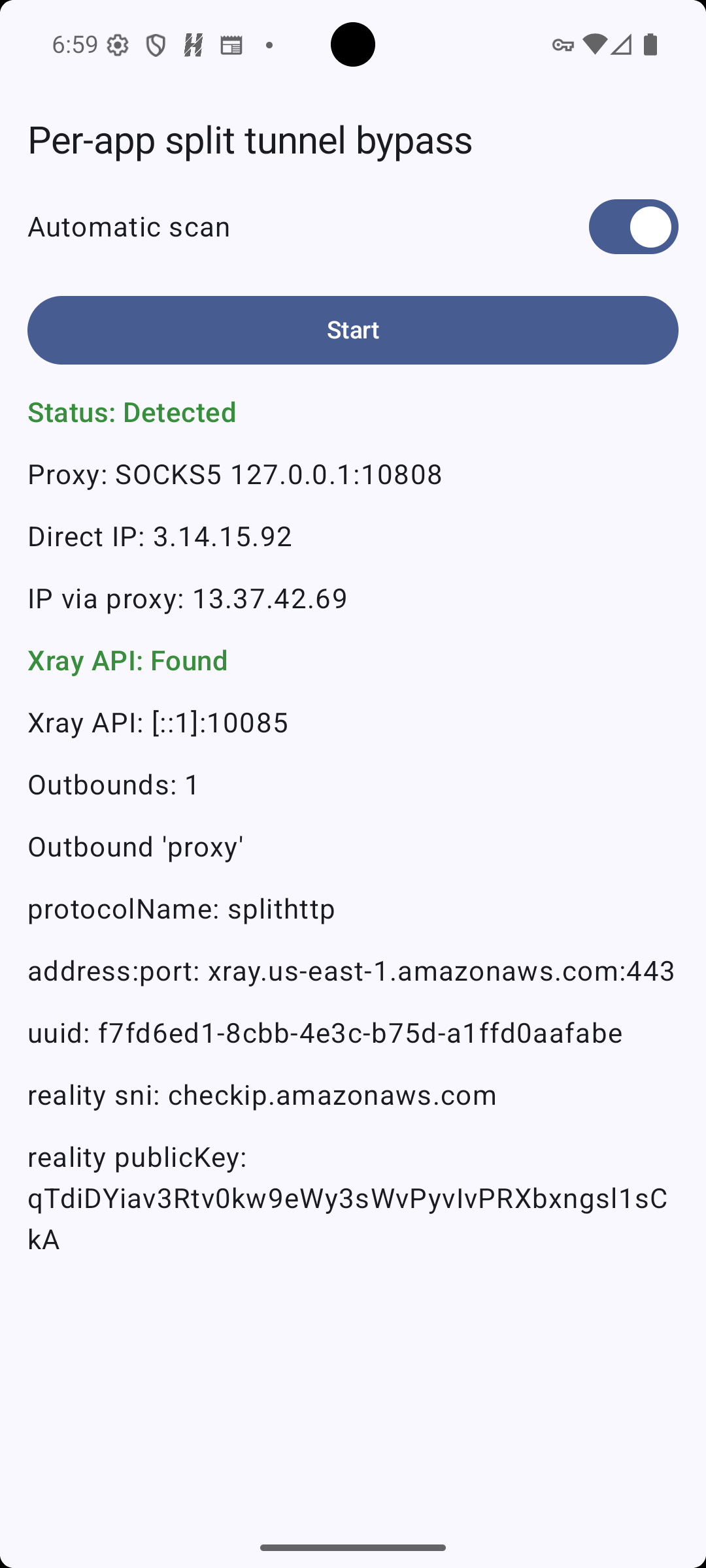

Исследователь с ником runetfreedom утверждает, обнаружил критическую уязвимость сразу в нескольких популярных VLESS-клиентах для мобильных устройств. По словам автора, проблема позволяет обходить механизмы изоляции приложений и выявлять внешний IP-адрес используемого прокси.

Отдельно он выделил клиент Happ, который назвал особенно рискованным. При этом свои выводы автор сопроводил ссылкой на GitHub-репозиторий с демонстрационным эксплойтом (PoC).

По версии runetfreedom, уязвимость затрагивает целый ряд приложений, включая v2RayTun, V2BOX, v2rayNG, Hiddify, Exclave, Npv Tunnel, Neko Box и Happ. Исследователь уведомил разработчиков ещё 10 марта, но на момент публикации статьи, как утверждает автор, ни один клиент полностью проблему не закрыл.

Смысл претензии в том, что часть клиентов, по словам исследователя, поднимает локальный прокси без должной защиты, а это теоретически может открыть дорогу для нежелательного доступа со стороны других приложений на устройстве.

В своём посте runetfreedom отдельно подчёркивает, что речь идёт не просто о неудобстве, а о потенциальной утечке параметров соединения. Впрочем, важно понимать: на данный момент это заявление самого автора публикации, а независимого публичного подтверждения от всех разработчиков перечисленных клиентов пока нет.

Самая жёсткая часть отчёта касается клиента Happ. Автор утверждает, что именно он оказался наиболее уязвимым и потенциально может раскрывать больше данных, чем другие приложения. Позже, в обновлении к публикации, runetfreedom написал, что Happ всё же согласился исправить обе уязвимости. Но в публично доступных источниках пока нет полноценного технического отчёта от разработчиков о том, когда именно выйдет патч и что именно будет закрыто. У Happ при этом есть публичный телеграм-чат, где обсуждается продукт.

Отдельно специалист связывает свои опасения с недавними публикациями о новых мерах против VPN. Ранее мы сообщали, что Минцифры обсуждает с крупнейшими площадками и операторами более жёсткие способы выявления пользователей с включёнными средствами обхода ограничений, а также методические рекомендации для бизнеса.