По данным «Лаборатории Касперского», APT-группа Lazarus, обычно атакующая финансовые организации, в середине прошлого года сменила свои предпочтения и теперь активно интересуется успехами оборонной промышленности. Основным оружием злоумышленников при этом является бесфайловый зловред ThreatNeedle. От шпионских атак Lazarus уже пострадали организации из десятка стран.

Целевые атаки с использованием ThreatNeedle исследователи наблюдают более двух лет. Этот бэкдор в Kaspersky относят к семейству Manuscrypt, также известному как NukeSped. Ранее ThreatNeedle был замечен в атаках на криптовалютные биржи и разработчика игр для мобильных устройств, а совсем недавно он всплыл в ходе вредоносной кампании, нацеленной на кражу информации у баг-хантеров.

Атаки Lazarus на оборонные предприятия, согласно Kaspersky, начинаются с рассылки поддельных писем на адреса целевого предприятия, собранные из открытых источников. В прошлом году злоумышленники активно использовали тему COVID-19 и распространяли свои сообщения от имени медицинского центра, входящего в состав атакуемой организации.

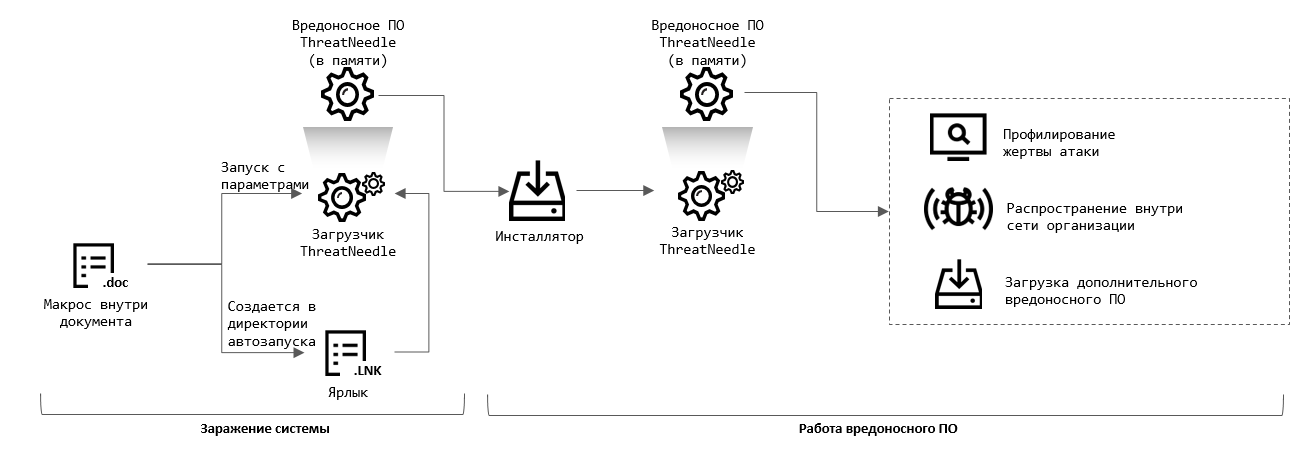

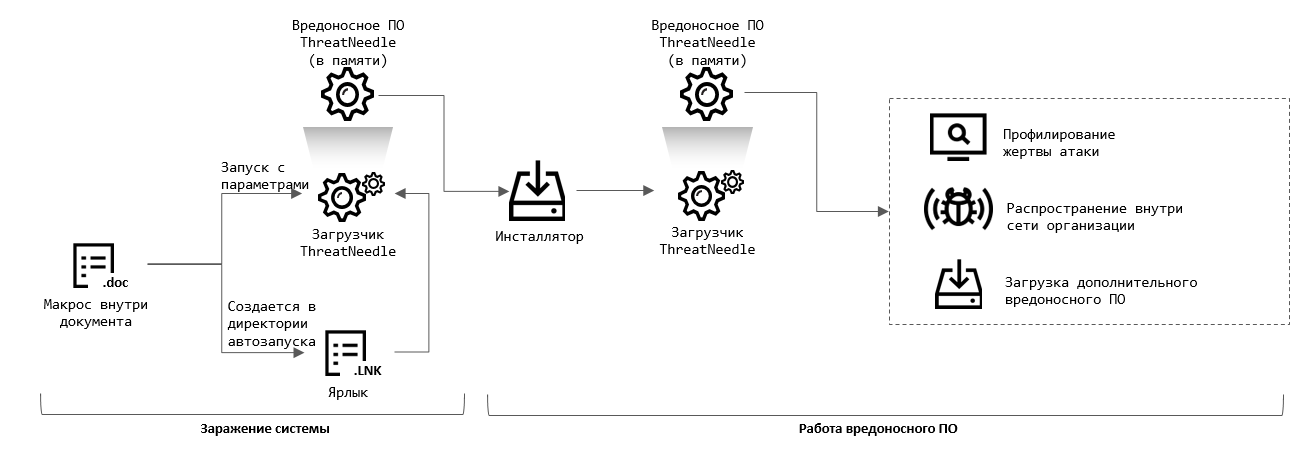

Фальшивые письма были снабжены вложением в виде документа Microsoft Word с вредоносным макросом либо содержали ссылку на такой файл, загруженный на удаленный сервер.

Анализ образца документа-приманки показал, что текст, используемый для отвода глаз, скопирован из статьи на сайте некоего медучреждения. Если получатель откроет файл и, следуя подсказке, запустит зловредный макрос, на его машину загрузится ThreatNeedle, что позволит авторам атаки захватить контроль над системой.

Далее злоумышленники с его помощью проводят разведку, определяя источники ценной информации в атакуемой сети, и, используя инсталлятор ThreatNeedle, распространяют инфекцию по сети. Продвигаясь вширь по сети, они также развертывают дополнительные программы для извлечения данных и вывода их на свои сервера.

По свидетельству аналитиков, основной модуль ThreatNeedle — бэкдор — обладает обширным набором функций. Он умеет собирать информацию о зараженной системе, выполнять операции с файлами, уходить в режим сна, обновлять свои настройки и совершать другие действия по команде с C2-сервера.

Расследование также показало, что, хозяйничая в сети, злоумышленники для сбора данных используют утилиту Responder, а для заражения других компьютеров — различные инструменты Windows. Примечательно, что Lazarus удалось добраться даже до изолированного сегмента, лишенного какой-либо связи с корпоративной сетью и возможности выхода в интернет. Преодолеть сегментацию сети атакующие смогли, получив доступ к виртуальной машине, выполнявшей функцию внутреннего маршрутизатора, и настроив на ней прокси-сервер.

Вывод краденых данных злоумышленники осуществляли поэтапно: сначала переносили все копии в скомпрометированные системы корпоративного сегмента сети, а затем создали SSH-туннели и по ним с помощью специальной утилиты отправили добычу на свой сервер, расположенный в Южной Корее.