За последние шесть месяцев новое семейство вредоносных программ для Android неоднократно привлекало внимание антивирусных экспертов. Отличается новый вредонос механизмом, позволяющим ему перестанавливать себя, что практически сводило на нет попытки удалить его.

Получивший имя xHelper зловред впервые был обнаружен в марте, однако ему быстро удалось заразить более 32 тысяч устройств. В этом месяце число жертв достигло 45 000.

По подсчетам специалистов компании Symantec, авторы xHelper заражают в среднем 131 устройство ежедневно и около 2400 ежемесячно.

По данным Malwarebytes, пользователи подхватывают эту вредоносную программу после серии редиректов, ведущих на страницу, где размещены Android-приложения. Там же можно найти инструкции по установке программ в обход официального магазина Google Play Store.

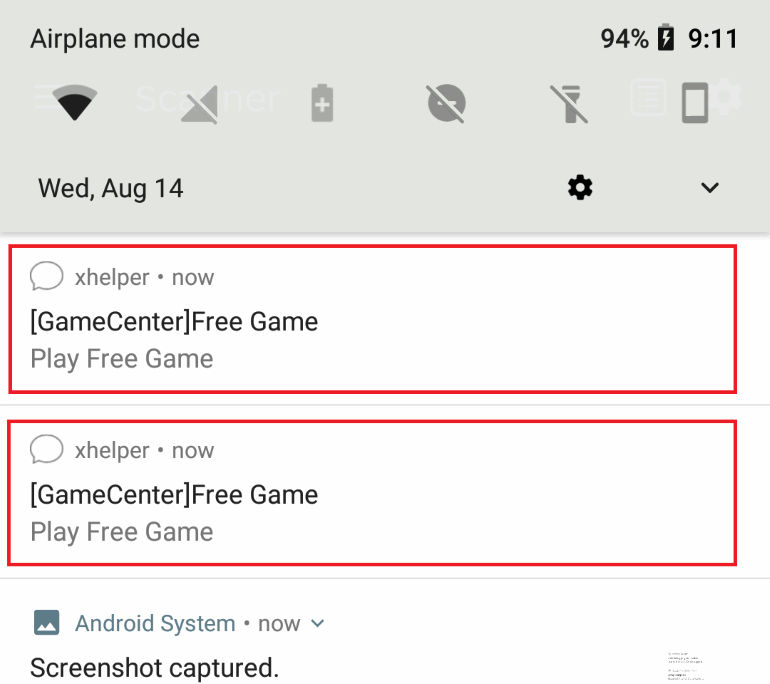

Все эти приложения содержат код, загружающий троян xHelper на мобильное устройство. К счастью, сам зловред не осуществляет деструктивных действий, его задача — отображать всплывающие рекламные окна и спамерские уведомления.

Вся эта реклама ведёт пользователей в Play Store, где их пытаются склонить к установке дополнительных программ. Именно так стоящие за xHelper злоумышленники зарабатывают деньги — каждая установка стороннего софта оплачивается.

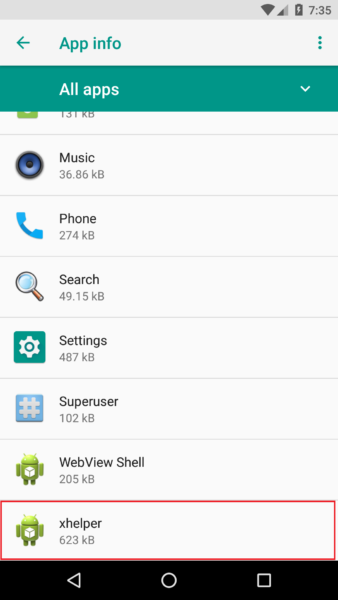

Однако основной отличительной чертой xHelper можно смело назвать механизм, благодаря которому вредоносная программа может устанавливать себя в качестве отдельного независимого сервиса.

Таким образом, пользователь не сможет удалить изначально установленное злонамеренное приложение стандартными средствами.

Более того, даже если пользователь обнаружит сервис xHelper в Android, деинсталлировать его также не получится — вредонос каждый раз перестанавливает себя.