Госдума окончательно одобрила законопроект, который вводит новые штрафы для владельцев сайтов и онлайн-сервисов. Под удар попадают площадки, которые продолжают использовать зарубежные способы аутентификации пользователей вместо предусмотренных российским законодательством механизмов. Документ принят сразу во втором и третьем чтениях.

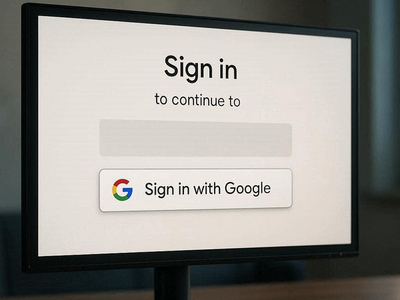

Согласно новым нормам, сайты и сервисы должны обеспечивать аутентификацию пользователей через российский номер телефона, портал «Госуслуги», Единую биометрическую систему или другие российские информационные системы, принадлежащие гражданам или компаниям РФ.

Если ресурс продолжит использовать для входа иностранные сервисы или зарубежную электронную почту в качестве механизма аутентификации, владельцу может грозить серьёзный штраф. Для юридических лиц он составит от 500 до 700 тысяч рублей. Для должностных лиц предусмотрены штрафы от 30 до 50 тысяч рублей, для граждан — от 10 до 20 тысяч рублей.

Закон также усиливает ответственность для владельцев интернет-платформ с рекомендательными алгоритмами. Штрафы предусмотрены за сбор информации о предпочтениях пользователей с нарушением законодательства, отсутствие уведомлений о работе рекомендательных систем, а также за непубликацию правил их использования и контактных данных для юридически значимых обращений.

Размер санкций здесь такой же — до 700 тысяч рублей для юридических лиц. При повторном нарушении штрафы могут вырасти до 1,4 млн рублей.

Отдельный блок поправок касается операторов связи. Для них вводится ответственность за нарушение правил взаимодействия с правоохранительными органами во время оперативно-разыскных мероприятий и мероприятий по обеспечению безопасности.

Если оператор нарушит установленный порядок или раскроет методы проведения таких мероприятий, компании может грозить штраф от 3 до 5 млн рублей.

За повторные нарушения наказание станет ещё жёстче. В этом случае может применяться оборотный штраф в размере до 3% годовой выручки. При этом минимальный порог санкций повышается с 1 млн до 10 млн рублей.