У российских пользователей Apple всё-таки появился обходной путь после отключения последнего рабочего способа оплаты подписок. Владельцы российских аккаунтов теперь могут сменить регион Apple ID даже при наличии активных подписок и, что особенно интересно, без привязки нового платёжного метода.

В этом убедился корреспондент «Кода Дурова». Поводом для проверки стала как раз недавняя блокировка оплаты подписок через привычные каналы.

Чтобы понять, что делать дальше, корреспондент издания обратился в англоязычную поддержку Apple с вопросом о смене региона и сохранении данных.

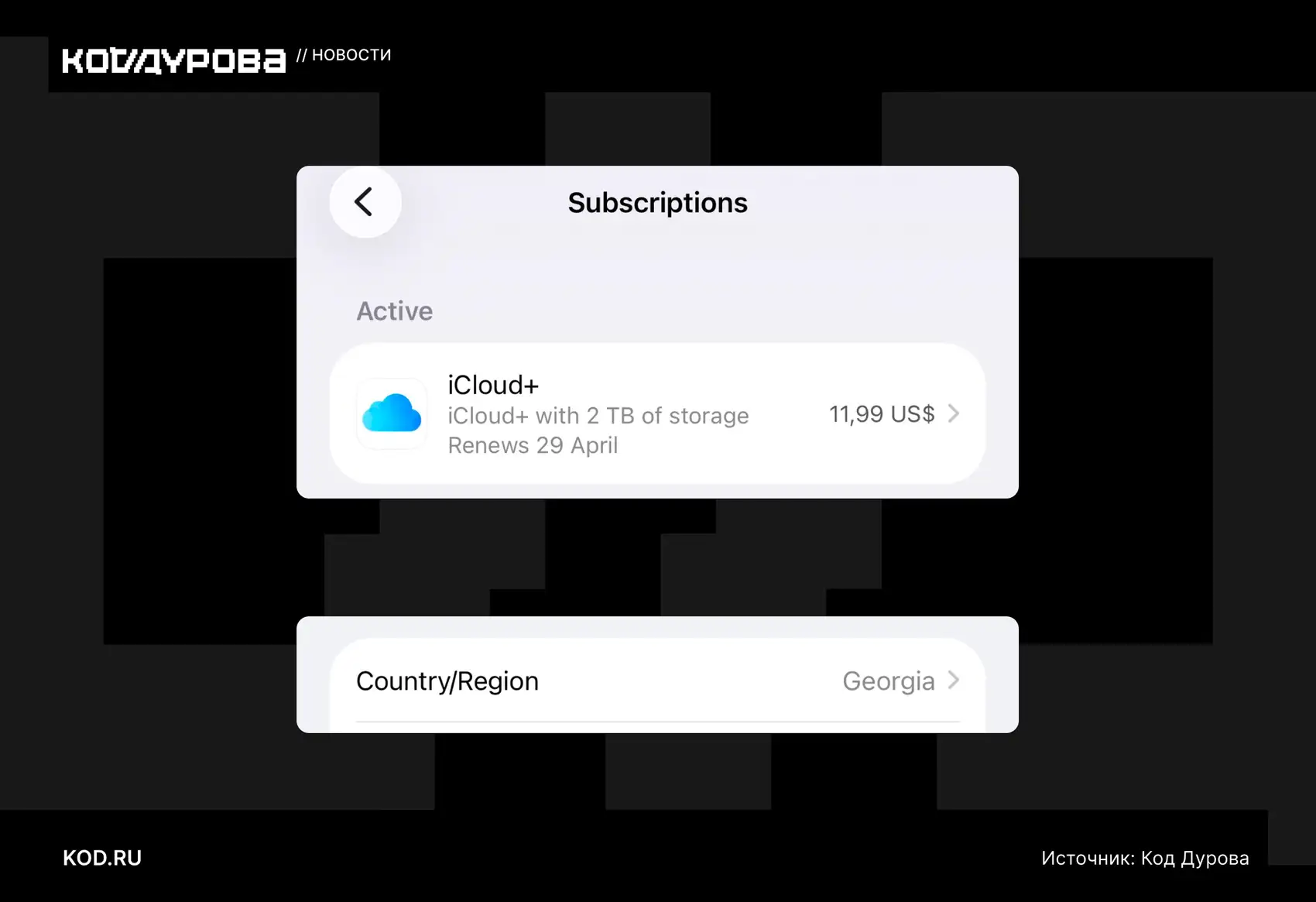

И тут выяснился любопытный момент. Раньше Apple прямо требовала для смены региона сначала отменить все подписки, а затем ещё и дождаться окончания их действия. Но в этот раз поддержка, по данным издания, посоветовала просто проигнорировать эти ограничения. В результате регион удалось без проблем сменить с России на Грузию.

При этом действующая подписка на iCloud+ сохранилась. Изменился только регион аккаунта и валюта оплаты: вместо рублей стала использоваться иностранная валюта.

Годовая подписка на Google One, как отмечает издание, исчезла из списка подписок в аккаунте Apple, но фактически продолжит работать до конца уже оплаченного периода. После этого её можно будет оформить заново уже в другой валюте.

На втором российском аккаунте, где активных подписок не было, эксперимент тоже оказался успешным. Регион снова удалось сменить на Грузию и тоже без указания нового платёжного метода. А это особенно необычно, потому что обычно Apple при такой операции просит карту или другой способ оплаты, привязанный к новому региону.

Правда, полностью беспроблемной эту схему назвать всё же нельзя. Главный стоп-фактор — деньги на балансе Apple ID. Если на счёте что-то осталось, сменить регион не получится. Сначала придётся потратить все средства, а если зависнет мелкий остаток, на который уже ничего нельзя купить, — обращаться в поддержку и просить обнулить баланс.

Есть и ещё один нюанс. По словам читателей, с активной подпиской на Apple Music смена региона всё ещё не проходит. Редакция «Кода Дурова» предполагает, что дело может быть в региональных лицензиях на музыку, и в таком случае придётся всё же дождаться окончания подписки.

Есть мнение, что Apple могла сознательно смягчить ограничения для российских пользователей, чтобы те не теряли доступ к своим данным и продолжали оплачивать сервисы после смены региона.