Искусственный интеллект всё активнее проникает в сферу ИБ, но вопросов пока больше, чем ответов. В каких задачах он действительно эффективен, а где без него можно обойтись? Эксперты рынка обсудили, как применять ML и AI на практике, измерять результат внедрения и не совершать типичных ошибок.

- 1. Введение

- 2. Как повысить эффективность кибербезопасности с помощью ИИ?

- 3. Где быстрее всего получить профит при использовании ИИ?

- 4. Блиц: куда нельзя допускать ИИ в информационной безопасности?

- 5. Меры безопасности при использовании ИИ в ИБ

- 6. Блиц: топ ошибок при внедрении ИИ

- 7. В каких продуктах ИБ наиболее успешным будет внедрение ИИ?

- 8. Выводы

Введение

Может ли искусственный интеллект стать надёжным щитом от киберугроз или это лишь модный тренд, раздутый маркетингом? Практика показывает: ИИ действительно работает, но только там, где его применяют осознанно и с пониманием ограничений. Как не ошибиться с выбором задач и получить реальную пользу от внедрения?

Особенность практического применения ИИ-технологий в кибербезопасности заключается в том, что здесь не работают универсальные решения. То, что отлично показывает себя в детектировании сетевых аномалий, может оказаться бесполезным в задачах приоритизации уязвимостей. Модель, успешно справляющаяся с анализом доменов в масштабах сотен миллионов проверок ежедневно, потребует совершенно иного подхода при интеграции в процессы расследования инцидентов.

Эксперты сходятся во мнении: ключевой фактор успеха — не столько сама технология, сколько правильное понимание контекста, в котором она применяется, и трезвая оценка её ограничений.

Рисунок 1. Эксперты в студии AM Live

Участники эфира:

- Алексей Парфентьев, заместитель генерального директора по инновационной деятельности, «СёрчИнформ».

- Вадим Куликов, руководитель отдела машинного обучения, SkyDNS.

- Константин Грищенко, руководитель направления развития технологий SOC, Positive Technologies.

- Дмитрий Руссак, руководитель группы развития платформы SOC, Yandex Cloud.

- Денис Гамаюнов, CEO, SolidSoft.

- Станислав Грибанов, руководитель продуктового направления, Гарда.

Ведущий и модератор эфира — Виктор Бобыльков, директор по кибербезопасности, MWS Cloud.

Как повысить эффективность кибербезопасности с помощью ИИ?

Дмитрий Руссак считает, что при внедрении ИИ необходимо в первую очередь исходить из существующих в компании процессов. Не следует использовать искусственный интеллект повсеместно: если стоит задача классификации, эффективнее могут оказаться простые алгоритмы или правила корреляции в SIEM-системах.

При этом эксперт уверен, что ИИ действительно приносит пользу и обеспечивает большую прозрачность в различных процессах — как в работе SOC, так и в задачах инфраструктурной безопасности, и в продуктах защиты.

Константин Грищенко отмечает, что наибольший положительный эффект от внедрения машинного обучения и ИИ достигается на этапе развития детектов. Это касается как самой детектирующей логики, так и технологий, позволяющих находить новые способы обнаружения вредоносной активности. Кроме того, ИИ эффективен на этапе триажа и расследования, где он выступает в роли помощника аналитика. В этом контексте перспективны технологии типа Copilot, которые могут предоставлять специалисту полезные рекомендации.

Виктор Бобыльков поделился практическим опытом: в ходе сравнения результатов реальной работы аналитика SOC и обученной модели выяснилось, что модель допустила в 2 раза больше ложных срабатываний и не выявила все реальные инциденты. Это свидетельствует о том, что уровень зрелости технологий пока не позволяет полностью передавать ИИ процесс принятия решений, поскольку он всё ещё допускает ошибки.

Виктор Бобыльков, директор по кибербезопасности, MWS Cloud

Вадим Куликов уверен, что граница доверия к ИИ зависит от стадии его применения и конкретных условий. Если речь идёт о расследованиях, здесь ИИ целесообразно использовать для первичного анализа, обогащения данных и выдвижения гипотез, которые впоследствии перепроверяют аналитики.

Ответственность за ложноположительные события при таком подходе остаётся на системе. Однако в задачах детектирования угроз, например при анализе доменов (сотни миллионов проверок ежедневно), человек физически не способен справиться с объёмом работы.

В таких условиях, по мнению эксперта, люди вынуждены полностью доверять ИИ, и ключевая задача — грамотно выстроить баланс между ложными срабатываниями, пропущенными угрозами и влиянием этих факторов на пользовательский опыт конечного пользователя.

Как измерить эффективность от внедрения ИИ в кибербезопасность?

Алексей Парфентьев рассказал о поиске критериев оценки эффективности ML-решений. По словам эксперта, существует множество технологий и методик оценки, и в ходе экспериментов с разными ключевыми показателями эффективности его команда пришла к единому, хотя и субъективному мнению. Единственной объективной метрикой эффективности технологии они считают ситуацию, когда задачу невозможно решить без применения ИИ или машинного обучения.

Всё остальное — это вопрос правильного подбора ключевых показателей эффективности. Если задачу невозможно решить без ИИ, это однозначный показатель, что его нужно внедрять. В качестве конкретных примеров задач, требующих обязательного применения ИИ, эксперт привёл анализ изображений и осмысление контекста.

Алексей Парфентьев, заместитель генерального директора по инновационной деятельности, «СёрчИнформ»

Станислав Грибанов выделил несколько направлений оценки эффективности. Базовым подходом он называет покрытие матрицы MITRE, поскольку сигнатурами можно закрыть не все техники — необходима альтернатива, позволяющая обнаруживать атаки иным способом.

Ключевыми характеристиками при этом выступают точность и широта покрытия. Оптимальный вариант — когда одна модель позволяет покрыть максимальное количество техник и тактик. При этом важно разграничивать метрики в зависимости от задачи:

- при детектировании угроз основными метриками остаются широта покрытия и точность;

- на этапе расследования, где ML помогает автоматизировать рутинные операции и повысить производительность аналитика, главной метрикой становится время реагирования (Time to Respond).

В первом опросе зрители поделились, как в их компании ML/AI уже применяется в кибербезопасности (мультивыбор):

- Автоматизация личной рутины (copilot) — 64 %.

- Поиск уязвимостей и анализ защищённости — 43 %.

- В других сценариях — 36 %.

- Классификация и описание инцидентов — 32 %.

- Корреляция событий и первичный триаж в SOC — 28 %.

- Автоматизированное реагирование по типовым сценариям — 23 %.

- Поведенческий анализ для антифрода или DLP — 14 %.

Рисунок 2. Как в вашей компании ML/AI уже применяется в кибербезопасности?

Где быстрее всего получить профит при использовании ИИ?

Денис Гамаюнов считает, что для определения точек быстрого внедрения ИИ в первую очередь необходимо проанализировать, на какие задачи у сотрудников уходит больше всего рабочего времени. В этой области с высокой вероятностью уже существует готовый продукт, использующий искусственный интеллект, который можно применить для автоматизации именно этих трудоёмких процессов.

Денис Гамаюнов, CEO, SolidSoft

Константин Грищенко уверен, что отправной точкой должно стать чёткое понимание проблемы: какая она именно и каким способом её следует решать. Эксперт подчёркивает, что отсутствие ИИ само по себе не является проблемой. Настоящие проблемы — это нехватка скорости обработки событий или недостаточная точность детектирования. Исходя из этого, внедрять нужно именно те технологии, которые помогут решить эти конкретные задачи, а не ИИ ради ИИ.

Станислав Грибанов отметил, что быстрее всего ИИ приносит пользу в автоматизации рутинных операций. Если говорить о задачах бизнеса в сфере ИБ, то самый очевидный эффект — это не сокращение персонала, а повышение его продуктивности.

Практический подход выглядит следующим образом: типовые шаги аналитиков разбиваются на последовательности, на их основе обучается модель, и то, на что ранее тратилось много человеческих ресурсов, теперь выдаётся готовым результатом. Аналитик в такой схеме принимает итоговое решение, будучи разгруженным от рутины.

Станислав Грибанов, руководитель продуктового направления, «Гарда»

Где брать датасеты для обучения моделей в ИБ?

Вадим Куликов считает, что при поиске данных для обучения необходимо в первую очередь исходить из конкретной задачи. Если речь идёт о работе с большими языковыми моделями и расширении их контекста, например через RAG-архитектуры, то здесь источником служат собственные данные компании: отчёты, которые ранее формировали аналитики, внутренние документы об атаках и инцидентах, описания того, как они развивались.

В случае задач классификации угроз или анализа доменов эксперт рекомендует использовать гибридный подход. Первичный анализ и грубую категоризацию можно отдать LLM, а затем уже обогащённые данные передавать для проработки аналитикам ИБ.

Ещё один возможный вариант — краудсорсинговые платформы. Однако эксперт обращает внимание на серьёзное ограничение: люди, выполняющие задания на таких платформах, могут справиться с классификацией текста, но им нельзя доверять задачи по анализу угроз. Это работа для квалифицированных специалистов и должна оставаться в пределах контура компании.

Вадим Куликов, руководитель отдела машинного обучения, SkyDNS

Блиц: куда нельзя допускать ИИ в информационной безопасности?

Станислав Грибанов: «Ещё в течение ближайших пары лет мы не готовы доверить ИИ активное реагирование на инциденты (респонс)».

Денис Гамаюнов: «Нельзя подпускать искусственный интеллект к чужим приватным данным, особенно к персональным данным клиентов».

Дмитрий Руссак: «ИИ пока не готов к активным действиям в рамках реагирования, а именно к сдерживанию угроз и процессам устранения уязвимостей».

Константин Грищенко: «Под запретом задачи, где возможны ситуации, в которых придётся искать крайнего и возлагать на него ответственность. Респонс с активными действиями — как раз такая история».

Вадим Куликов: «Нельзя внедрять ИИ туда, где ему приходится работать с закрытыми системами, когда он видит только внешние данные и не понимает внутреннего устройства. Например, анализируя трафик клиента, мы можем строить гипотезы, но часто они оказываются ошибочными, потому что неизвестно, что именно сгенерировало этот трафик».

Алексей Парфентьев: «ИИ нельзя допускать к разработке средств защиты информации».

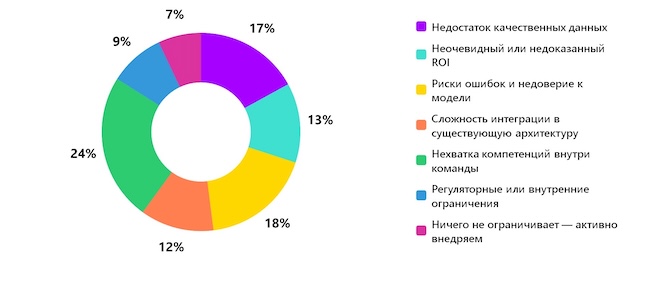

Во втором опросе выяснилось, что в первую очередь ограничивает зрителей от более широкого применения ML/AI в кибербезопасности:

- Нехватка компетенций внутри команды — 24 %.

- Риски ошибок и недоверие к модели — 18 %.

- Недостаток качественных данных — 17 %.

- Неочевидный или недоказанный ROI — 13 %.

- Сложность интеграции в существующую архитектуру — 12 %.

- Регуляторные или внутренние ограничения — 9 %.

- Ничего не ограничивает, активно внедряем — 7 %.

Рисунок 3. Что ограничивает вас от более широкого применения ML/AI в кибербезопасности?

Меры безопасности при использовании ИИ в ИБ

Алексей Парфентьев уверен, что обязательными станут продукты класса AI-файрвол, которые будут объединяться с системами DLP. По его мнению, это одна задача, которую необходимо решать примерно одинаковыми инструментами.

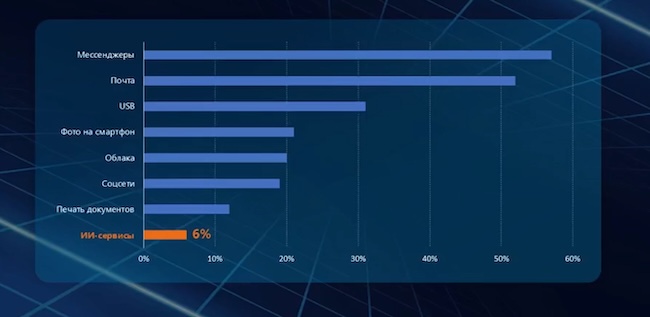

Эксперт отмечает, что пока сервисы искусственного интеллекта не критично влияют на общую картину с утечками данных — основной объём по-прежнему приходится на переписку в мессенджерах. Утечки через ИИ носят иной характер и чаще всего происходят неосознанно. Даже в очень крупных компаниях были инциденты, когда интеллектуальная собственность и исходные коды оказывались в открытом доступе из-за того, что сотрудники загружали их в облачные ИИ-сервисы.

Рисунок 4. Каналы утечек за 2025 год от «СёрчИнформ»

При этом, даже если корпоративная политика безопасности запрещает выкладывать данные в облака, тем более за границу, статистика показывает, что люди продолжают ошибаться. Алексей Парфентьев выделяет 2 основных риска:

- Ваши собственные сервисы на базе ИИ могут отдавать вовне больше регламентированных данных, чем требуется.

- Сотрудники по собственной инициативе пользуются внешними ИИ-сервисами, которые вы забыли заблокировать, оттуда тоже может прийти проблема.

Станислав Грибанов поделился подходом к тестированию моделей. По его словам, необходимо иметь собственные датасеты. Говоря о машинном обучении с учётом дрейфа данных, эксперт отмечает, что его команда нашла для себя решение там, где возможно использовать жёстко заданный порог, контролирующий модель.

Если по каким-то причинам модель не увидит аномалию, должен всегда срабатывать этот порог. Статистически он может где-то давать ложные срабатывания, но главное — в ситуации, когда модель не сработает, порог подстрахует. Конечно, важны также пайплайны и автоматизация процессов.

Блиц: топ ошибок при внедрении ИИ

Алексей Парфентьев: «Самая распространённая ошибка — верить, что ИИ заработает идеально сразу "из коробки"».

Вадим Куликов: «Полностью отдавать решение на откуп искусственному интеллекту, забывая о контроле со стороны человека».

Константин Грищенко: «Внедрять ИИ ради самого внедрения, а не для решения конкретной проблемы».

Дмитрий Руссак: «Недооценивать "проблему последней мили": можно быстро получить результат на 70 %, но затем потратить 3 месяца на доведение до приемлемого уровня».

Денис Гамаюнов: «Нести непротестированный ИИ в продакшн или проверять его на неподходящих датасетах».

Станислав Грибанов: «Начинать внедрение ИИ без детального анализа проблемы, особенно если она уже решается другими работающими способами».

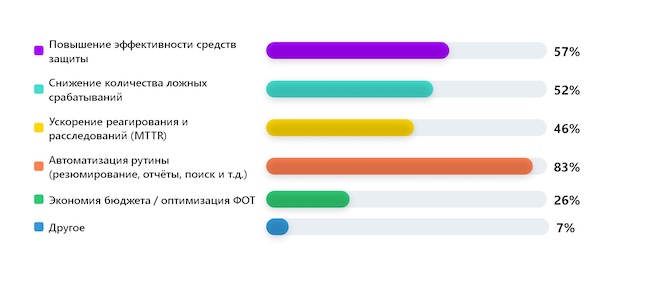

В третьем опросе зрители рассказали, какой реальный эффект от ML/AI в кибербезопасности они ожидают (мультивыбор):

- Автоматизация рутины (резюмирование, отчёты, поиск и т. д.) — 83 %.

- Повышение эффективности средств защиты — 57 %.

- Снижение количества ложных срабатываний — 52 %.

- Ускорение реагирования и расследований (MTTR) — 46 %.

- Экономия бюджета / оптимизация ФОТ — 26 %.

- Другое — 7 %.

Рисунок 5. Какой реальный эффект от ML/AI в кибербезопасности вы ожидаете?

В каких продуктах ИБ наиболее успешным будет внедрение ИИ?

Дмитрий Руссак отмечает перспективность применения ИИ в управлении уязвимостями, а именно в задачах деприоритизации и приоритизации. По его мнению, для продуктов класса Vulnerability Management (не только в процессах безопасной разработки) ИИ теперь позволит правильно расставлять приоритеты при обработке уязвимостей, исходя из контекста.

Дмитрий Руссак, руководитель группы развития платформы SOC, Yandex Cloud

Денис Гамаюнов считает, что наиболее перспективное направление — это обнаружение уязвимостей и автоматизированное тестирование на проникновение (автопентесты). Особенно эффективно ИИ может применяться не только там, где код доступен в каком-либо виде, но и в сценариях чёрного ящика (blackbox) также есть много возможностей.

Эксперт поясняет: в системах динамического тестирования безопасности приложений (DAST) сейчас работают обычные эвристические методы, у которых контекст ограничен, как правило, одним ответом. Машинное обучение же позволяет охватить контекстом гораздо больше информации о поведении приложений.

В DAST самая первая задача, влияющая на качество сканирования в целом, — это этап дискавери, то есть понимание поверхности атаки приложения. В ходе сканирования также важно анализировать не только индикаторы компрометации, но и сами ответы системы — там могут встречаться ошибки, на которые сигнатуры ещё не написаны.

Константин Грищенко уверен, что с точки зрения пользователей продуктов большие языковые модели будут наиболее востребованы там, где они помогают упростить порог входа. Сотрудники не всегда являются достаточно компетентными, и им нужно понятное экспертное мнение. Речь идёт о помощниках типа Copilot, которые упрощают объяснения и помогают в принятии решений. С точки зрения вендора, LLM также ускоряет проверку гипотез до того, как решение будет выведено в прод.

Константин Грищенко, руководитель направления развития технологий SOC, Positive Technologies

Станислав Грибанов поделился практическим опытом: если решение позиционируется как Detection and Response, оно должно основываться на несигнатурных методах. В своей работе его команда больше всего применяет ИИ в продуктах класса NDR (Network Detection and Response) — для выявления сетевых аномалий.

Говоря об облачных технологиях, эксперт указывает на мировой тренд — AI-ассистенты и агенты. В облачной среде экономически неэффективно игнорировать огромные объёмы данных, которые получают, чтобы обучать модели и создавать агентов, серьёзно повышающих эффективность работы.

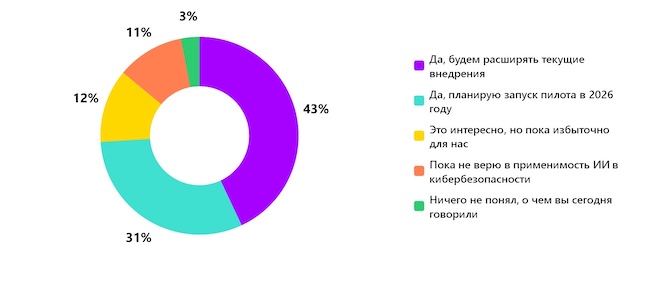

Финальный опрос показал, планируют ли зрители внедрять ML/AI в кибербезопасности после эфира:

- Будут расширять текущие внедрения — 43 %.

- Планируют запуск пилота в 2026 году — 31 %.

- Считают интересным, но пока избыточным для себя — 12 %.

- Пока не верят в применимость ИИ в кибербезопасности — 11 %.

- Ничего не поняли, о чём сегодня говорили эксперты — 3 %.

Рисунок 6. Планируете ли вы внедрять ML/AI в кибербезопасности после эфира?

Выводы

Искусственный интеллект в кибербезопасности — это уже не экспериментальная технология, а рабочий инструмент, который находит применение в самых разных задачах. От автоматизации рутинных операций и помощи аналитикам в расследованиях до обнаружения сложных сетевых аномалий и приоритизации уязвимостей — везде ИИ демонстрирует свою состоятельность, но с одной важной оговоркой: он требует вдумчивого и осознанного подхода к внедрению.

Главный вывод, который объединяет мнения всех участников эфира: ИИ не должен становиться самоцелью. Его внедрение оправдано лишь там, где он решает конкретную проблему, с которой не справляются традиционные методы, или там, где без него задача в принципе не решается в силу масштабов.

При этом даже в самых успешных сценариях использования искусственный интеллект пока остаётся помощником, а не заменой человеку. Эксперты единодушны: доверять ИИ активное реагирование на инциденты или принятие критических решений без участия аналитика сегодня преждевременно.

Отдельного внимания заслуживают вопросы безопасности при использовании самих ИИ-технологий. Как показало обсуждение, утечки данных через облачные сервисы и неконтролируемое использование ИИ сотрудниками становятся новым вызовом для корпоративной безопасности. Это значит, что развитие средств защиты должно идти параллельно с внедрением самих ИИ-решений, а такие продукты, как AI-фаерволы, вероятно, станут обязательным элементом инфраструктуры в ближайшие годы.

Телепроект AM Live еженедельно приглашает экспертов отрасли в студию, чтобы обсудить актуальные темы российского рынка ИБ и ИТ. Будьте в курсе трендов и важных событий. Для этого подпишитесь на наш YouTube-канал. До новых встреч!