Объём данных растёт, угрозы множатся, а времени на реагирование становится всё меньше. Именно в этих условиях на первый план выходят системы на базе ИИ, способные анализировать, прогнозировать и действовать автономно. Эксперты обсудили нюансы применения ML и AI в средствах безопасности.

- 1. Введение

- 2. Как ИИ повлиял на экономику киберпреступности?

- 3. Риски внедрения ИИ в собственные продукты и процессы

- 4. Как можно применять ИИ в своих процессах уже сейчас?

- 5. Какие условия должны быть созданы для применения ИИ?

- 6. Блиц: юридические ограничения при использовании ИИ

- 7. Прогнозы: какие сценарии использования ИИ в ИБ к концу 2026 года станут стандартом?

- 8. Выводы

Введение

Современный этап развития информационных технологий характеризуется не только расширением цифрового ландшафта, но и качественным усложнением угроз информационной безопасности. Традиционные модели защиты, основанные на сигнатурном анализе и статических правилах, демонстрируют снижение эффективности перед лицом проактивных и постоянно эволюционирующих кибератак. В этой связи актуальным направлением является интеграция методов искусственного интеллекта (ИИ) и машинного обучения (ML) в существующие и перспективные системы кибербезопасности.

Применение данных технологий позволяет перейти от реактивной модели обнаружения известных угроз к проактивному прогнозированию и нейтрализации аномальной активности, включая атаки нулевого дня. Способность алгоритмов ML обрабатывать сверхбольшие объёмы данных в режиме реального времени открывает новые возможности для анализа сетевого трафика, поведенческой аналитики пользователей и автоматизации процессов реагирования на инциденты.

Эксперты отрасли рассмотрели ключевые аспекты применения машинного обучения и искусственного интеллекта в сфере кибербезопасности, проанализировали основные методы и подходы, а также оценили перспективы развития данных технологий в контексте информационной безопасности (ИБ).

Рисунок 1. Эксперты в студии AM Live

Участники эфира:

- Владислав Тушканов, руководитель группы исследования технологий машинного обучения, «Лаборатория Касперского».

- Михаил Карпенко, инженер отдела развития, Security Vision.

- Николай Куликов, руководитель группы сетевой безопасности департамента клиентского сервиса, ГК «Солар».

- Антон Афонин, руководитель отдела анализа сетевого трафика и машинного обучения, F6.

- Светлана Старовойт, руководитель продуктового направления, «ИнфоТеКС».

- Александр Лысенко, ведущий эксперт по безопасности разработки и ИИ, «К2 Кибербезопасность».

- Александр Балабанов, руководитель центра искусственного интеллекта и перспективных технологий, BI.ZONE.

Ведущий и модератор эфира — Вадим Шелест, руководитель направления анализа защищённости, Wildberries & Russ.

Как ИИ повлиял на экономику киберпреступности?

Антон Афонин пояснил: если раньше фишинговые атаки представляли собой тысячи одинаковых писем, которые легко детектировались, то сегодня преступники могут на основе одного эталонного письма за секунды получить множество вариантов с разными заголовками и текстами. Объединить их как общую рассылку сложно, но использовать ИИ для смысловой кластеризации таких писем — вполне реально.

Он также отметил рост числа писем из Ирана и Северной Кореи с абсолютно нативным переводом на идеальный русский язык. В связи с этим ИИ однозначно повышает риски и снижает себестоимость атак.

Антон Афонин, руководитель отдела анализа сетевого трафика и машинного обучения, F6

Николай Куликов добавил, что фишинг — лишь один из сценариев. Любые средства коммуникации, включая электронную почту, могут быть использованы ИИ против пользователей.

Александр Лысенко обратил внимание на экономический дисбаланс: атакующему использовать ИИ значительно дешевле, чем защищающемуся: различаются и цена риска, и ресурсы на обеспечение защиты. При этом он уточнил, что принцип нулевого доверия и готовность к ботнетам и распределённым атакам позволяют сохранять баланс, хотя перекос в сторону атакующих существует.

Вадим Шелест сформулировал ключевой тезис: снижение порога входа для менее квалифицированных киберпреступников стало главным последствием доступности ИИ.

Вадим Шелест, руководитель направления анализа защищённости, Wildberries & Russ

Александр Балабанов отметил, что за последний год значительно доступнее стали не только генерация текстов, но и аудиосинтез с видеогенерацией. В сочетании с массовыми утечками это создаёт почву для персонализированных атак, когда сотрудники получают звонки или видеовызовы якобы от генерального директора или CFO (Chief Financial Officer, финансовый директор) с просьбой перевести средства. Он подчеркнул, что такие атаки выглядят естественно, поэтому важнейшую роль играет обучение пользователей.

Риски внедрения ИИ в собственные продукты и процессы

Александр Лысенко пояснил, что перечни рисков, связанных с внедрением ИИ, сегодня формируют многие организации: от OWASP до крупных финтех-компаний. Однако при попытке применить эти списки к себе он рекомендует в первую очередь проанализировать, как именно компания использует искусственный интеллект.

Если используются облачные модели, существует риск непреднамеренной отправки чувствительных данных, что влечёт за собой трансграничную передачу и связанные с ней ограничения. Второй базовый риск, по его словам, актуален для компаний, предоставляющих модели пользователям, — генерация токсичного контента.

Эксперт также обратил внимание на риски, связанные с защитой самих моделей. Введение дополнительных ограничений через системные промпты создаёт угрозу промпт-инъекций — попыток обойти эти барьеры.

Александр Лысенко, ведущий эксперт по безопасности разработки и ИИ, «К2 Кибербезопасность»

Особое внимание Лысенко уделил развитию RAG-систем (Retrieval Augmented Generation, технология ИИ, объединяющая большие языковые модели (LLM) с внешними базами знаний): информация, добавляемая в контекст, зачастую не ранжируется по уровню доступа, и уже фиксировались случаи, когда рядовые сотрудники получали данные, предназначенные только для топ-менеджмента.

Пока менее распространённый, но крайне опасный сценарий — применение автономных агентов, которые фактически представляют собой удалённое выполнение кода (RCE) в инфраструктуре компании.

Главным же риском Александр Лысенко назвал скорость развёртывания: в стремлении как можно быстрее интегрировать технологию компании не отдают отчёта в том, какие права и доступы они предоставляют ИИ-системам.

В качестве решения он предложил рациональный подход: строить внутренний корпоративный доступ к искусственному интеллекту с участием инструментов информационной безопасности, закрывая риски через этот централизованный инструмент и одновременно блокируя возможность использования теневого ИИ в обход корпоративных политик.

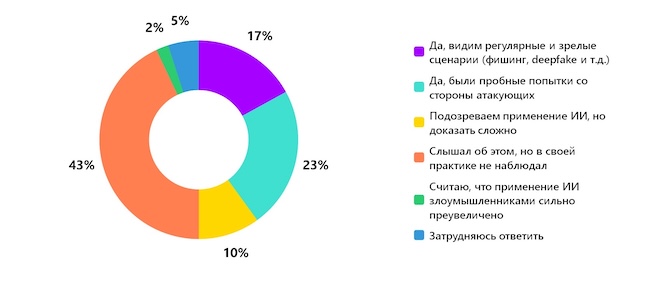

В первом опросе зрители поделились, сталкивались ли они с атаками, где ИИ/ML реально усиливал противника:

- Слышали об этом, но в своей практике не наблюдали — 43 %.

- Были пробные попытки со стороны атакующих — 23 %.

- Видят регулярные и зрелые сценарии (фишинг, deepfake и т. д.) — 17 %.

- Подозревают применение ИИ, но не могут доказать — 10 %.

- Затруднились ответить — 5 %.

- Считают, что применение ИИ злоумышленниками сильно преувеличено — 2 %.

Рисунок 2. Сталкивались ли вы с атаками, где ИИ/ML реально усиливал противника?

Как можно применять ИИ в своих процессах уже сейчас?

Михаил Карпенко рассказал о возможностях автоматизации уже на текущем этапе. По его словам, ИИ можно доверить сбор общих, некритичных и нечувствительных данных, а также принятие решений на их основе. Однако изменение конфигураций моделям доверять пока нельзя. Говоря об автоматизации принятия решений, остаётся открытым вопрос ответственности: кто отвечает за решение — вендор, специалисты по ИБ или эксплуатирующая сторона.

Михаил Карпенко, инженер отдела развития, Security Vision

Александр Балабанов выделил несколько направлений. Первое — автоматизация рутины, причём в каждом поддомене кибербезопасности она своя. Он отметил, что если задачу нельзя решить кодом, стоит пробовать закрывать её помощью генеративного ИИ. В SOC это триаж, объяснение событий, саммаризация и генерация черновиков. В пентесте — сбор и обобщение информации.

Второй большой класс задач — детектирование, включая корреляцию паттернов фишинга и телеметрии, а также поиск аномалий.

Третье направление — упрощение продуктов кибербезопасности. В условиях дефицита кадров и скилл-гэпа (разрыв между навыками, которыми обладают сотрудники, и навыками, которые требуются для выполнения рабочих задач) сложные продукты можно делать понятнее за счёт ИИ, например, упрощая взаимодействие с документацией.

Светлана Старовойт поделилась опытом применения машинного обучения в продуктах компании. Первая модель, выпущенная в 2018 году, занималась анализом событий ИБ и формированием вердикта о подозрении на инцидент.

Она пояснила, какие типы угроз можно обнаруживать с помощью таких моделей. Первое и наиболее очевидное — точечные задачи обнаружения и предотвращения, например выявление вредоносного кода или его связи с командным центром. Распространение ИИ у атакующих изменило ландшафт DDoS-атак: появились слабые, растянутые во времени атаки, которые стандартные средства выявляют с трудом. Для решения этой задачи компания разработала модель, успешно обнаруживающую как минимум 2 типа таких атак. Также применяется поведенческая модель, анализирующая статистику сетевого трафика и информацию о потоках.

Светлана Старовойт уточнила, что речь идёт именно о моделях машинного обучения, а не об ИИ в широком смысле: они узкофункциональны, легковесны и легко интегрируются в конечный продукт.

Светлана Старовойт, руководитель продуктового направления, «ИнфоТеКС»

Какие условия должны быть созданы для применения ИИ?

Александр Балабанов рассказал об условиях, необходимых для применения ИИ, подчеркнув разницу между классическим машинным обучением и генеративным ИИ. Если ML требует серьёзных затрат, времени и экспертизы, то с GenAI можно начинать работать уже сейчас.

Первое условие — наличие проработанного юзкейса. Процесс, который планируется автоматизировать, должен быть документирован и реально работать. Далее важно найти внутри компании энтузиастов, уже знакомых с ИИ, чтобы обсудить с ними возможности автоматизации конкретного процесса.

Эксперт предостерёг от восприятия ИИ как серебряной пули: многие задачи эффективно решаются классическим программированием, и только если автоматизировать привычными способами не получается, стоит пробовать ИИ. Есть и задачи, где программирование требует неоправданно много времени: например, саммаризация, — и здесь LLM действительно уместны.

Следующий шаг — оценка рисков. Необходимо определить, допустимо ли использование внешних моделей, с участием ИБ выбрать периметр, создать учётные записи и приступить к проверке гипотез. Важно заранее наметить конкретный ожидаемый результат и отдавать себе отчёт, что идеального качества не будет: LLM неизбежно ошибаются. Главное — быть открытым к инновациям, пробовать и тестировать.

Александр Балабанов, руководитель центра искусственного интеллекта и перспективных технологий, BI.ZONE

Светлана Старовойт дополнила тему вопросом оценки ошибок LLM. Она пояснила, что в компании обязательно проводится как минимум регрессионное тестирование для всех обучаемых моделей. Внедрены также методы самотестирования модели в сценарии, когда она дообучается на данных пользователя. Ключевой принцип: все способы тестирования должны быть понятны ещё до начала эксплуатации модели.

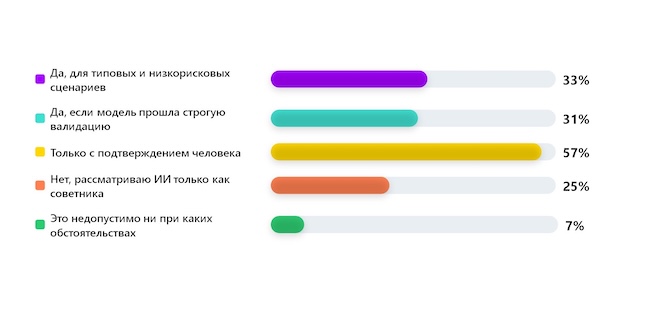

Во втором опросе зрители ответили, готовы ли они делегировать ИИ принятие решений в ИБ:

- Только с подтверждением человека — 57 %.

- Да, для типовых и низкорисковых сценариев — 33 %.

- Да, если модель прошла строгую валидацию — 31 %.

- Нет, рассматриваю ИИ только как советника — 25 %.

- Это недопустимо ни при каких обстоятельствах — 7 %.

Рисунок 3. Готовы ли вы делегировать ИИ принятие решений в ИБ?

Блиц: юридические ограничения при использовании ИИ

Александр Балабанов: «В первую очередь стоит обращать внимание на использование внешних провайдеров. Всегда важно определять задачи, где можно применять ИИ. Основной риск заключается в том, что конфиденциальная информация организации может утекать за периметр. Что касается опенсорсных инструментов, доступных в интернете, необходимо тщательно проверять политику их использования, поскольку схемы лицензирования могут различаться».

Александр Лысенко: «Главная проблема — утечка персональных данных при трансграничной передаче. Наиболее популярные сейчас сценарии связаны с облачными моделями: их качество значительно выше, представлено много зарубежных решений, но именно здесь возникают серьёзные риски трансграничной передачи персональных данных. Это касается и любой другой защищаемой информации в организации — необходим строгий контроль того, что и куда отправляется».

Николай Куликов: «Приведу пример из личной практики. Данные из открытых чатов ChatGPT находятся в публичном доступе, их можно найти через поиск. В ходе одного из таких поисков я обнаружил подробное описание сетевой инфраструктуры одной российской компании».

Николай Куликов, руководитель группы сетевой безопасности департамента клиентского сервиса, ГК «Солар»

Светлана Старовойт: «Юридическую ответственность несёт начальник службы безопасности. Включайте критическое мышление и никогда не доверяйте модели решение критических задач».

Антон Афонин: «Ключевой вопрос — разграничение прав доступа к данным. При создании RAG-хранилища можно развернуть векторную базу локально, но возникает серьёзная проблема с разграничением доступа к данным внутри этой базы. Даже в рамках одной компании существует разветвлённая система прав и привилегий, которую очень легко нарушить при использовании векторного поиска через ИИ-ассистентов».

Михаил Карпенко: «Существуют стандартные требования к ИТ-системам, которые полностью применимы и к моделям ИИ. Защита баз данных, контурная защита, защита трафика — всё это работает, на это можно опираться.

Использование облачных моделей не получит широкого распространения, упор будет делаться на локальные решения. Однако полностью отказаться от облаков не получится, так как всегда сохраняется риск, что сотрудник самостоятельно воспользуется внешним сервисом и сольёт информацию».

Владислав Тушканов: «Существует опасение, что чат-бот может сказать что-то лишнее. Когда компании создают открытые интерфейсы для общения с пользователями, возникают проблемы: пользователи любят задавать неудобные вопросы. Необходимы решения класса AI-файрвол, которые защищают модели от генерации нежелательного контента от имени компании. На западном рынке таких решений уже много, ожидаем появления достаточного количества и на российском».

Владислав Тушканов, руководитель группы исследования технологий машинного обучения, «Лаборатория Касперского»

В третьем опросе зрители выбрали задачи, которые они готовы автоматизировать с помощью ИИ:

- Автоматизация личной рутины (copilot) — 79 %.

- Классификация и описание инцидентов — 67 %.

- Поиск уязвимостей и анализ защищённости — 59 %.

- Корреляция событий и первичный триаж в SOC — 43 %.

- Поведенческий анализ для антифрода или DLP — 35 %.

- Автоматизированное реагирование по типовым сценариям — 31 %.

- Пока не готов доверять ИИ — 9 %.

Рисунок 4. Какие задачи в ИБ вы готовы автоматизировать с помощью ИИ?

Прогнозы: какие сценарии использования ИИ в ИБ к концу 2026 года станут стандартом?

Владислав Тушканов: «Стандартом останутся те же направления, где машинное обучение используется уже сейчас: антифрод, DLP, детектирование угроз. Активно будет развиваться первичный триаж и типовое реагирование на базе ИИ-агентов. Не факт, что к концу года это будет полностью реализовано, но ведущие вендоры будут пытаться это сделать».

Светлана Старовойт: «Интерес к применению генеративных моделей и агентов будет расти как со стороны разработчиков, так и со стороны потребителей».

Антон Афонин: «Инструмент первичного триажа, работающий под контролем сотрудников, — это тот базовый уровень, к которому сейчас стремятся все вендоры. Многие поставили себе эту цель на конец декабря. Крайне нишевой останется история с автономными агентами, которые самостоятельно работают в SIEM и SOC».

Александр Балабанов: «Возможен переходный период между нынешними решениями и полноценными мультиагентными системами, когда мы сможем комбинировать агенты и воркфлоу (последовательность действий в работе — прим. ред.). Если создавать узкоспециализированных агентов и при этом детерминированно ожидать с их стороны определённые результаты, многих рисков можно избежать».

Заменит ли ИИ аналитиков SOC?

Светлана Старовойт: «В этом открывается возможность для хороших экспертов, работающих в SOC. С появлением ИИ формируется новый класс профессий — тренер для ИИ. Им может стать эксперт, обладающий глубокими знаниями и умеющий обучать модели. Это точка роста для специалистов SOC».

Михаил Карпенко: «Аналитиков SOC ИИ не заменит. Уже давно существует SOAR, и некоторые предсказывали, что первая линия исчезнет, уступив место автоматизации, но этого не произошло.

Скорее, аналитики получат новый инструмент, который позволит тратить меньше времени на анализ. При этом на них ляжет больший объём информации, и они должны будут автоматизировать обработку, чтобы выдавать конечное решение быстрее».

Александр Лысенко: «Использование ИИ на первой линии приведёт к резкому росту порога входа в профессию. Потребуются специалисты, которые лучше разбираются в информационной безопасности и в контексте решаемых задач. В результате первая линия приблизится ко второй, и благодаря этому снизится нагрузка на вторую линию SOC».

Александр Балабанов: «У первой линии зачастую много задач, которые могут пересекаться с реальным миром. SOC должен быть готов к внедрению ИИ и доступен для него. Наличие различных описаний, документации, доступа через API — всё это важная отправная точка для перехода к полноценному автономному SOC. Это сложная задача, реализация которой растянется на несколько лет».

В финальном опросе зрители предположили, где к концу 2026 года ИИ даст наибольший измеримый эффект в ИБ:

- Автоматизация рутины специалистов — 77 %.

- Ускорение реагирования — 53 %.

- Повышение качества поведенческого анализа — 39 %.

- Экономия бюджета — 39 %.

- Оптимизация штата — 29 %.

- Нигде не даст — 3 %.

Рисунок 5. Где ИИ к концу 2026 даст наибольший измеримый эффект в ИБ?

Выводы

Искусственный интеллект сегодня оказывает двойственное влияние на кибербезопасность. С одной стороны, он существенно снизил порог входа для киберпреступников, сделав фишинговые атаки персонализированными, а дипфейки — доступными и реалистичными. Экономика атак изменилась: злоумышленники тратят меньше, а эффективность их действий растёт. С другой стороны, ИИ становится ключевым инструментом защиты, позволяя автоматизировать рутину, улучшить детектирование аномалий и ускорить реагирование на инциденты.

Внедрение ИИ в собственные процессы требует взвешенного подхода. Основные риски связаны с утечкой данных через внешние модели, нарушением прав доступа в RAG-системах и спешкой при развёртывании, когда компании не успевают выстроить адекватный контроль. Юридическая ответственность и защита от промпт-инъекций остаются открытыми вопросами, требующими участия служб безопасности на этапе проектирования.

Говоря о будущем, эксперты сходятся во мнении, что ИИ не заменит аналитиков SOC, но трансформирует их работу, повышая требования к компетенциям первой линии и создавая новые профессии, такие как тренер ИИ. К концу 2026 года стандартом станут инструменты первичного триажа и типового реагирования под контролем человека, тогда как полностью автономные агенты останутся нишевыми решениями. Ключ к успеху — в критическом мышлении, поэтапном тестировании и готовности инфраструктуры к интеграции ИИ.

Телепроект AM Live еженедельно приглашает экспертов отрасли в студию, чтобы обсудить актуальные темы российского рынка ИБ и ИТ. Будьте в курсе трендов и важных событий. Для этого подпишитесь на наш YouTube-канал. До новых встреч!