По данным Qrator Labs, в I квартале 2024 года вклад смешанных атак (с комбинацией разных техник) в общий объем DDoS-инцидентов увеличился в два раза, до 23,22%. Почти в четверти случаев источником вредоносного трафика являлась Россия.

Рост числа смешанных мультивекторных DDoS эксперты связали с увеличением мощностей, доступных дидосерам. Расширенные возможности позволяют проводить ковровые атаки на блоки IP-адресов (инфраструктуры, сети), и защититься от таких бомбардировок, даже с помощью сторонних услуг, сложнее.

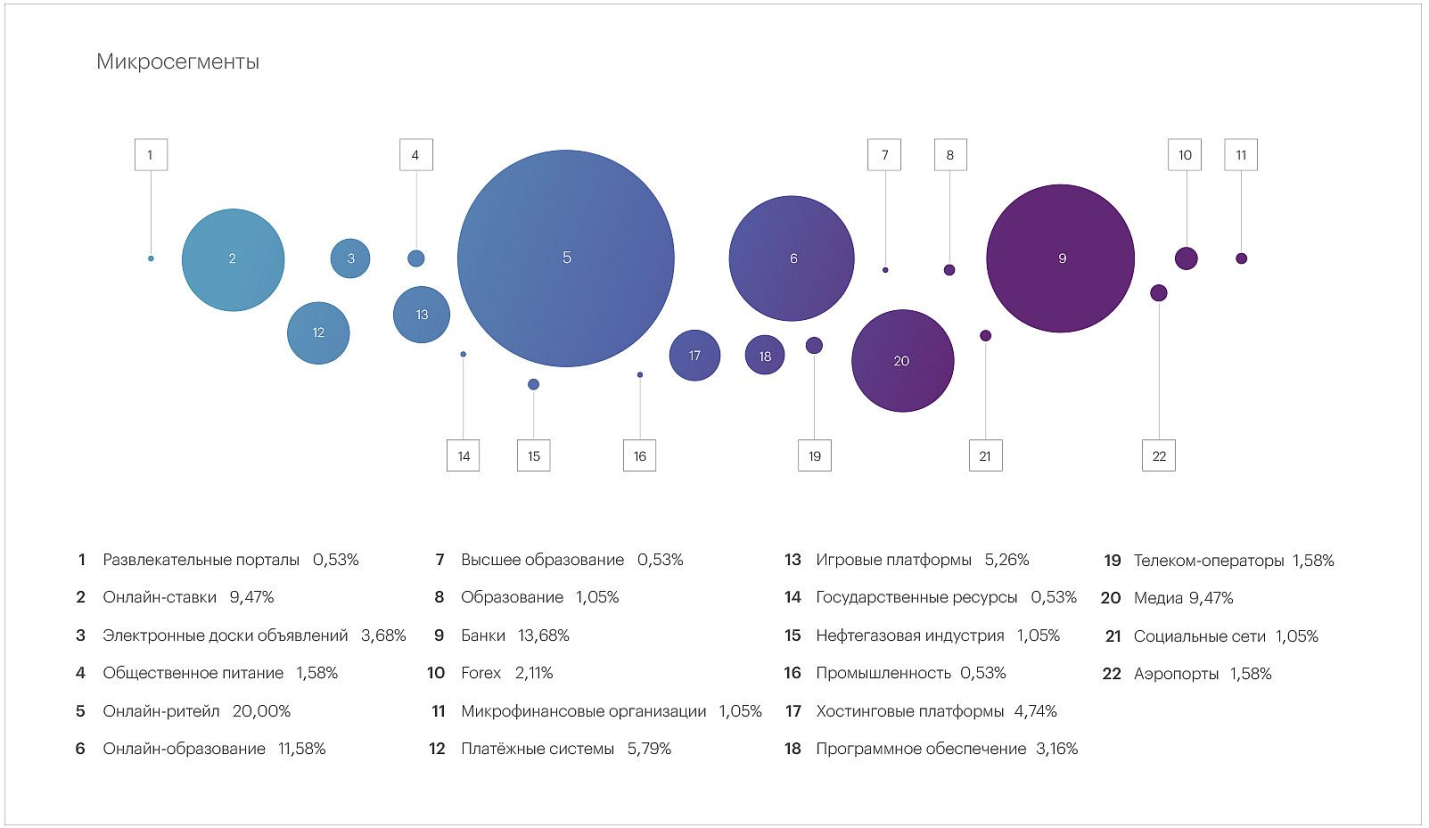

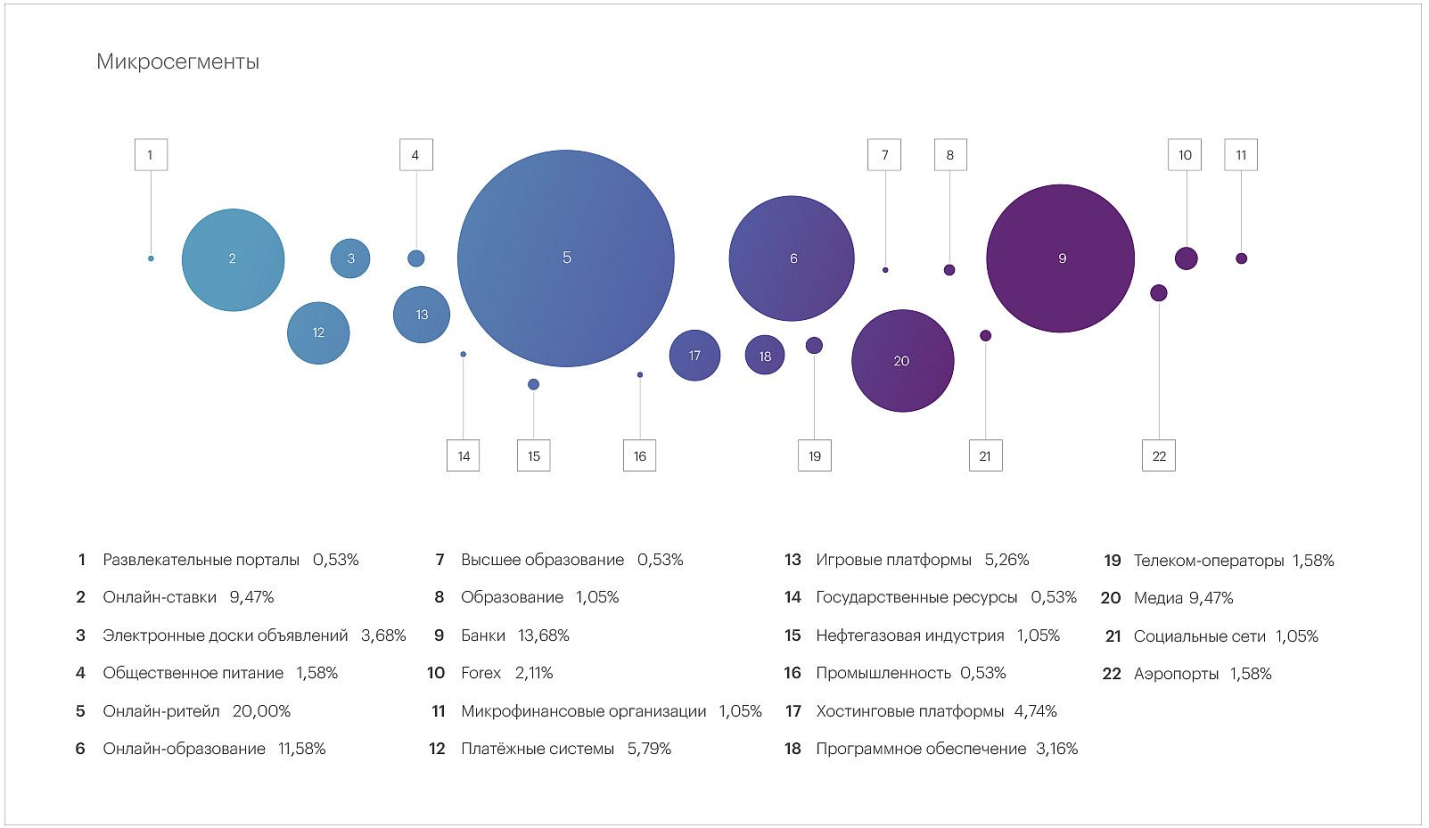

Чаще всего в отчетный период злоумышленники атаковали представителей сферы электронной коммерции и финтеха (25,26 и 22,63% DDoS-инцидентов соответственно). В разделении вертикалей на микросегменты по числу атак лидируют интернет-магазины, банки и онлайн-образование.

Самые мощные DDoS были зафиксированы в микросегментах «Онлайн-ставки» (881,8 Гбит/с), «Интернет-магазины» (686,6 Гбит/с), «Хостинговые платформы» (270,5 Гбит/с). Квартальный рекорд по продолжительности поставила атака на неназванную торговую точку: дидосеры пытались нарушить ее работу почти три недели, с 1 по 20 февраля.

«Все вышеперечисленные кейсы, на наш взгляд, имеют признаки коммерческих атак, которые начали набирать популярность в прошлом году, — отметил гендиректор Qrator Дмитрий Ткачев. — Это закономерно, ведь мы уже рассказывали о расширении каналов связи, переходе на новые протоколы для оптимизации работы удаленных офисов, легкости и низкой стоимости организации DDoS-атак. Все это дает хорошие возможности влияния на бизнес для злоумышленников».

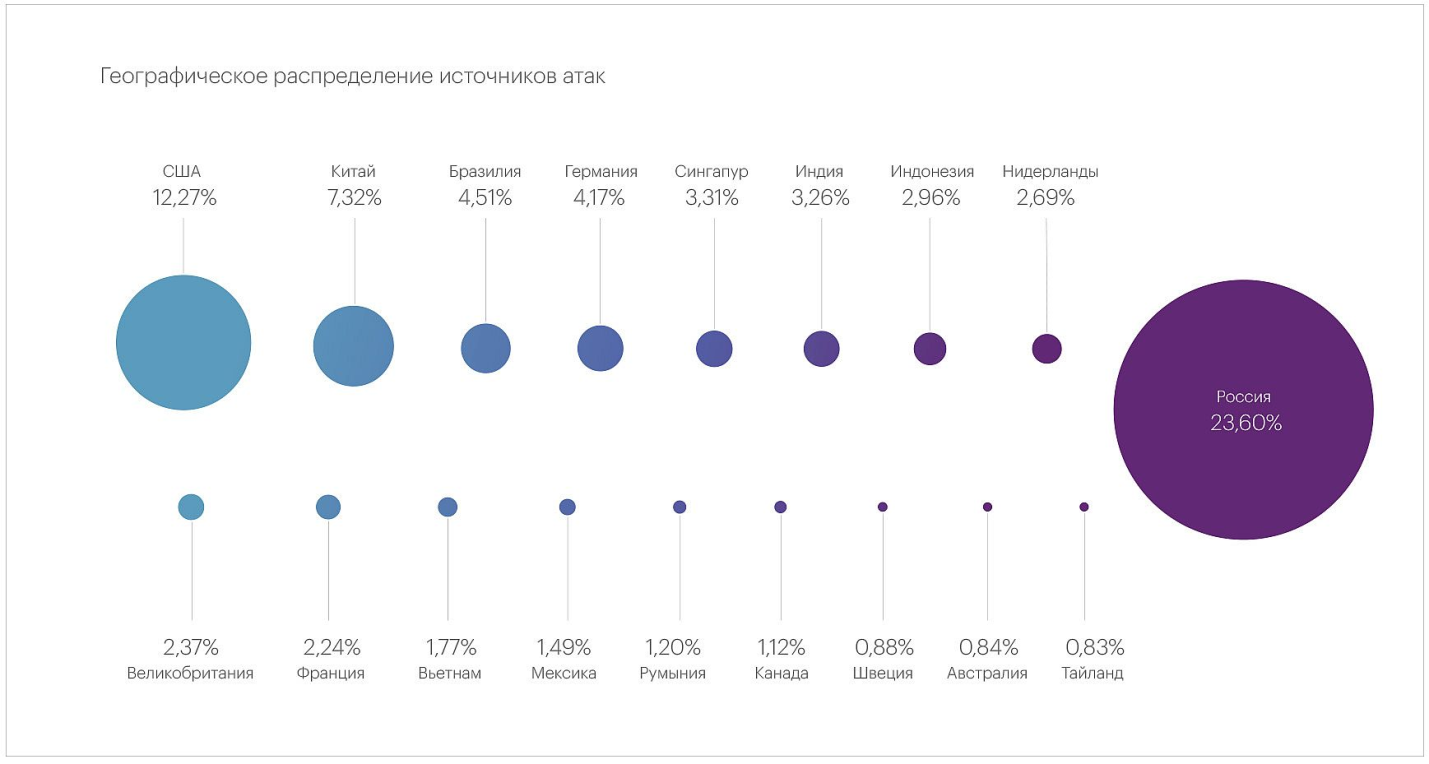

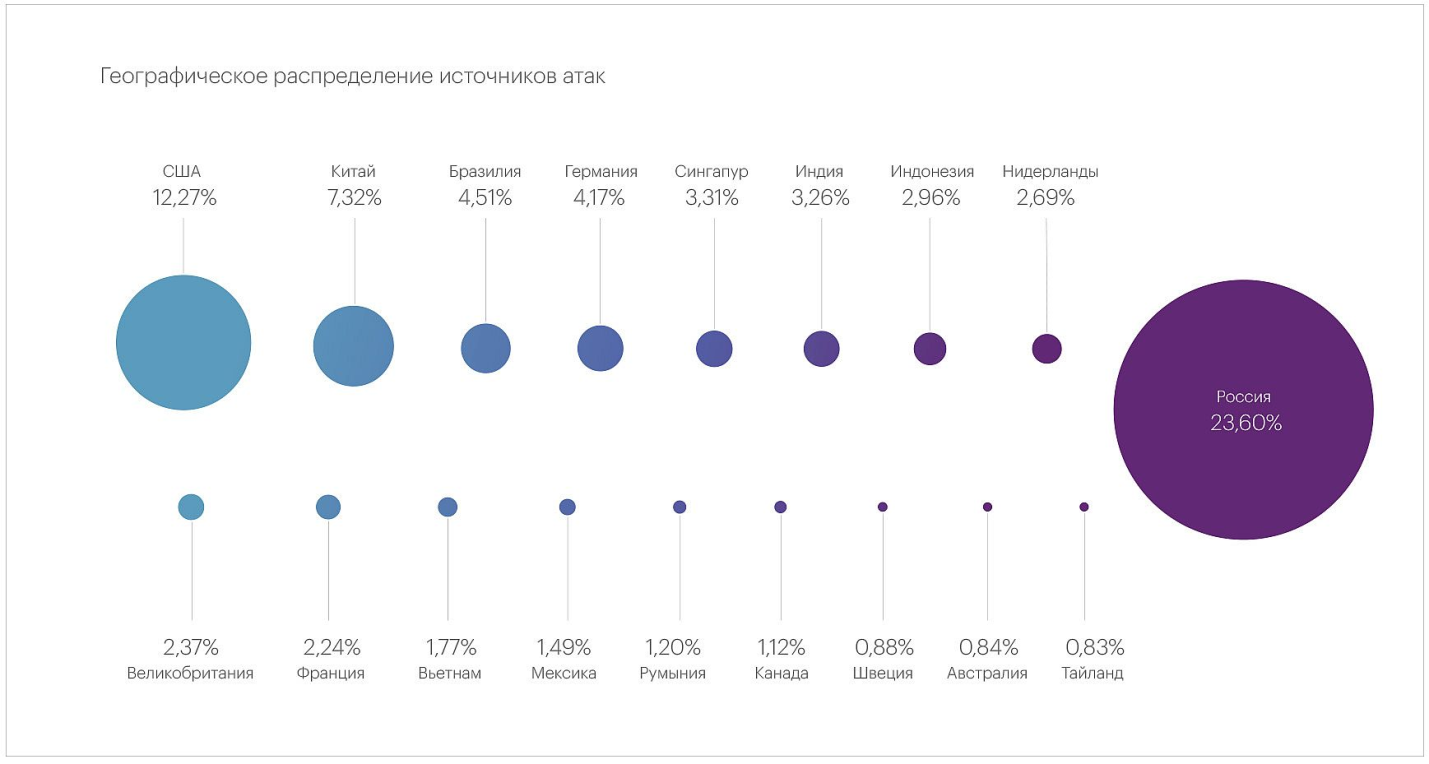

Список стран – основных источников мусорных потоков почти не изменился; его по-прежнему возглавляют Россия, США и Китай. При этом в сравнении с IV кварталом 2023 года доля заблокированных российских IP сократилась почти в два раза, тогда как показатели многих других участников рейтинга в такой же мере ухудшились.

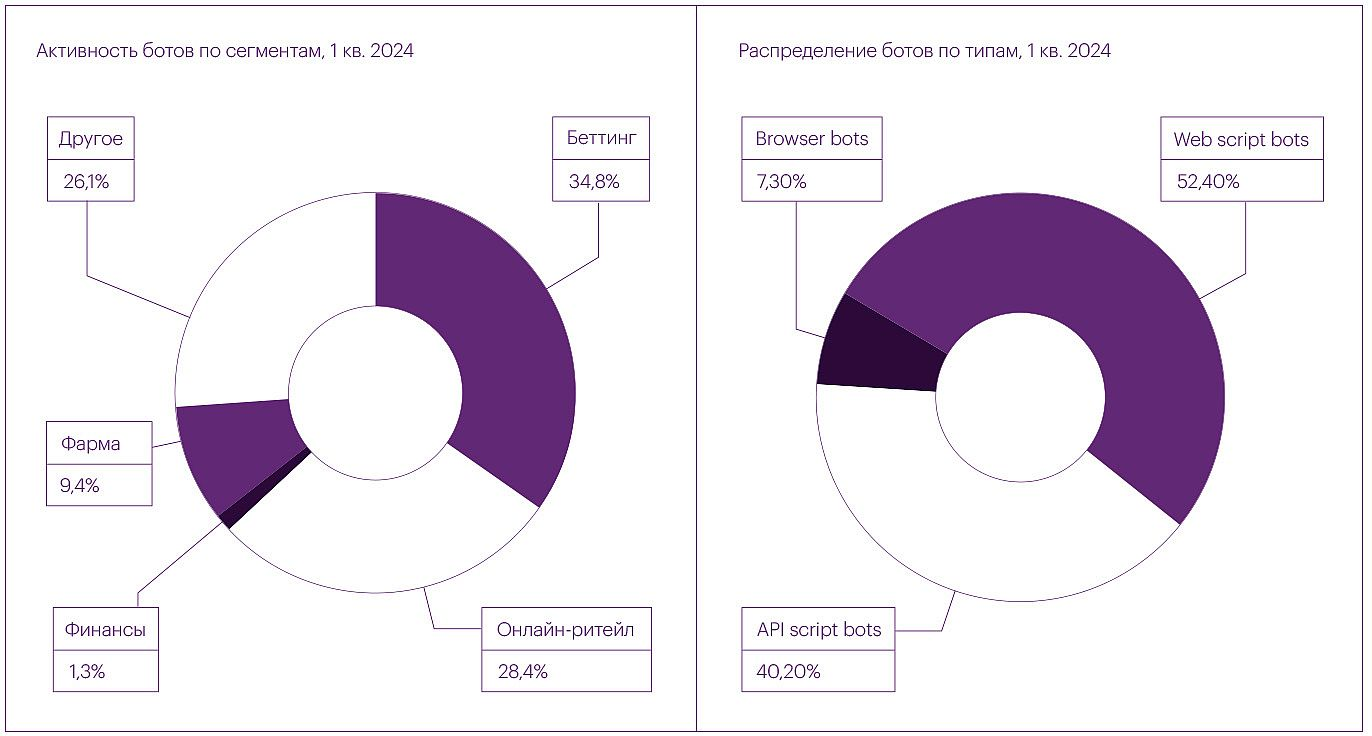

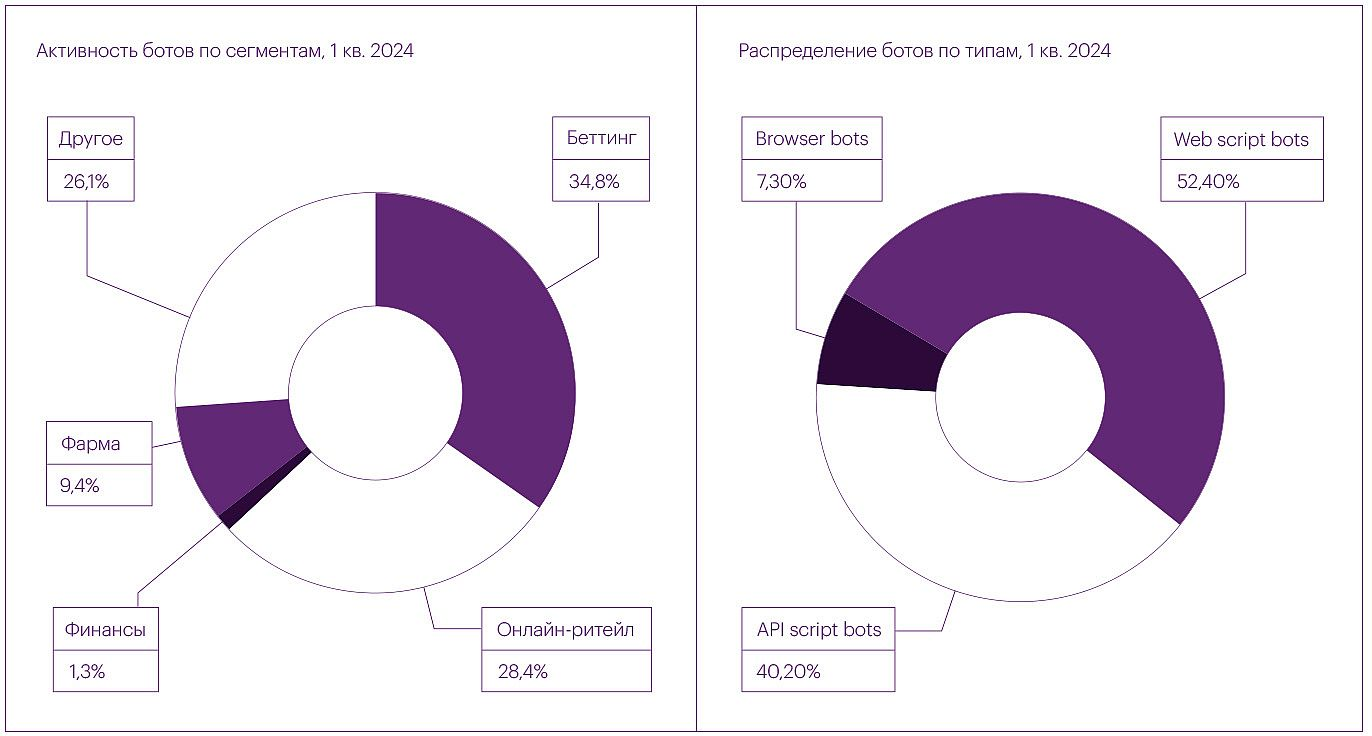

Суммарное число заблокированных запросов, подаваемых ботами, возросло на 18,4%, превысив 5 миллиардов. Самым напряженным месяцем в этом плане оказался январь (1,8 млрд запросов ботов).

Больше прочих от автоматизированных DDoS-атак страдали беттинговые сайты. Участились случаи применения сложных браузерных ботов: злоумышленники активно осваивают новые платформы с улучшенными средствами обхода защиты.

Самый большой ботнет, с которым столкнулись специалисты по защите от DDoS в I квартале, состоял из 51,4 тыс. боевых единиц. Он был пущен в ход 19 февраля против представителя сегмента онлайн-ставок. На сайт обрушился поток, на пике достигший 79,3 тыс. запросов в секунду; его дружно генерировали зараженные устройства, расположенные в девяти странах, в том числе в США и России.

В этом году эксперты ожидают дальнейший рост бот-активности — во II и III кварталах еще на 20%.