Исследователи снова заглянули под капот WhatsApp (принадлежит корпорации Meta, признанной экстремистской и запрещённой в России) и там, мягко говоря, не всё в порядке. Специалисты Mysk заявили, что на macOS и iOS мессенджер может хранить базы чатов в незашифрованном виде внутри общего контейнера приложений Meta.

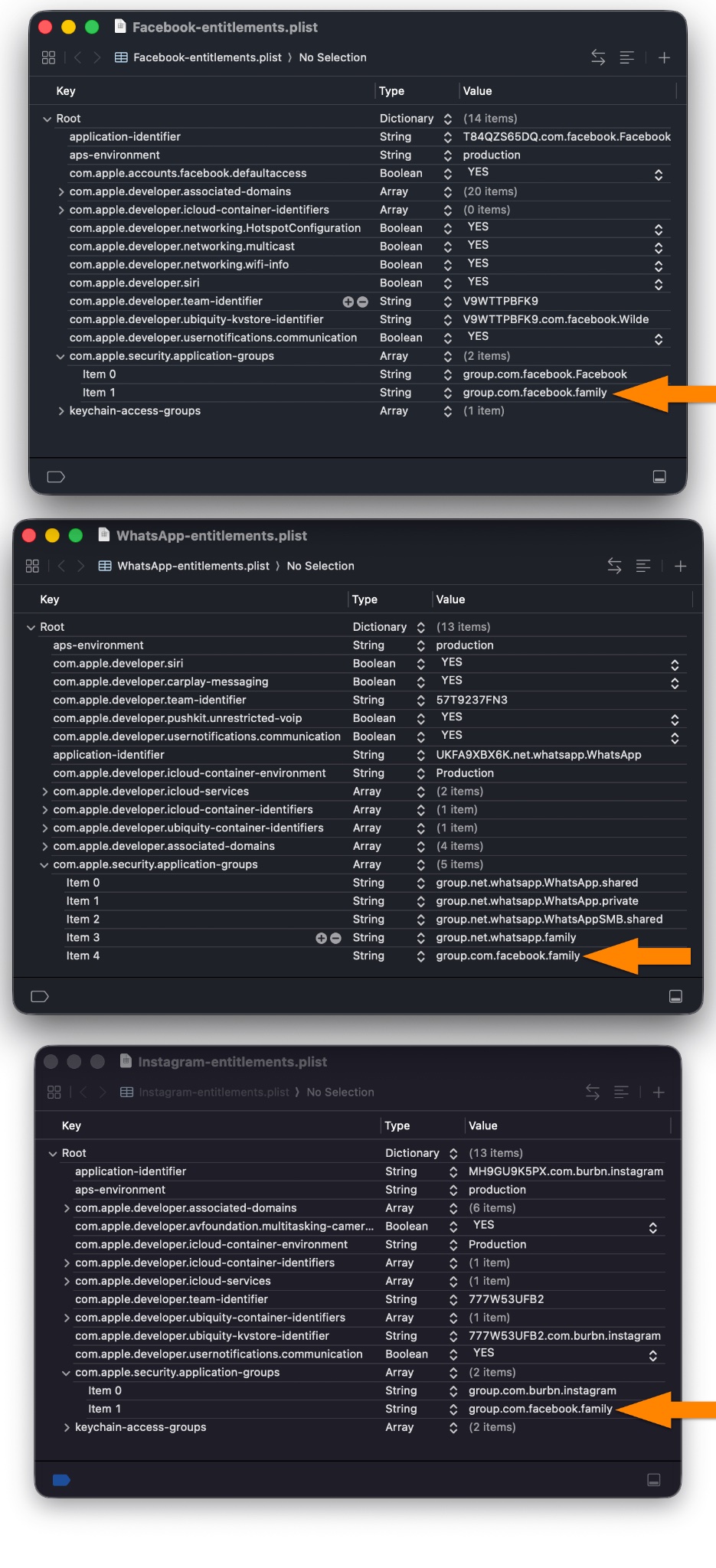

Речь идёт о механизме app group containers на платформах Apple. Он нужен, чтобы приложения одного разработчика могли обмениваться данными.

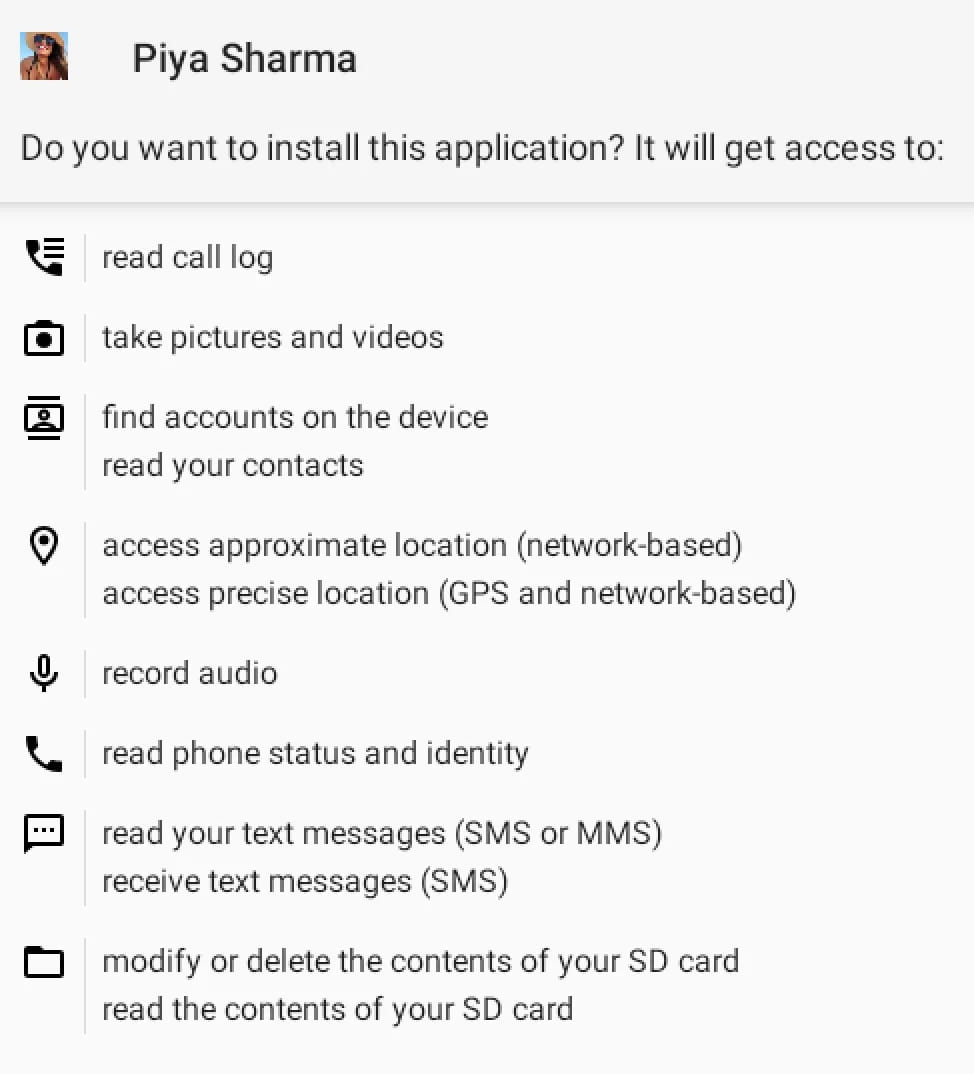

В случае Meta это общий контейнер group.com.facebook.family, которым, по данным исследователей, могут пользоваться WhatsApp, Facebook и Instagram (принадлежит корпорации Meta, признанной экстремистской и запрещённой в России).

Главная претензия простая: если история переписок лежит локально без шифрования, то сквозное шифрование уже не выглядит таким бронебойным. Да, оно защищает сообщения при передаче, но не гарантирует, что локальная база на устройстве будет такой же неприступной.

По словам Mysk, другие приложения Meta на том же устройстве теоретически могут получить доступ к данным WhatsApp без отдельного согласия пользователя. При этом никаких понятных уведомлений для пользователя о таком доступе не предусмотрено.

Исследователи также показали, что данные чатов можно извлечь из резервных копий iPhone, где видна та же незашифрованная структура. То есть проблема касается не только самого приложения, но и того, как эти данные живут в бэкапах.

Отдельно ситуацию портит уязвимость macOS CVE-2026-28910 в Archive Utility. Она позволяла обходить защиту App Sandbox и получать почти неограниченный доступ к файловой системе. В связке с особенностями хранения WhatsApp это могло дать атакующим доступ к чатам, а также данным других приложений вроде Сообщения и Safari.

Правда, не все считают ситуацию катастрофой. WABetaInfo отмечает, что локальные базы WhatsApp всё же находятся внутри песочницы Apple, а значит, просто так залезть туда стороннее приложение не должно. Для доступа нужны системные привилегии или эксплуатация уязвимостей ОС.

Но Mysk отвечает: общий контейнер приложений Meta сам по себе ослабляет изоляцию. Пользователь может думать, что WhatsApp, Facebook и Instagram живут каждый в своей комнате, а на деле у них может быть общий коридор с дверями без нормальных табличек.

Пользователям советуют включать шифрование резервных копий iPhone через iTunes или Finder, обновлять iOS и macOS, использовать надёжный пароль устройства и не плодить лишние приложения из одной экосистемы, если приватность действительно важна.

Активной массовой эксплуатации пока не зафиксировано.