Эксперты Kaspersky GReAT обнаружили новый троян CrystalX, который атакует российских пользователей и сочетает в себе сразу несколько опасных функций. Он умеет не только красть данные и следить за владельцем устройства, но и буквально устраивать над жертвой жестокий «розыгрыш», демонстративно вмешиваясь в работу компьютера в реальном времени.

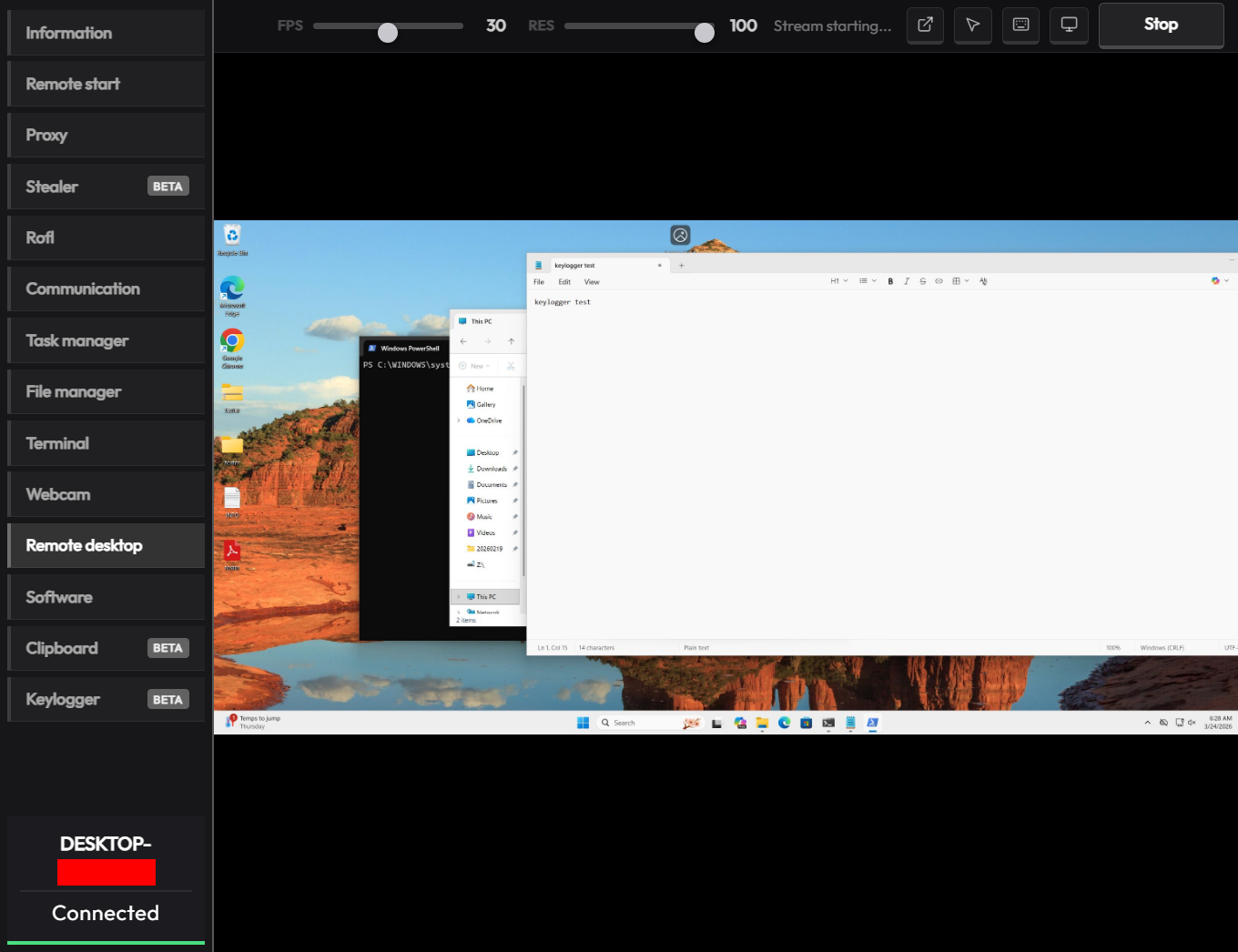

По сути, CrystalX — это не просто RAT, а целый набор вредоносных инструментов в одном. В нём сочетаются возможности стилера, кейлоггера, клиппера и шпионского софта.

Зловред может собирать системную информацию, похищать данные из браузеров, а также учётные записи Steam, Discord и Telegram. Отдельный риск он представляет для владельцев криптовалюты, поскольку умеет подменять адреса криптокошельков в буфере обмена.

Помимо этого, CrystalX умеет делать то, что выделяет его на фоне многих других вредоносных инструментов: злоумышленники могут вживую управлять заражённым устройством и превращать атаку в настоящее психологическое давление. Например, заставлять курсор дрожать, менять обои, переворачивать экран, скрывать иконки, выключать систему и отправлять жертве всплывающие сообщения. То есть пользователь не просто теряет контроль над компьютером, он ещё и видит это собственными глазами.

Кроме того, троян способен вести полноценную слежку. Он может делать снимки экрана, записывать звук с микрофона и видео — как с веб-камеры, так и непосредственно с экрана устройства. Получается довольно неприятная комбинация: кража данных, слежка и откровенное запугивание в одном пакете.

Отдельно эксперты обращают внимание на модель распространения CrystalX. Этот инструмент продвигается по схеме Malware-as-a-Service, то есть как «зловред по подписке» или как готовый сервис для других злоумышленников. Его рекламу уже заметили на YouTube и в Telegram. Такая модель заметно снижает порог входа для атакующих: пользоваться подобным инструментом могут не только опытные киберпреступники, но и менее квалифицированные злоумышленники.

Как отметил старший эксперт Kaspersky GReAT Леонид Безвершенко, CrystalX — это полнофункциональный инструмент для кражи данных и слежки, который к тому же позволяет оказывать на жертву дополнительное психологическое давление. По его словам, телеметрия компании уже фиксирует новые версии имплантов, а значит, зловред активно развивается и поддерживается. В Kaspersky ожидают, что в ближайшее время число жертв вырастет, а география распространения расширится.