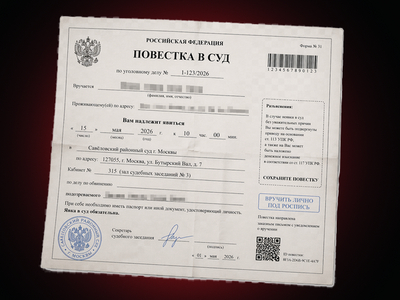

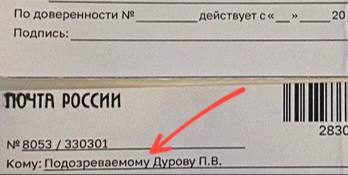

Павел Дуров снова выступил с резким заявлением о давлении со стороны российских властей. В своём телеграм-канале основатель Telegram написал, что в квартиру в России, где он жил 20 лет назад, пришла повестка на имя «подозреваемого П. В. Дурова».

В том же посте он иронично добавил, что его, видимо, подозревают в защите статей 29 и 23 Конституции России — о свободе слова и тайне переписки.

Формулировка получилась в фирменном стиле Дурова с политическим подтекстом и лёгкой насмешкой. Завершил он сообщение короткой репликой: «Proud to be guilty!»

Контекст у этого поста вполне конкретный. Ещё в феврале Дуров писал, что в России против него открыто уголовное дело по обвинению в содействии терроризму, и связывал это с попытками ограничить доступ россиян к Telegram и подавить право на приватность и свободное выражение мнений. О похожем расследовании тогда же сообщали и зарубежные СМИ.

На днях создатель Telegram также заявил, что французские власти выдвинули против него «более дюжины обвинений». Кроме того, Дуров отличился новой критикой в сторону WhatsApp, назвав шифрование зелёного месседжера крупнейшим обманом пользователей.