«Лаборатория Касперского» выпустила отчёт о цифровом насилии и выяснила следующее: 46% респондентов в мире за последние 12 месяцев сталкивались хотя бы с одной его формой, но только 32% вообще понимают, что означает этот термин. Под цифровым насилием понимают агрессивное или контролирующее поведение с использованием современных технологий.

Это могут быть оскорбления, онлайн-домогательства, преследование, создание фейковых аккаунтов, выдача себя за другого человека, доксинг, цифровая слежка или попытки изолировать человека через онлайн-коммуникации.

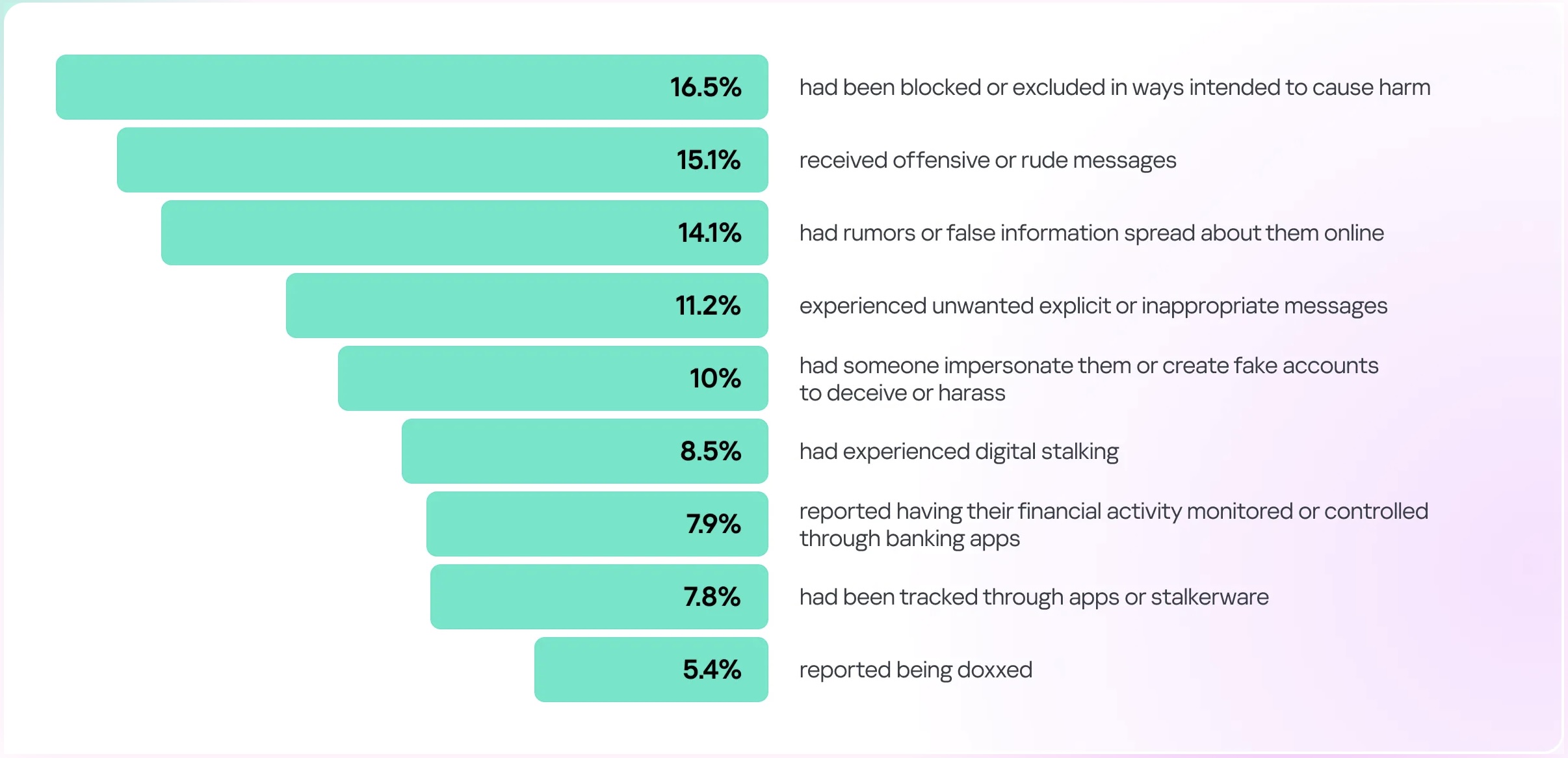

По данным исследования, среди тех, кто сталкивался с цифровым насилием, в среднем на одного человека приходилось больше двух его форм. Самой распространённой стала блокировка или изоляция с целью причинить вред — с этим столкнулись 17% респондентов. Ещё 15% получали оскорбительные или грубые сообщения, почти 8,5% сталкивались с цифровым преследованием, а 5% — с доксингом.

Отдельная мрачная зона — цифровой контроль в личных отношениях. После расставаний технологии часто превращаются не в удобный способ связи, а в пульт давления: угрозы в соцсетях, публикация личных данных, создание дипфейков, онлайн-слежка.

В одном из примеров, который привели эксперты, телефон ребёнка использовали для скрытого отслеживания перемещений бывшей супруги.

Растёт и рынок киберсталкинга. По данным Kaspersky Digital Footprint Intelligence, в даркнете услуги для доксинга и цифровой слежки могут стоить от 50 до 4 тыс. долларов. Параллельно распространяется сталкерский софт — коммерческие программы, которые позволяют тайно следить за человеком через смартфон.

Такие приложения могут получать доступ к сообщениям, фотографиям, геолокации, соцсетям, а иногда к аудио- и видеозаписям в реальном времени. Обычно для установки нужен физический доступ к устройству, но дальше программа работает тихо в фоне. Жертва может жить обычной жизнью и даже не подозревать, что её телефон давно стал карманным шпионом.

В 2024-2025 годах решения «Лаборатории Касперского» обнаружили сталкерские программы на устройствах более 34 тыс. пользователей, а за последние пять лет — более чем у 127 тыс. человек в более чем 160 странах. Россия, Бразилия и Индия снова оказались среди стран, наиболее затронутых этой проблемой.