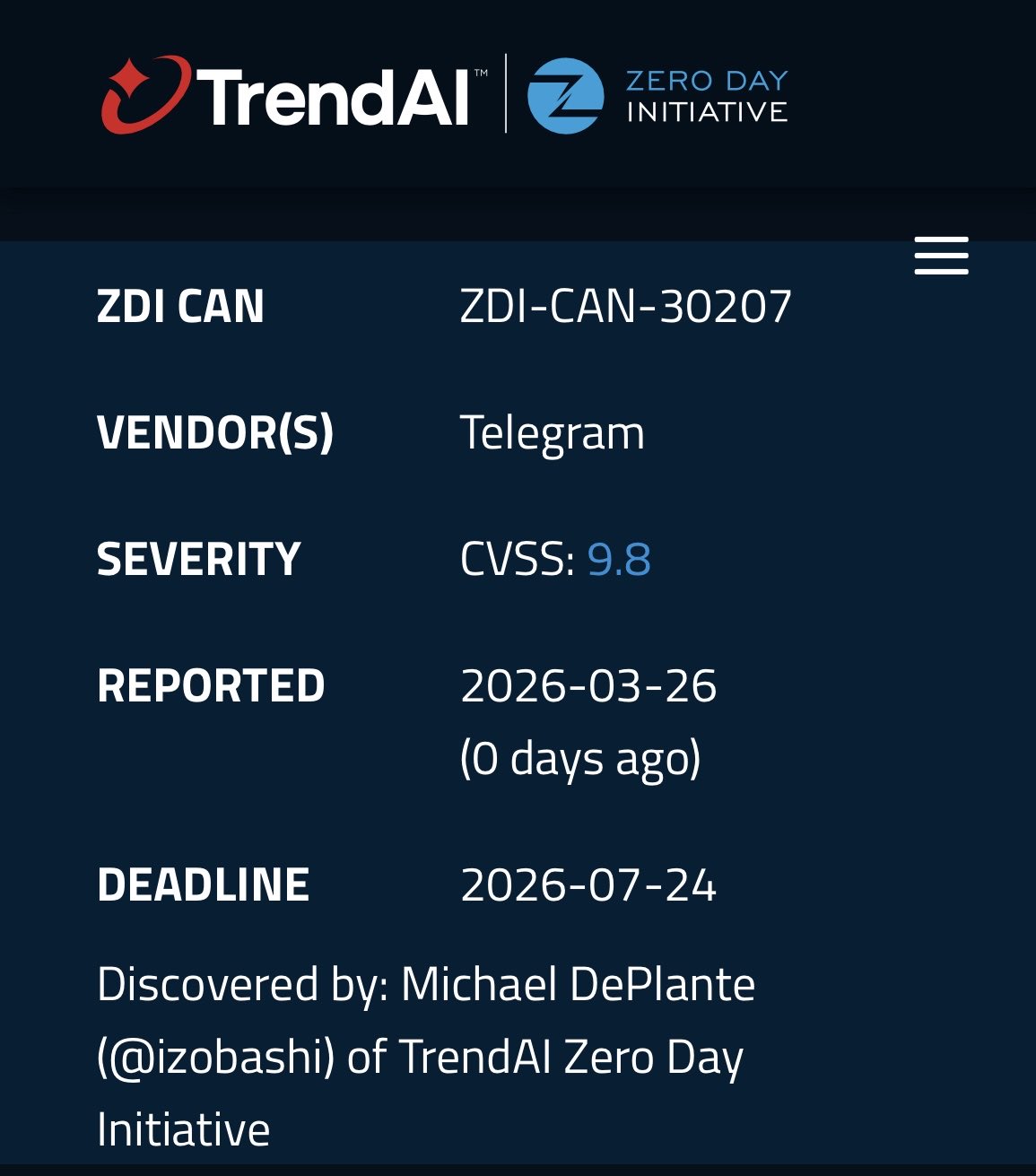

У разработчиков Telegram появился очень неприятный повод для срочного патчинга. В списке проекта Zero Day Initiative появилась запись ZDI-CAN-30207 для Telegram с 9,8 балла из 10 по CVSS. Уязвимость, как указано в карточке, была передана вендору 26 марта 2026 года, а дедлайн для публичного раскрытия назначен на 24 июля 2026 года.

Исследователем значится Michael DePlante (@izobashi) из проекта TrendAI Zero Day Initiative.

Самое важное здесь то, что технических подробностей пока нет. ZDI обычно не раскрывает механику таких находок до тех пор, пока у вендора есть время на выпуск патча.

Поэтому громкие формулировки про «тотальный взлом» или уже идущие массовые атаки сейчас были бы преувеличением: на данный момент публично подтверждено только существование записи о критической уязвимости и окно, отведённое Telegram на устранение.

Тем не менее сама оценка в 9,8 балла выглядит очень серьёзно. В карточке используется вектор AV:N/AC:L/PR:N/UI:N, а это значит, что речь идёт об удалённой атаке с низкой сложностью, которая допускается без привилегий и без участия пользователя.

Проще говоря, если эта оценка подтвердится после публикации полного отчёта, проблема действительно может оказаться из категории самых опасных.

Пока Telegram публично, по доступным данным, эту находку не комментировал. На официальных новостных страницах мессенджера свежего сообщения именно по ZDI-CAN-30207 сейчас не видно.