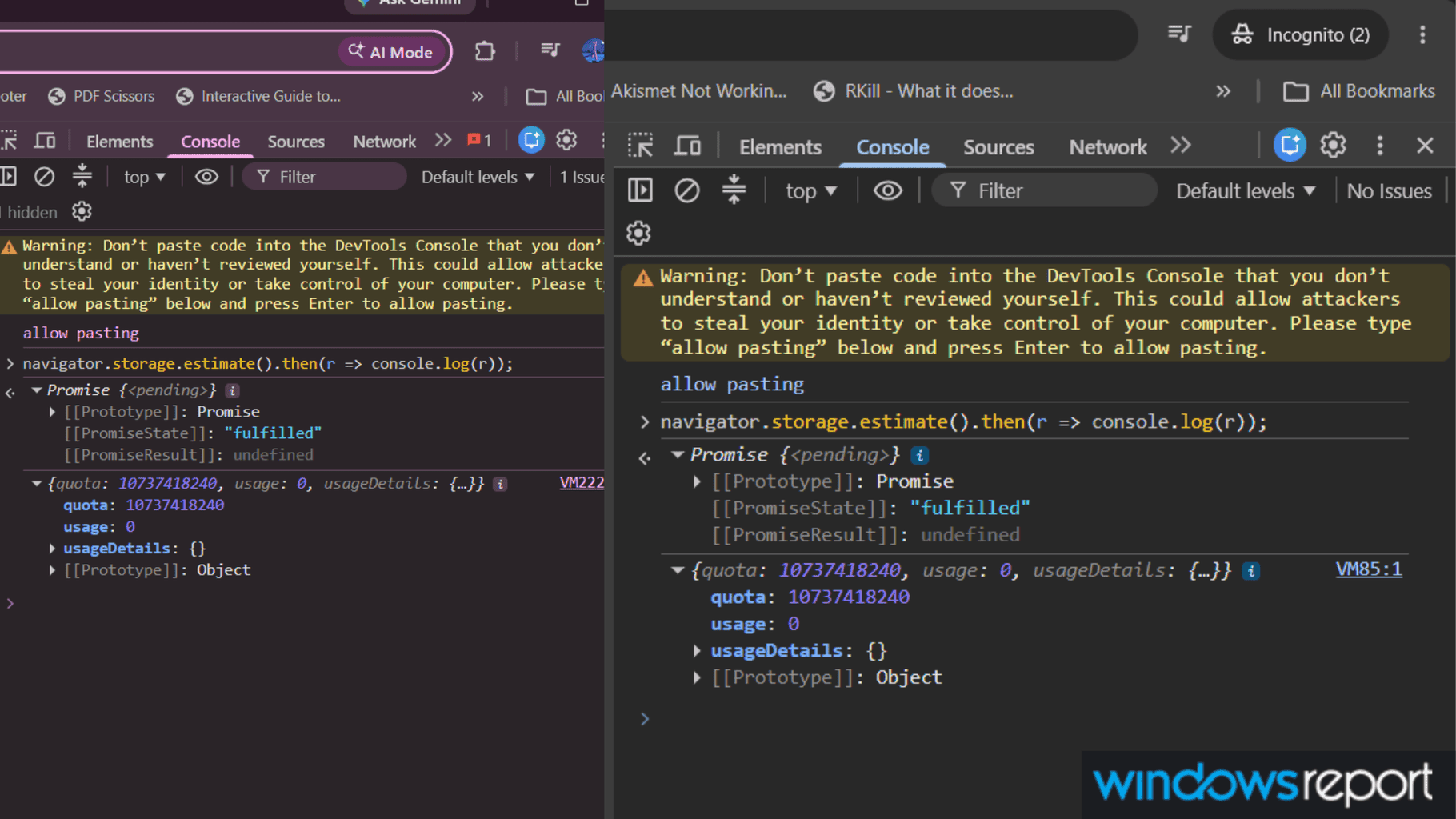

Google снова подкрутил Chrome так, чтобы сайтам было сложнее вычислять пользователей, сидящих в режиме инкогнито. Речь идёт о старом трюке, который годами использовали сайты и антифрод-системы. Через Storage API страницы могли запросить у Chrome информацию о доступном объёме хранилища.

В обычном режиме браузер показывал большой лимит, примерно соответствующий объёму диска устройства. А вот в режиме инкогнито он резко уменьшался, потому что данные там временные и сильно ограничены.

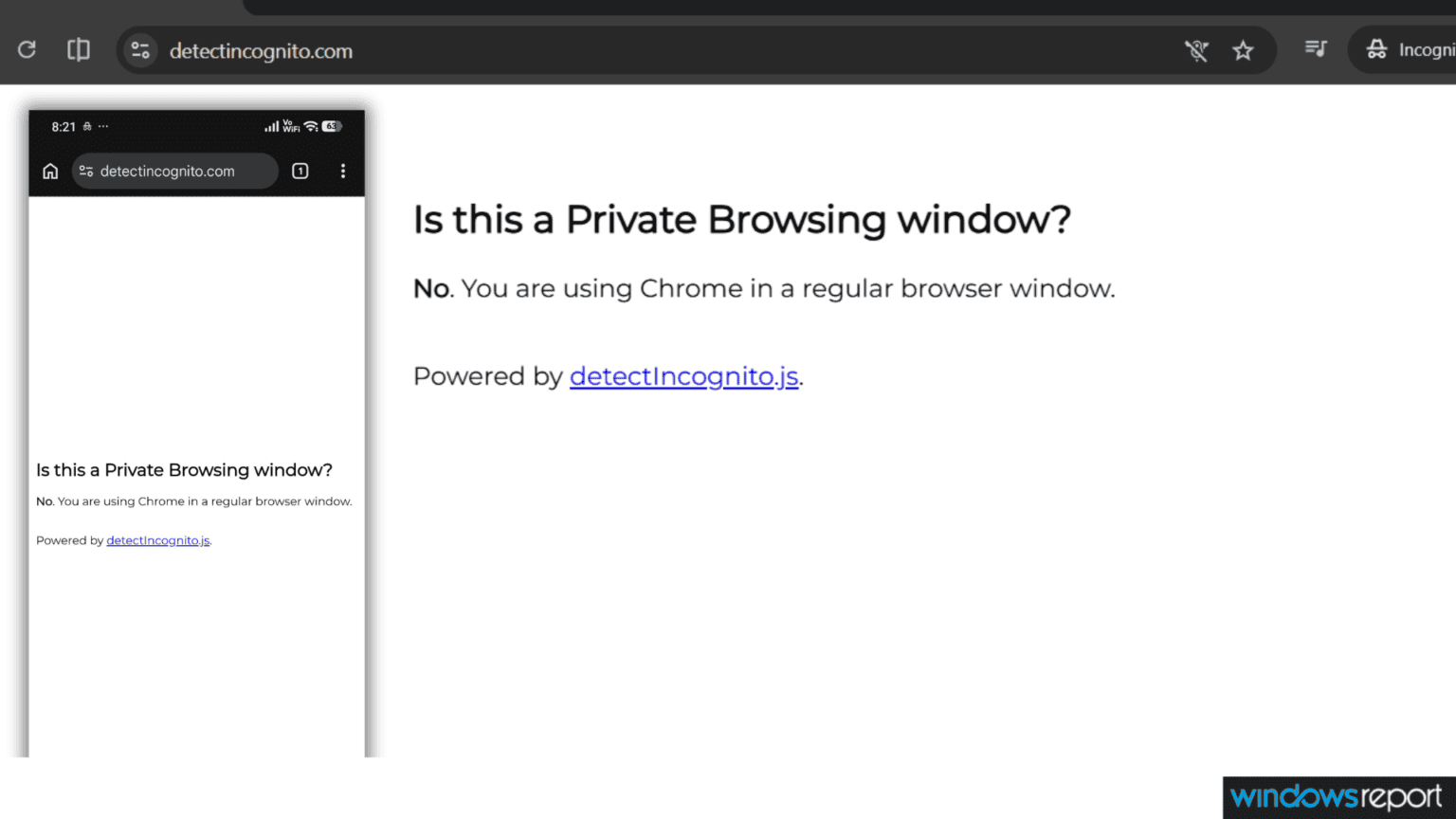

Этой разницы было достаточно, чтобы сервисы вроде detectIncognito почти безошибочно понимали: ага, пользователь открыл приватное окно.

Заодно сайты получали ещё один приятный бонус — возможность примерно оценить объём накопителя устройства. А это уже дополнительный отпечаток для слежки и фингерпринтинга.

Теперь Google решила прикрыть и эту лавочку. Chromium начал тестировать механизм predictable reported storage quota — предсказуемой квоты хранилища. Если коротко, Chrome перестаёт показывать сайтам реальные значения и вместо этого отдаёт одинаковый лимит независимо от режима работы браузера и железа пользователя.

Правда, в Google честно признают: полностью проблему это пока не убивает. Разработчики detectIncognito всё ещё могут определять приватные окна в стабильных версиях Chrome, используя комбинации разных сигналов. Но один из самых надёжных методов скоро отправится на пенсию.