Новая уязвимость в службе Active Directory Federation Services (ADFS), разработанной Microsoft, позволяет использовать двухфакторную аутентификацию одного аккаунта для других учетных записей в организации. Проблему обнаружил эксперт из Okta REX Эндрю Ли.

Брешь получила идентификатор CVE-2018-8340, используя ее вкупе с несложной фишинговой схемой, злоумышленник может поставить под угрозу учетные записи, принадлежащие другим сотрудникам или руководителям организации.

Также атакующий может получить доступ к конфиденциальной информации через различные ресурсы компании.

«Многие организации полагаются на ADFS в качестве некого гейткипера. Агенты ADFS представляют собой расширения, которые позволяют службе взаимодействовать с провайдером 2FA, которому делегируется проверка многофакторной аутентификации», — объясняет Ли.

«Среди провайдеров 2FA, кроме самой Microsoft, есть и сторонние вендоры: Okta, Gemalto, Duo, Authlogics, RSA и SecureAuth».

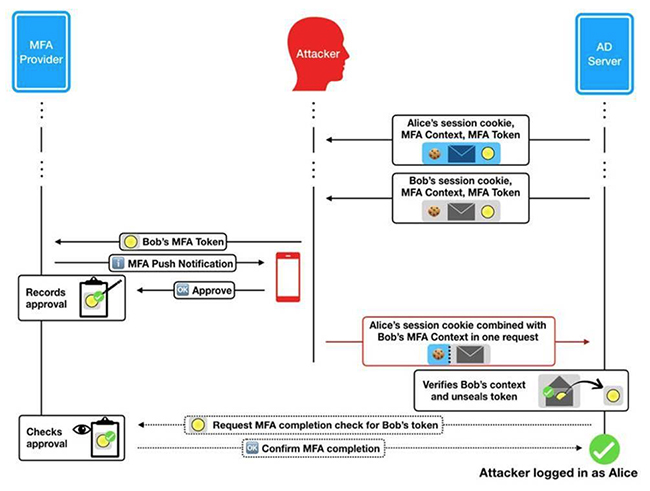

Обнаруженная Ли возникает из-за того, что протокол проверяет учетные данные и факторы самой аутентификации, но при этом предоставленный фактор не связан с фактической учетной записью.

Эксплуатация этой уязвимости наиболее очевидна и возможна со стороны злонамеренного инсайдера, у которого при этом имеется собственный легитимный аккаунт. Однако использовать брешь может также злоумышленник, который получит доступ к легитимной учетной записи.

Сценарий атаки проще осуществить с помощью аккаунта, имеющего низкие права доступа. После получения доступа атакующий сможет скомпрометировать аккаунт с более высокими привилегиями, используя ту же брешь.

Эксперт попытался разработать собственную концепцию устранения этой уязвимости, однако это у него получилось лишь частично. Также Ли сообщил о проблеме Microsoft, которая выпустила соответствующий патч.