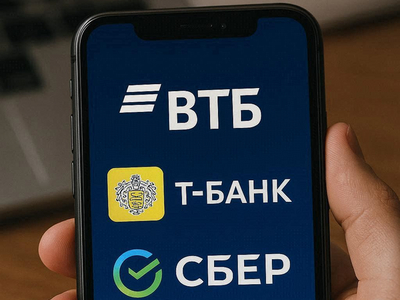

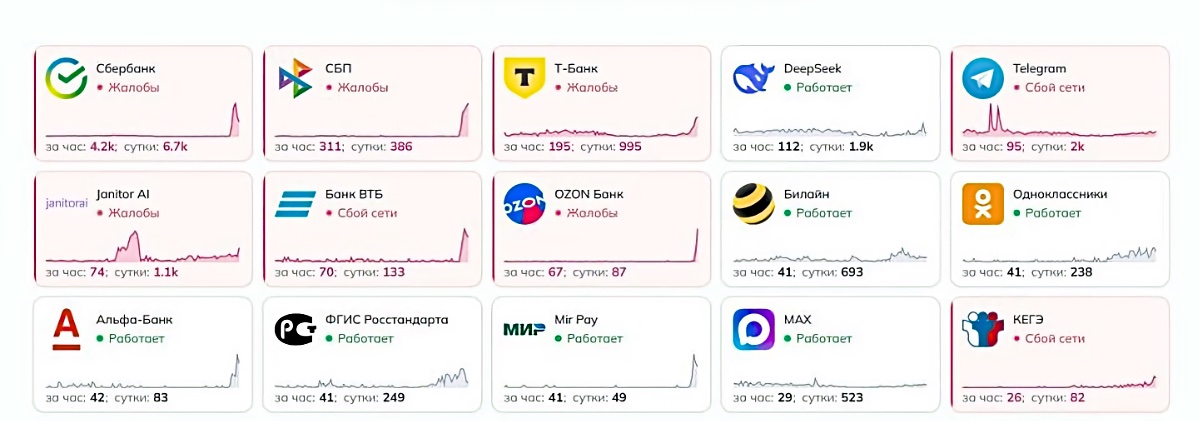

Утренний сбой в работе «Сбербанк Онлайн», похоже, быстро перестал быть историей только про один банк. Почти одновременно о проблемах с доступом к сервисам начали сообщать клиенты ВТБ, Т-Банка, Ozon-банка, а также пользователи системы быстрых платежей.

Судя по сообщениям пользователей и данным сервисов мониторинга сбоев, неполадки затронули сразу несколько крупных финансовых платформ.

Тут дело точно не в локальной проблеме внутри одного приложения, а в более широкой волне сбоев, которая задела сразу несколько заметных игроков финансового рынка.

Больше всего жалоб поступает из крупнейших регионов страны — Москвы, Санкт-Петербурга, Московской, Свердловской и Новосибирской областей. Но только ими дело не ограничилось: о перебоях также сообщают пользователи из Самарской и Оренбургской областей, Приморского края, Татарстана, Удмуртии и других регионов.

При этом характер проблем у разных сервисов немного отличается. У клиентов ВТБ чаще всего возникают трудности с доступом к сайту, чуть реже — к мобильному приложению. У пользователей Т-Банка, наоборот, основной удар пришёлся именно по приложению, тогда как сайт упоминается заметно реже.

У Ozon-банка картина своя: там пользователи в основном жалуются на некорректную работу самих сервисов и приложения. Проблемы с сайтом, судя по обращениям, встречаются значительно реже.

Параллельно начали поступать сообщения и о сбоях в системе быстрых платежей. Пользователи пишут, что не могут переводить деньги и оплачивать покупки.