На одном из хакерских форумов выставили на продажу массив данных, который якобы содержит сведения о 340 млн пользователей популярного ресурса для взрослых OnlyFans. Скорее всего, речь идёт о компиляции из более ранних утечек и публично доступной информации из аккаунтов. Однако такие данные всё равно могут использоваться для шантажа, фишинга и других атак.

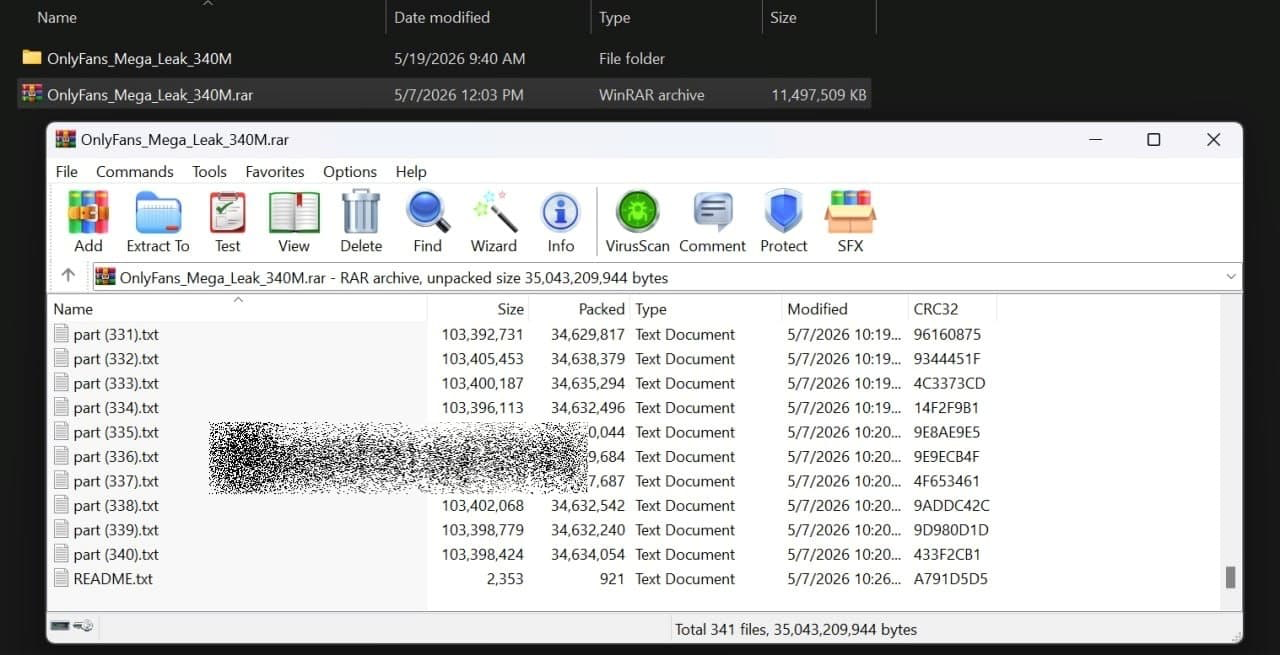

Об обнаружении объявления сообщил портал Hackread. Пользователь под ником Euphoric_Reply_5727 предлагает за 0,3 биткоина сведения о 340 млн пользователей и авторов контента.

По данным из объявления, массив содержит имена пользователей, ники профилей, адреса электронной почты, номера телефонов, даты создания аккаунтов, статистику контента, рейтинги авторов и подписчиков, связанные профили в социальных сетях, а также частичные платёжные данные — последние четыре цифры номера карты.

Продавец утверждает, что получил данные из внутренних систем платформы. Однако в личной переписке он признал, что собрал массив из разных источников и сопоставил его с публично доступной информацией из аккаунтов. При этом проверка Hackread показала, что база как минимум частично содержит актуальные сведения.

Из-за этого такие данные могут использоваться для шантажа, фишинга, подбора паролей, социоинженерных атак и других видов посягательств.

Официального сообщения от OnlyFans по поводу инцидента пока не было. Объективных данных, подтверждающих взлом платформы, также нет.

В январе текущего года в публичном доступе уже обнаружили массив почти из 150 млн логинов и паролей пользователей различных сервисов, включая OnlyFans. Предположительно, его источником были данные, собранные инфостилерами.