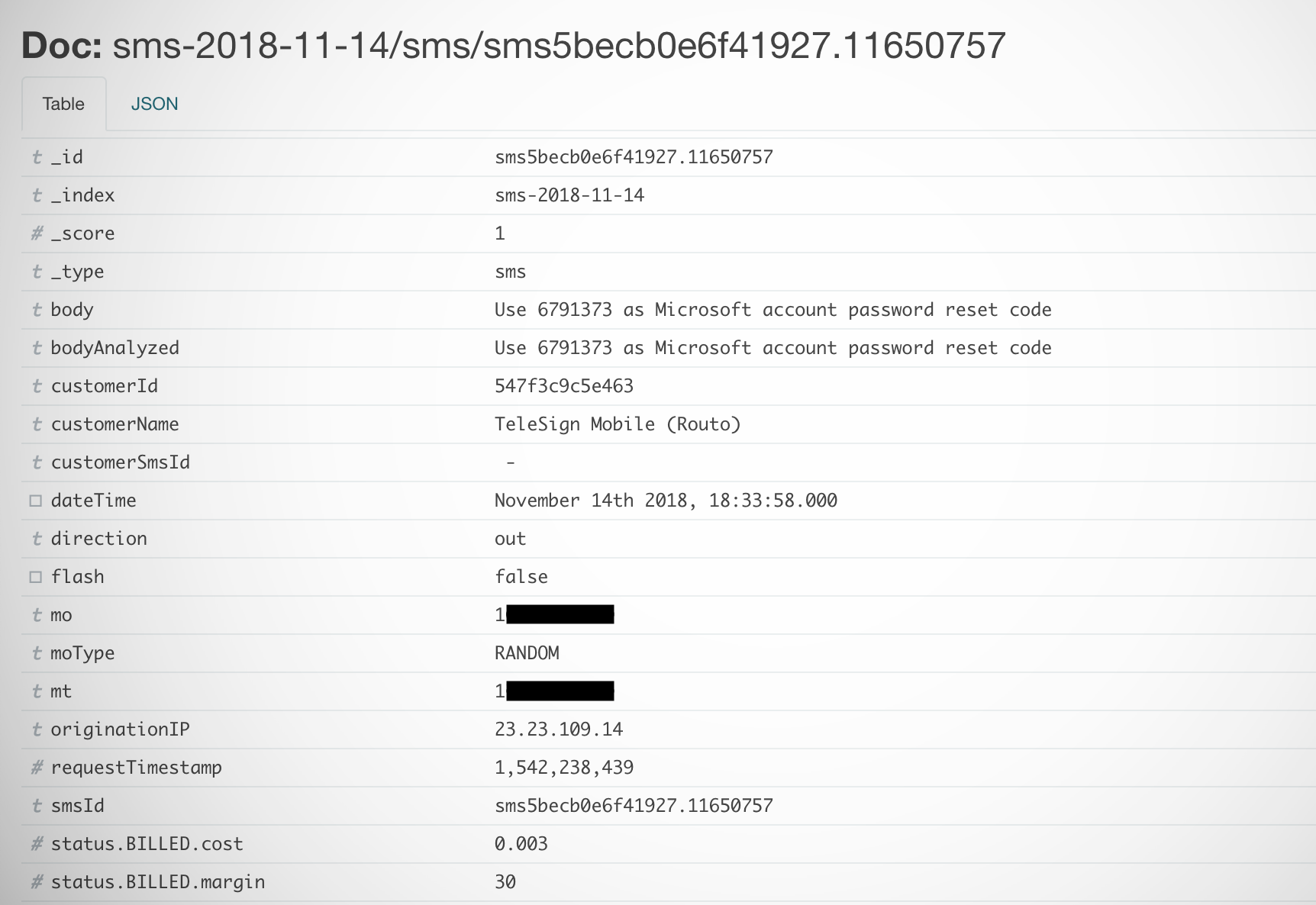

Сервер телекоммуникационной компании Voxox, офис которой находится в Сан-Диего, Калифорния, допустил масштабную утечку данных, среди которых были текстовые сообщения, содержащие ссылки на сброс паролей, коды двухфакторной аутентификации, уведомления о доставках и многое другое.

Проблема заключалась в том, что сервер не был защищен паролем, что позволяло любому осведомленному пользователю просматривать поток текстовых сообщений практически в реальном времени.

Себастьену Каулу, немецкому исследователю в области безопасности, не понадобилось много времени, чтобы найти эту дыру в безопасности. Обнаружить незащищенный сервер Каул смог благодаря специальному поисковику Shodan.

Ситуацию усугубляло то, что сервер был сконфигурирован таким образом, что данные на нем было легко прочитать, просмотреть и даже искать по именам.

Каул считает, что это очень серьезная проблема, ведь многие пользователи совершенно не задумываются о том, что происходит с их текстовыми сообщениями после получения — где они хранятся и так далее.

После сообщения эксперта, передает TechCrunch, Voxox закрыла базу данных.