На этой неделе стало известно о существовании ботнета Advanced Power. Угроза исходит от поддельной версии плагина Microsoft .NET Framework Assistant для браузера Firefox. Программа берет компьютеры под контроль и превращает их к зомби, которые ищут на сайтах SQL-уязвимости.

Зараженный ПК начинает исследовать вебсайты на предмет уязвимости внедрения вредоносного кода. Mozilla сообщила, что уже заблокировала поддельный плагин Microsoft .NET Framework. Это сделали для защиты пользователей Firefox. Вредоносный компонент отключится автоматически, так что клиентам не нужно ничего делать.

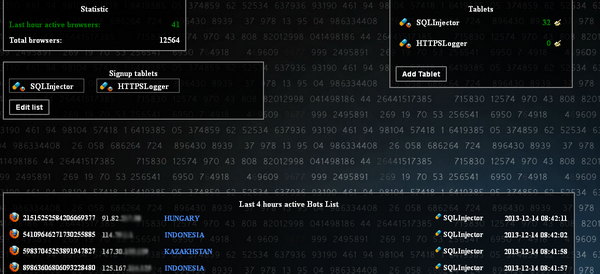

По словам Кребса, ботнет инфицировал более 12 тыс. компьютеров. Кибер-преступники используют вредоносную программу для слежки за страницами, которые посещают владельцы зараженных устройств. Затем они способны применять найденные бреши безопасности, чтобы атаковать ресурсы и красть информацию из баз данных.

Как минимум 1,8 тыс. пользователей были заражены. Пока неизвестно, как именно распространяются вредоносные программы. Возможно, они попадают на компьютер вместе с софтом с вебсайтов. Преступники способны использовать сайт, который заставляет жертв скачивать компоненты для просмотра видео или доступа к контенту.

Эксперты Mozila пообещали, что ужесточат свою борьбу с хакерами.