Киберпреступники провели целевую фишинговую кампанию, замаскировавшись под украинскую CERT-UA. Злоумышленники не просто рассылали письма, они создали клон официального сайта и предлагали жертвам скачать якобы «защитный инструмент», который на деле оказывался зловредом.

Атаки фиксировались 26-27 марта и были направлены на широкий круг организаций: государственные структуры, банки, учебные заведения, медицинские учреждения и ИТ-компании.

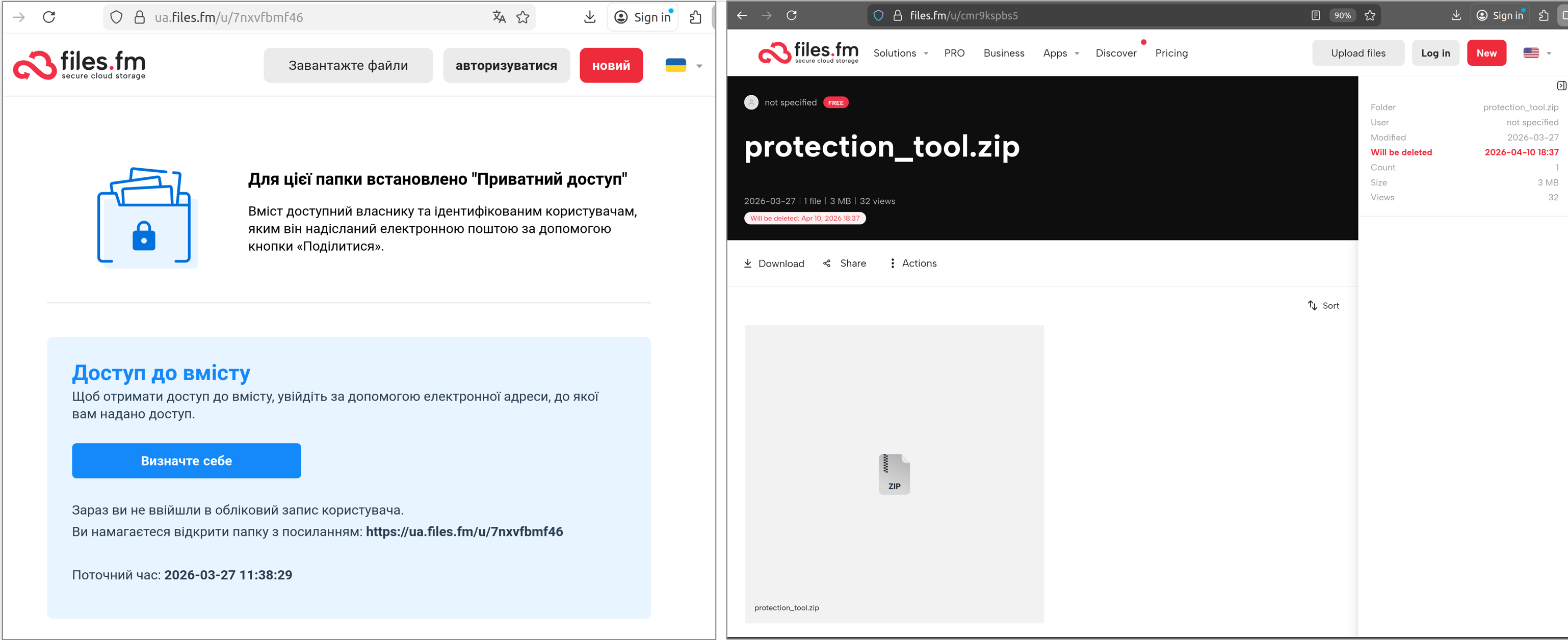

Сценарий выглядел убедительно: в письмах от имени CERT-UA предлагалось скачать архив с названием вроде «CERT_UA_protection_tool.zip», якобы содержащий средство защиты.

На практике внутри архива находился троян AGEWHEEZE. После запуска он давал атакующим полный контроль над системой: позволял выполнять команды, управлять файлами, делать скриншоты, следить за действиями пользователя и даже эмулировать нажатия клавиш и движения мыши.

Дополнительно злоумышленники подстраховались инфраструктурой. Они развернули поддельный сайт cert-ua[.]tech, визуально копирующий официальный ресурс CERT-UA и использующий его контент. Это повышало доверие и делало атаку ещё более правдоподобной.

Сам зловред написан на Go и умеет закрепляться в системе — например, через установку в каталог AppData и создание задач в планировщике. Для связи с командным сервером он использует WebSocket-соединение, что позволяет атакующим получать постоянный доступ к заражённым устройствам.

CERT-UA связала кампанию с группой UAC-0255. Косвенное подтверждение появилось и в публичном поле: телеграм-канал «КИБЕР СЕРП» заявил о причастности к атаке, а в коде поддельного сайта нашли характерную подпись «With Love, CYBER SERP».