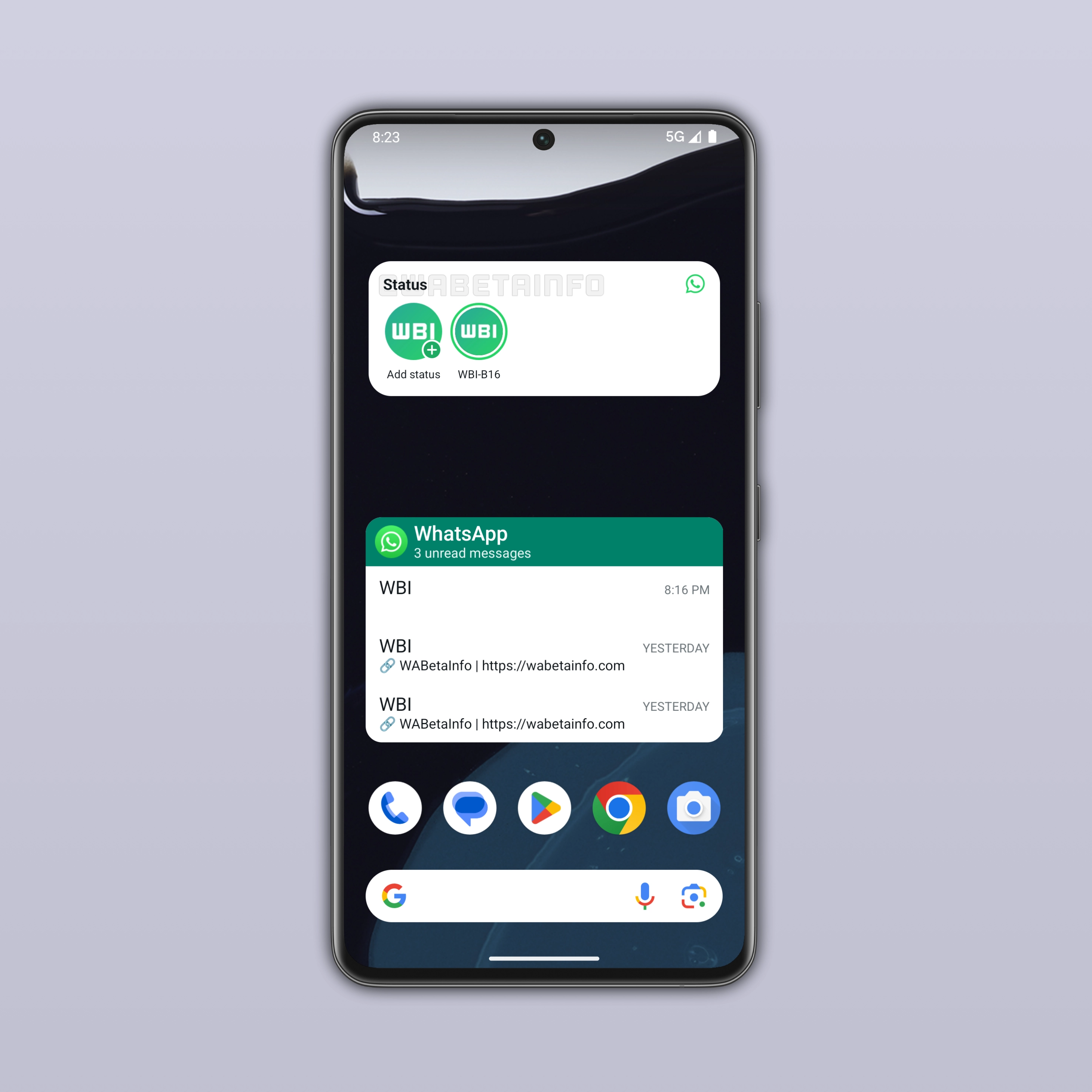

WhatsApp (принадлежит корпорации Meta, признанной экстремистской и запрещённой в России) работает над новым виджетом для Android, который позволит смотреть обновления статусов прямо с главного экрана смартфона. Функцию заметили в бета-версии WhatsApp для Android 2.26.18.5, доступной через программу Google Play Beta.

Пока виджет находится в разработке и недоступен даже бета-тестерам. Но уже понятно, как он должен работать: пользователь сможет добавить его на главный экран и быстро увидеть, кто недавно опубликовал статус, не открывая WhatsApp.

Сейчас для просмотра статусов обычно нужно зайти во вкладку «Обновления». Иногда обновления видны и в «Чатах» через кольца вокруг аватаров, но приложение всё равно приходится открывать. Новый виджет должен сделать этот сценарий быстрее: посмотрел на экран — сразу понял, у кого появился новый статус.

По данным WABetaInfo, виджет будет похож на тот, который WhatsApp ранее подготовил для iOS. Ожидается, что он сможет показывать ограниченное число контактов (вероятно, до трёх человек одновременно).

Также в виджете появится быстрый доступ к созданию нового статуса. То есть пользователь сможет начать публикацию прямо с главного экрана, без перехода во вкладку «Обновления».

Контакты в виджете будут выбираться не просто по времени публикации. WhatsApp планирует использовать локальную систему ранжирования: чаще показывать статусы людей, с которыми пользователь больше общается, недавно переписывался или закрепил чат. Также приоритет могут получать статусы, срок действия которых скоро истекает.

Важный момент: ранжирование работает локально на устройстве, поэтому WhatsApp подчёркивает приватный характер такого подхода.

Пока срок запуска функции не раскрывается. Виджет ещё дорабатывают, а полноценное появление ожидается в одном из будущих обновлений.