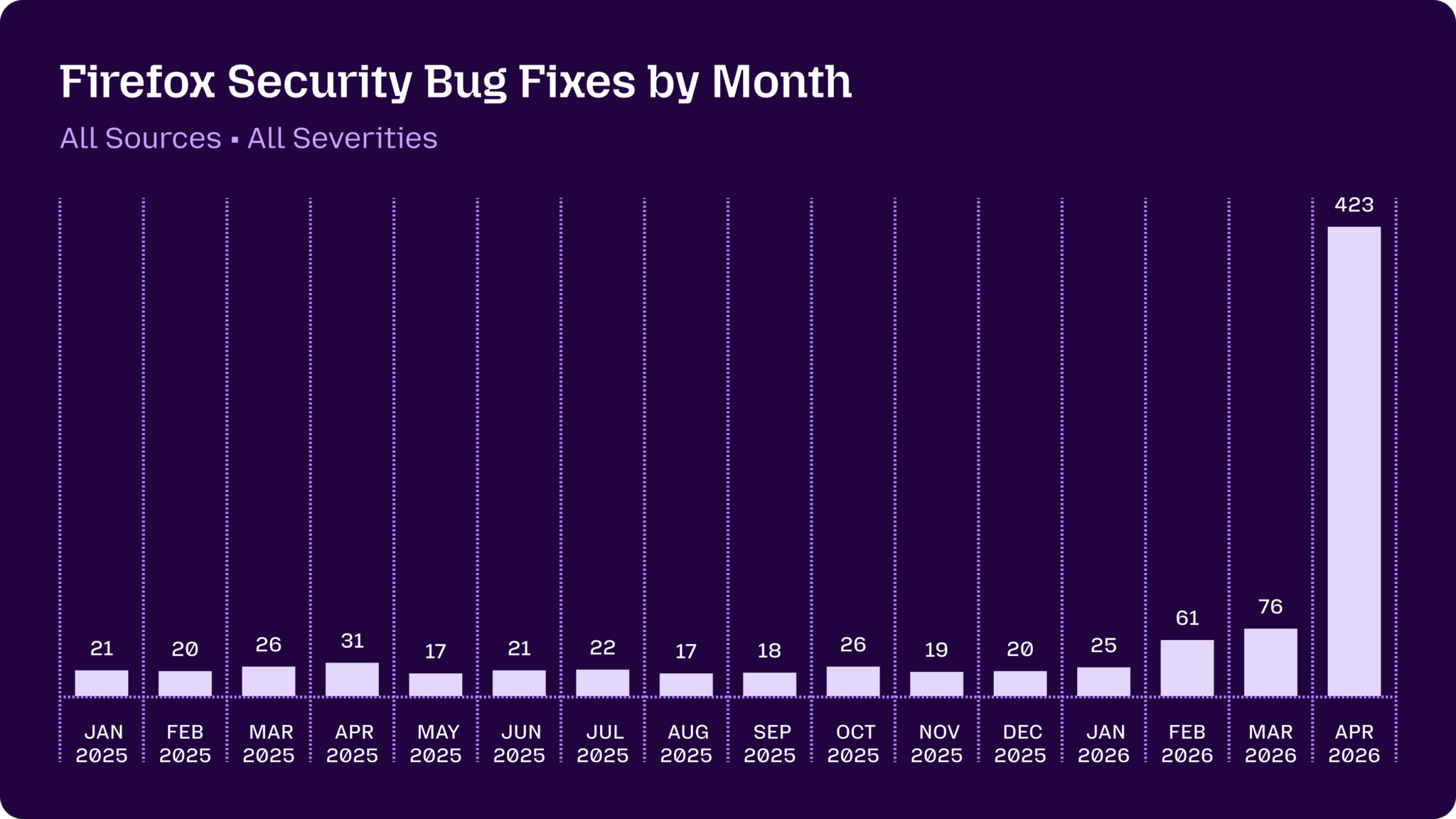

Mozilla рассказала о результатах нового ИИ-подхода к поиску уязвимостей в Firefox. С помощью продвинутых моделей, включая Claude Mythos Preview и Claude Opus, разработчики нашли и уже исправили 423 скрытые проблемы в безопасности.

Главное отличие от ранних ИИ-аудитов в том, что система не просто генерировала подозрительные отчёты, а встраивалась в существующую фаззинг-инфраструктуру Firefox.

ИИ запускался в нескольких виртуальных машинах, проверял гипотезы, отсекал невоспроизводимые находки и создавал демонстрационный эксплойт (proof-of-concept) для реальных багов.

В итоге модели смогли найти ошибки, которые годами проходили мимо традиционных инструментов. Среди примеров есть 15-летняя проблема в HTML-элементе legend, 20-летняя уязвимость в XSLT, а также баги в обработке HTML-таблиц, WebAssembly, IndexedDB, WebTransport и HTTPS.

Часть находок была серьёзной: Use-After-Free, повреждение памяти, состояние гонки (race condition) через IPC и обходы песочницы для сторонних библиотек. То есть ИИ искал не только простые сбои, а довольно сложные цепочки, где нужно понимать устройство браузерного движка.

При этом Mozilla отмечает и обратную сторону: модели не смогли обойти некоторые уже внедрённые защитные механизмы Firefox. Например, архитектурные изменения с заморозкой прототипов по умолчанию помогли отбить попытки атак.

Закрытие такого объёма багов потребовало участия более 100 разработчиков и ревьюеров. Патчи вошли в недавние обновления Firefox, включая версии 149.0.2, 150.0.1 и 150.0.2.

Теперь Mozilla планирует встроить ИИ-анализ прямо в систему непрерывной интеграции. Идея в том, чтобы проверять не только существующий код, но и новые патчи ещё до их попадания в релиз.