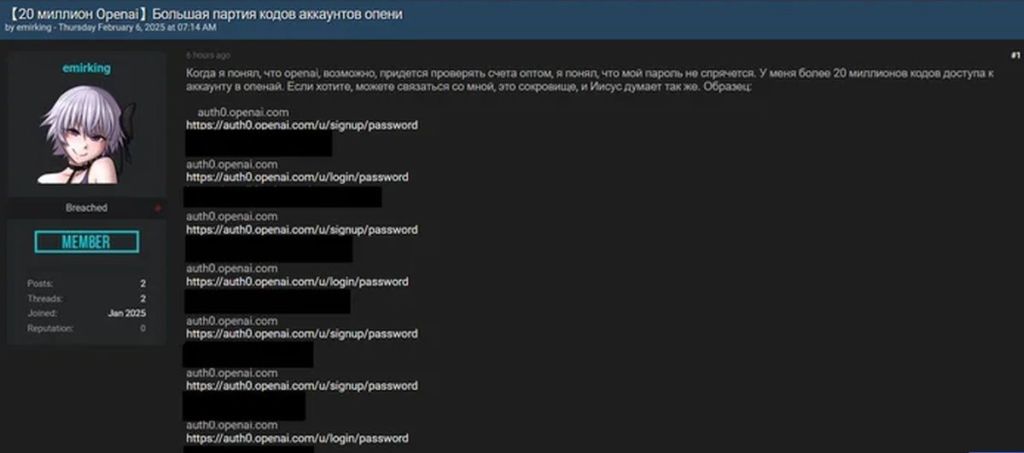

Исследователи из Malwarebytes обнаружили на хакерском форуме объявление о продаже более 20 млн кодов доступа к аккаунтам OpenAI. В подтверждение своих слов русскоязычный продавец выложил семплы якобы украденных данных.

Судя по записи, это должны быть коды, помогающие обойти системы аутентификации OpenAI. Если утверждение верно, такое количество, по мнению экспертов, вряд ли можно собрать посредством фишинга; скорее, это результат компрометации поддомена auth0.openai.com через уязвимость либо кражу учеток админа.

Аккаунт emirking, под которым размещено объявление о продаже, создан в прошлом месяце, однако его владелец, по словам аналитиков, мог ранее публиковаться под другим ником и потом поменять его по соображениям безопасности.

Покупка кодов доступа (если это они) позволяет злоумышленникам просматривать обращения юзеров в OpenAI и заполучить конфиденциальные данные для прицельного фишинга и финансового фрода.

Доступ к таким аккаунтам можно также использовать для подключения жертвам платных подписок Plus и Pro. Узнать содержимое бесед с ChatGPT подобным образом, судя по отзывам форумчан, не получится.

Проверить сенсационное заявление emirking пока не удалось: сайт BreachForums, на котором был найден пост, ушел в офлайн. Тем, кого беспокоит сохранность учеток OpenAI, аналитики советуют сменить пароль, включить многофакторную аутентификацию (MFA) и мониторить аккаунт на предмет необычной активности и неправомерного использования.