Наиболее популярные пароли в 2024 году выглядят так же плохо, как и несколько лет назад. Свежее исследование показало, что люди не хотят менять привычки и выдумывать сложные комбинации.

Специалисты NordVPN уже шесть лет наблюдают за динамикой паролей, фигурирующих в утечках. Из года в год картина остаётся практически неизменной: доминируют легко подбираемые и крайне простые учётные данные.

По словам исследователей, форумы дарквеба отлично позволяют оценить наиболее популярные у пользователей пароли. Например, в этом месяце специалисты взяли 2,5 терабайт слитых учётных данных, затрагивающих пользователей и бизнес из 44 стран.

«Мы разбили полученные сведения по категориям, чтобы лучше понимать разброс по странам. Отдельно отмечаем, что никакие личные данные не включались в исследование, поскольку нас интересовала лишь статистика».

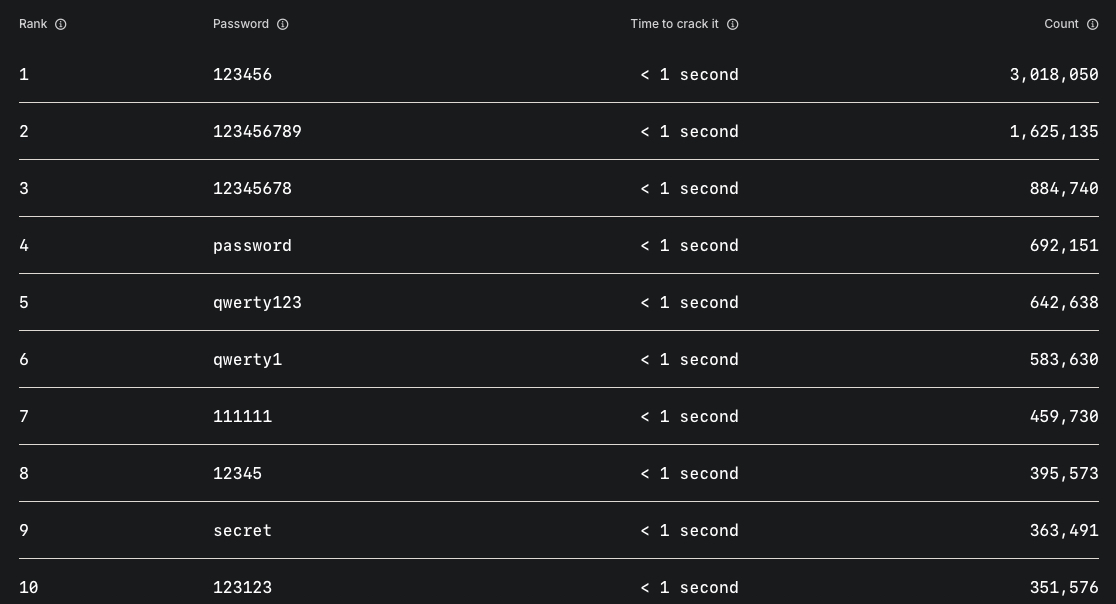

В результате команде NordVPN удалось составить топ-10 самых распространённых паролей, который в очередной раз доказал: в этом мире учётных данных ничего не меняется.

Если даже прокрутить список полученных комбинаций до, например, 200 места, там всё ещё встречаются крайне простые пароли вроде «letmein».