В Госдуму РФ внесен законопроект, предусматривающий уголовную ответственность за использование дипфейков в противоправных целях. Кабмин счел, что документ требует доработки: нормы для технологий подмены личности в законах пока не прописаны.

Депутат от ЛДПР Ярослав Нилов и сенатор Алексей Пушков предложили ввести в ряд статей УК еще один квалифицирующий признак — злонамеренное использование изображения или голоса, в том числе сфальсифицированного или искусственно созданного (читай: дипфейка), и/или биометрических данных граждан.

Наказывать за подобные преступления, по мнению авторов проекта, следует штрафами (до 1,5 млн руб.) и лишением свободы (на срок до двух лет). Соответствующие поправки предлагается внести в статьи о клевете, краже, мошенничестве, вымогательстве, причинении ущерба через обман или злоупотребление доверием.

«Введение предлагаемого регулирования в уголовное законодательство не представляется возможным из-за отсутствия корреспондирующих норм материального законодательства, что влечет существенные риски формирования некорректной правоприменительной практики», — цитирует ТАСС официальный отзыв правительства.

Кабмин также отметил, что в пояснительной записке к проекту ФЗ не указаны данные (свидетельства), на основании которых можно было бы сделать вывод об общественной опасности инкриминируемых деяний.

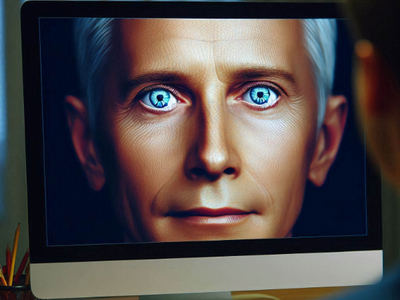

Атаки с применением дипфейк-технологий— угроза вполне реальная, и специалисты, в том числе в России, активно работают над созданием инструментов для распознавания таких фальшивок. К сожалению, в российском законодательстве это понятие до сих пор отсутствует, и все попытки криминализировать использование дипфейков с преступными намерениями пока терпят неудачу.