У мессенджера МАКС возникли новые проблемы в магазинах приложений. На этот раз сервис неожиданно исчез из AppGallery — фирменного магазина Huawei. Пользователи, которые переходили по ссылкам с официального сайта МАКС или пытались найти приложение через поиск, обнаружили странную картину: вместо отечественного мессенджера первым в выдаче красовался Telegram.

Сначала было непонятно, что произошло — технический сбой, ошибка каталога или осознанное решение площадки. Однако вскоре выяснился любопытный нюанс.

Как сообщают СМИ, доступность приложения напрямую зависит от географии пользователя и использования VPN. Если открыть AppGallery из России и без VPN, МАКС по-прежнему находится без проблем. Но стоит включить европейский VPN или попытаться найти приложение из одной из стран Европы, и мессенджер исчезает из поиска.

Получается своеобразная цифровая версия игры в прятки: внутри России МАКС есть, за её пределами — уже не факт.

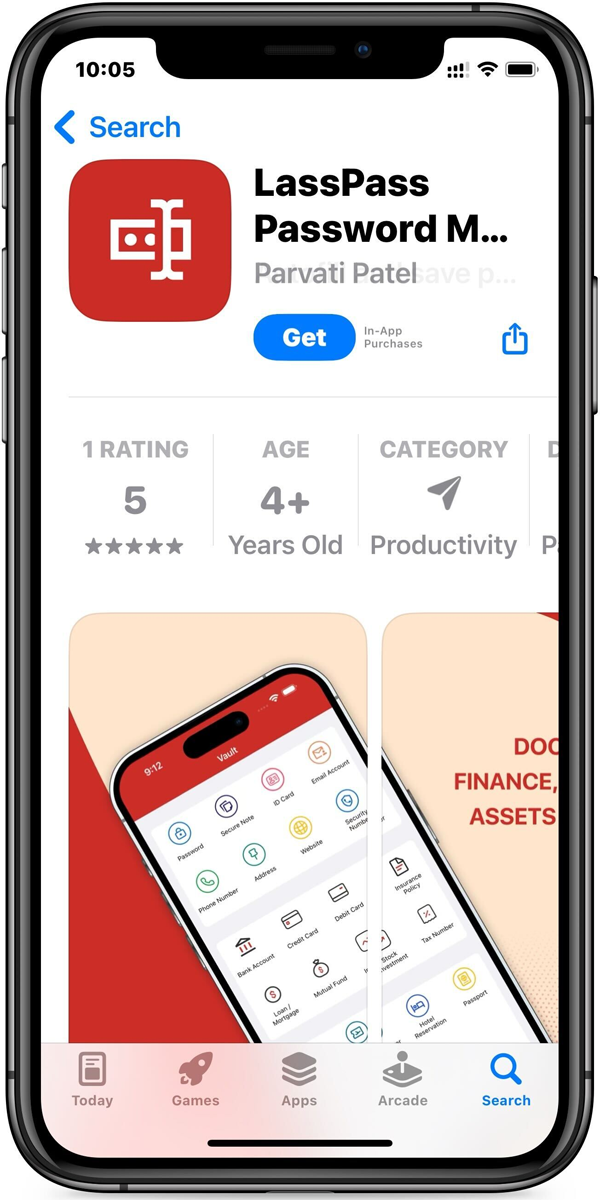

Это не первый подобный эпизод за последние дни. Ранее проблемы с доступностью МАКС возникли и в App Store. Утром 4 июня пользователи устройств Apple получили уведомление о временной недоступности приложения в магазине.

Тогда разработчики предупреждали, что после удаления программы из App Store могут перестать работать пуш-уведомления о новых сообщениях и звонках, хотя сама переписка продолжит функционировать.

Позже Apple заявила, что удалила приложение в соответствии с правилами соблюдения санкций.