Исследователи из Университета Пенсильвании предложили новое объяснение тому, как люди взаимодействуют с ИИ. По их мнению, всё чаще пользователи не просто пользуются нейросетями, а буквально «сдаются» им. Этот феномен специалисты назвали «когнитивной капитуляцией» (cognitive surrender).

Если раньше люди использовали технологии вроде калькуляторов или GPS для отдельных задач — «разгружали» мозг, но сохраняли контроль, — то с ИИ ситуация меняется.

Всё чаще пользователи просто принимают ответы модели за истину, не проверяя и не анализируя их. Причём, как отмечают исследователи, это особенно заметно, если ответ звучит уверенно, гладко и без лишних сложностей. В таком случае у человека просто не включается внутренний «режим сомнения».

Чтобы проверить это, учёные провели серию экспериментов с участием более 1300 человек. Им предложили задачи на когнитивное мышление с подвохом, который требует не интуиции, а вдумчивого анализа.

Часть участников могла пользоваться ИИ-помощником, но с нюансом: модель специально давала неправильные ответы примерно в половине случаев. Результат оказался показательным.

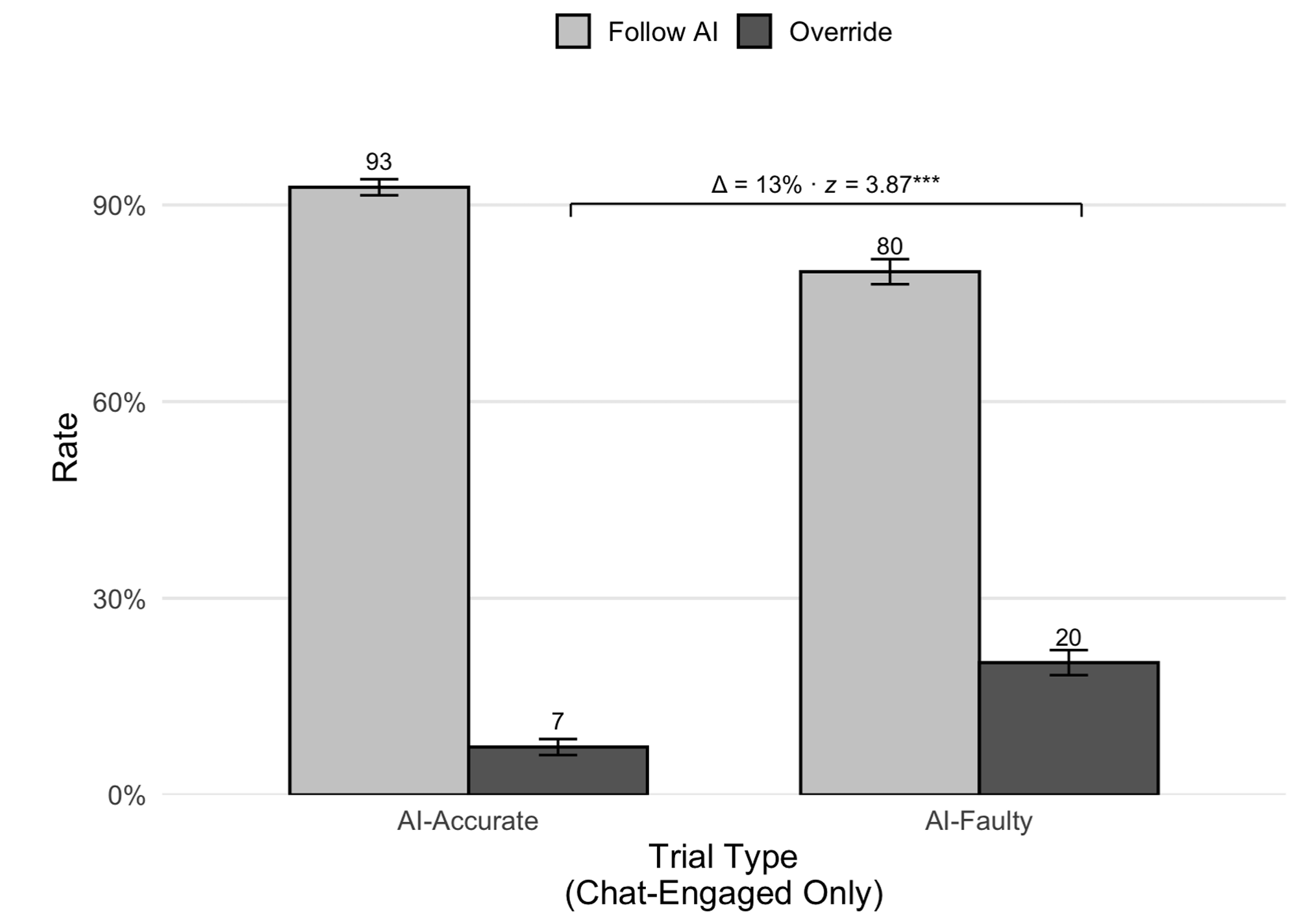

Когда ИИ отвечал правильно, пользователи соглашались с ним в 93% случаев. Но даже когда он ошибался, люди всё равно принимали его ответ в 80% случаев. То есть большинство просто не перепроверяло результат, даже если он был неверным.

В среднем участники соглашались с ошибочным ИИ в 73% случаев и оспаривали его лишь в 19,7% случаев.

Более того, у тех, кто пользовался ИИ, уровень уверенности в своих ответах оказался выше — даже несмотря на то, что половина этих ответов была неправильной.

Интересно, что поведение менялось в зависимости от условий. Например, если участникам давали небольшие денежные стимулы за правильные ответы и мгновенную обратную связь, они чаще перепроверяли ИИ и исправляли ошибки. А вот дефицит времени, наоборот, усиливал зависимость от модели: под давлением дедлайна люди ещё охотнее доверяли ИИ.

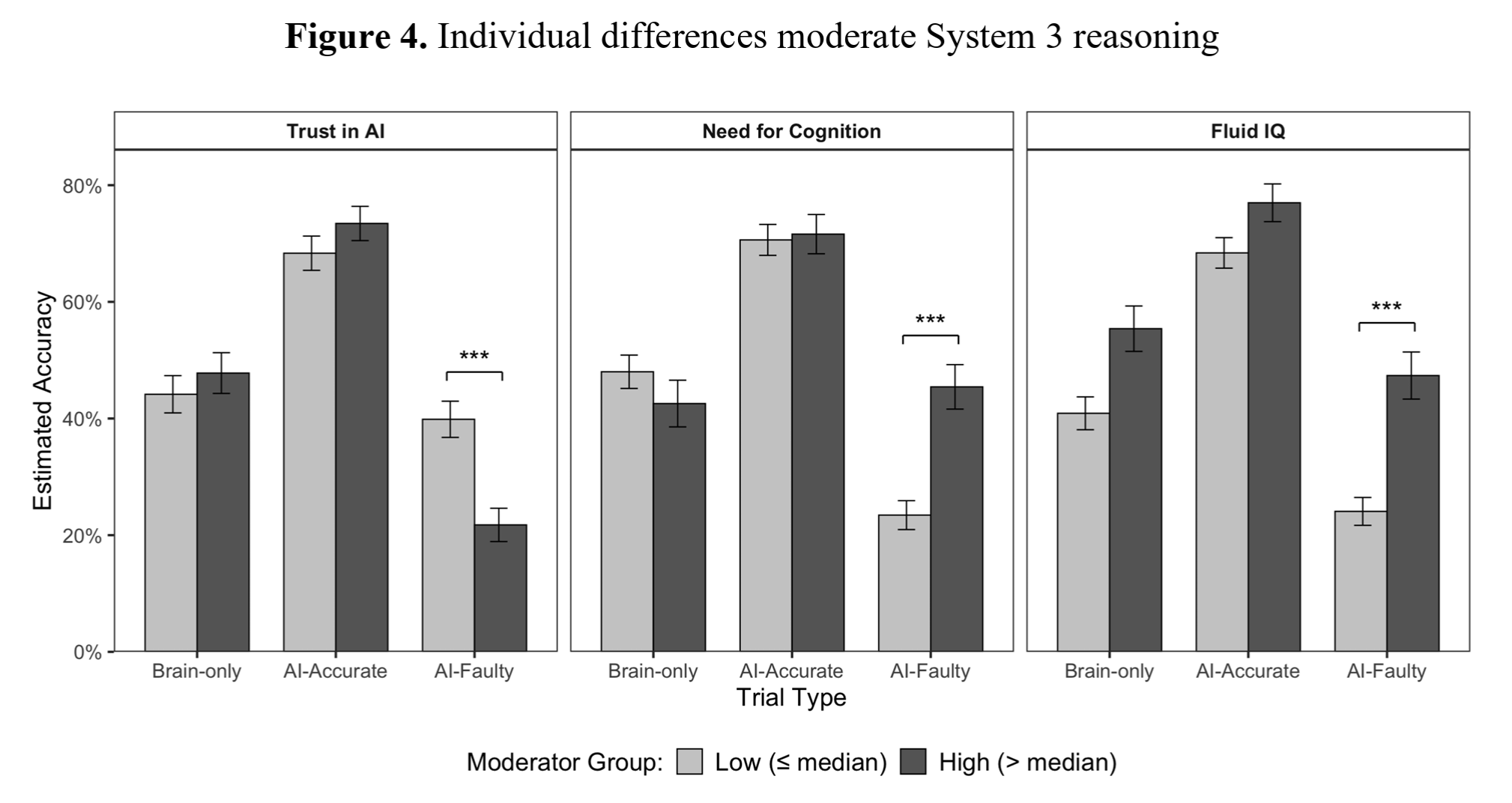

Не все оказались одинаково уязвимы. Люди с более высоким уровнем так называемого флюидного интеллекта (fluid IQ) реже полагались на ИИ и чаще замечали его ошибки. А вот те, кто изначально воспринимал ИИ как авторитетный источник, чаще попадались на неверные ответы.

При этом сами исследователи подчёркивают: «когнитивная капитуляция» — не обязательно зло сама по себе. Если ИИ действительно работает лучше человека, логично ему доверять, особенно в задачах вроде анализа данных или оценки рисков.

Но есть важный нюанс: качество мышления в таком случае напрямую зависит от качества самой модели.