Исходный код мобильных приложений и внутренних инструментов североамериканского представительства компании Nissan оказались в открытом доступе. Проблема в том, что японский автопроизводитель некорректно настроил один из своих Git-серверов.

Как объяснил швейцарский специалист Тилли Коттманн, сотрудники Nissan умудрились оставить открытый Git-сервер, доступ к которому можно было получить с помощью стандартной связки «имя пользователя-пароль» — admin-admin.

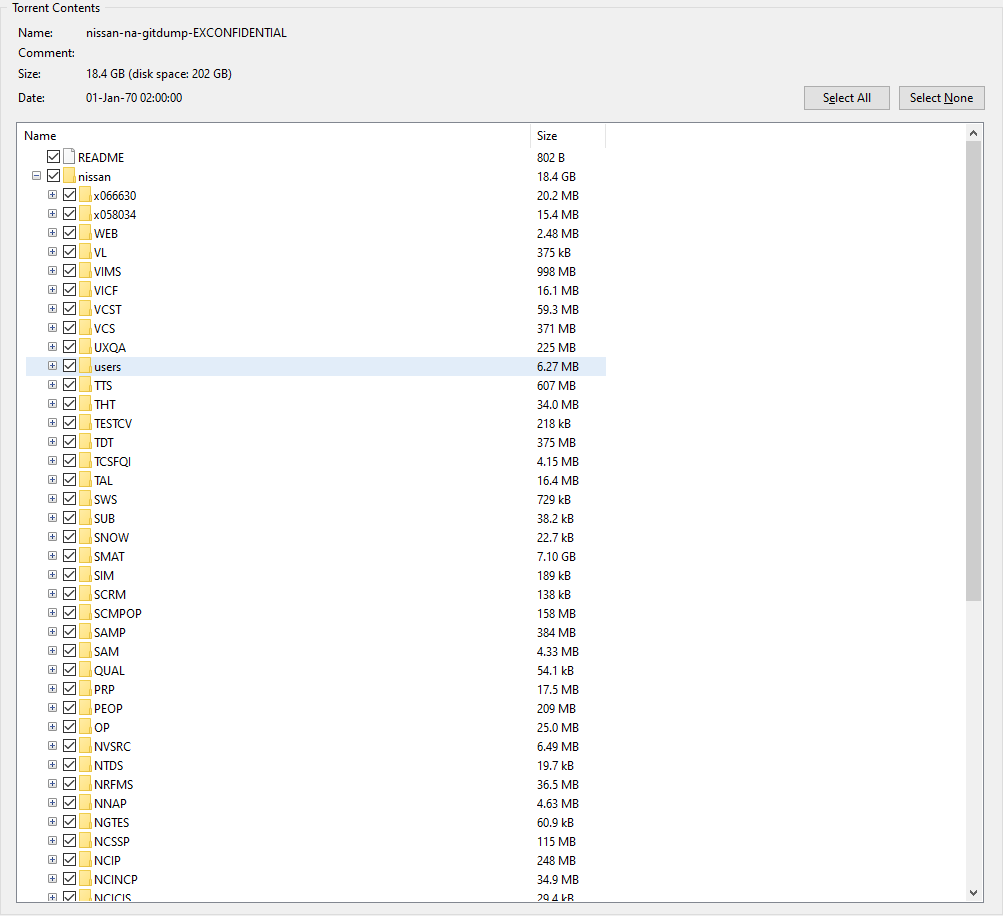

Коттманн изучил содержимое репозитория и выяснил, что на незащищённом сервере хранился исходный код следующих разработок автопроизводителя:

- Мобильных приложений Nissan.

- Nissan ASIST, инструмента для диагностики (частично).

- Систем Dealer Business Systems / Dealer Portal.

- Внутренней библиотеки.

- Служб Nissan/Infiniti NCAR/ICAR.

- Инструментов для поиска и удержания клиентов.

- Инструментов для изучения рынка.

- Маркетинговых инструментов.

- Многих других внутренних и бэкенд-инструментов.

После того как информация о незащищённом сервере попала в Сеть, неизвестные начали распространять внутренние данные Nissan через торрент-ссылки в Telegram-каналах и на хакерских форумах. Представители японского автопроизводителя уже подтвердили факт утечки и сообщили, что компания расследует инцидент.