Группа киберпреступников, известная как «Keeper», провела крупную кампанию, направленную против любителей онлайн-покупок. Злоумышленникам удалось взломать более 570 онлайн-магазинов за последние три года.

Результатом крупномасштабной операции стали украденные данные более 184 тысяч банковских карт. Атакующим удалось проникнуть на бэкенд-серверы магазинов, изменить исходный код и внедрить вредоносный скрипт.

Именно этот скрипт записывал введённые пользователями данные банковских карт. Как правило, такие формы атак называются веб-скимминг или в англоязычной среде — Magecart (в честь одноимённой группировки, которая первой использовала эту тактику).

Согласно отчёту, опубликованному специалистами компании Gemini Advisory, Keeper организует атаки как минимум с апреля 2017 года. Операции кибергруппы длятся по сей день.

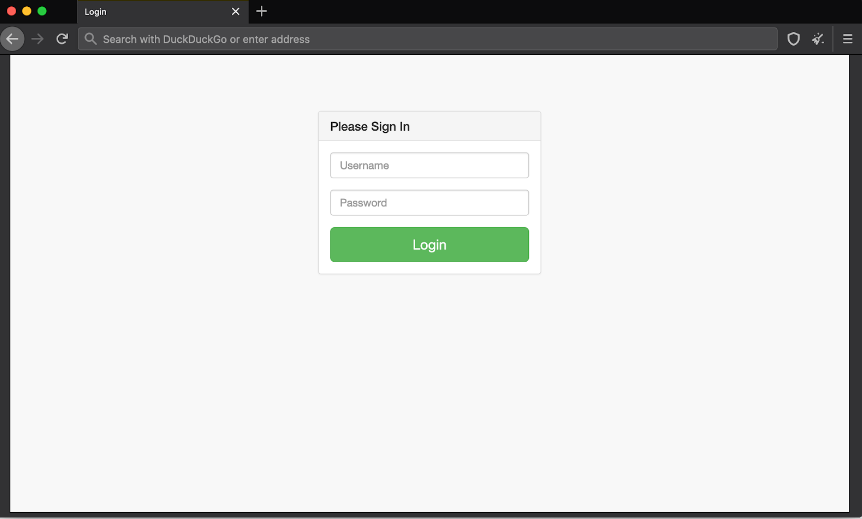

Эксперты также отметили, что 85% взломанных злоумышленниками сайтов работали на популярной платформе Magento. Но при этом операторы Keeper и сами прокололись на мелочи — атакующие не смогли должным образом защитить одну из бэкенд-панелей, на которую они отправляли украденные данные банковских карт.