Исследователи в области кибербезопасности вдохнули новую жизнь в знаменитого помощника в Microsoft Office, известного под прозвищем Скрепыш (Clippy). «Злой Скрепыш» (Evil Clippy) — именно такое имя получил новый инструмент — может значительно осложнить детектирование вредоносных макросов.

Злой Скрепыш способен модифицировать документы Office на этапе форматирования файла. На выходе получается вредоносная версия документа, которая может обойти детектирование различными антивирусными движками.

Чтобы добиться такого результата, новый инструмент задействует недокументированные функции и спецификации.

За созданием Злого Скрепыша стоит эксперт датской компании Outflank, которая занимается тестированием кибербезопасности. Инструмент был создан в процессе анализа способности одного из клиентов компании противостоять кибератакам.

Злой Скрепыш может работать в системах Windows, macOS и Linux. Инструмент поддерживает форматы Microsoft Office 97 - 2003 (файлы .DOC и .XLS), а также 2007 и более новые (файлы .DOCM и .XLSM).

Техника, используемая Злым Скрепышем для генерации вредоносных документов, называется VBA-стомпинг, в свое время ее описывала команда безопасности Walmart. Ее суть заключается в замене оригинального кода VBA-скрипта на «псевдокод».

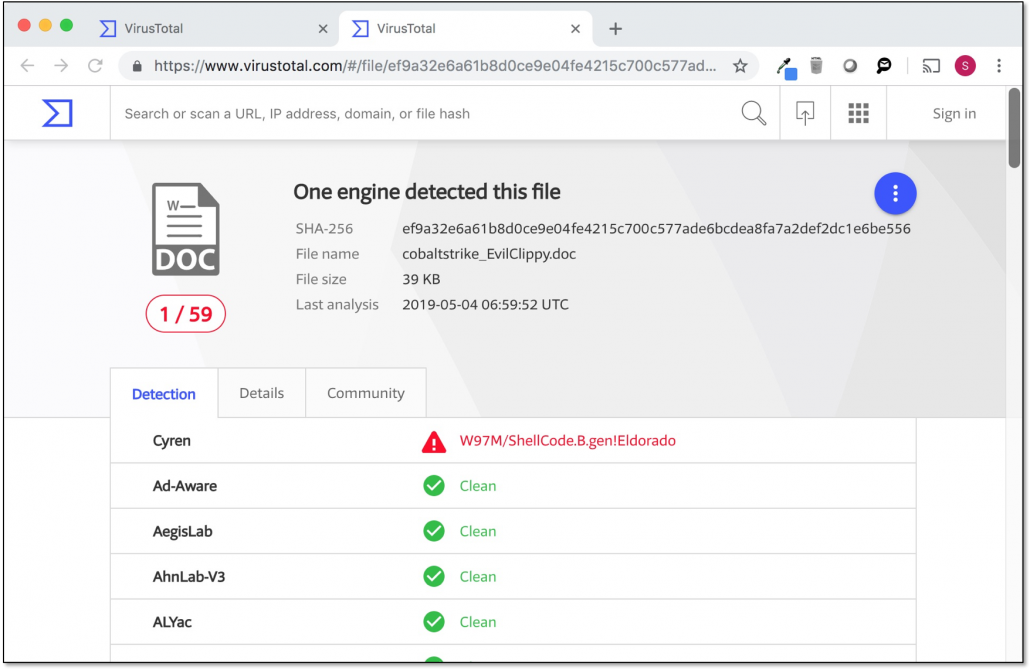

Для избежания детектирования антивирусными продуктами новый инструмент заменяет вредоносный код макроса фейковым скриптом. В результате вредоносный документ, который изначально был детектирован 30 антивирусами, смог обойти большинство из них с помощью Злого Скрепыша: